AI大模型与AIGC的关系是什么?

AIGC,即人工智能生成内容,是指运用AI技术自动创作各类内容的方法。与此同时,大型语言模型(LLMs)是基于深度学习的自然语言处理模型,它们专注于理解和产出自然语言。AIGC与大型语言模型之间的联系日益受到关注。这两个领域是如何相互配合,共同推进内容创造的智能化与自动化进程的呢?本文将深入分析这一问题,并探讨大型语言模型在其中扮演的核心角色。

一、AI大模型的崛起

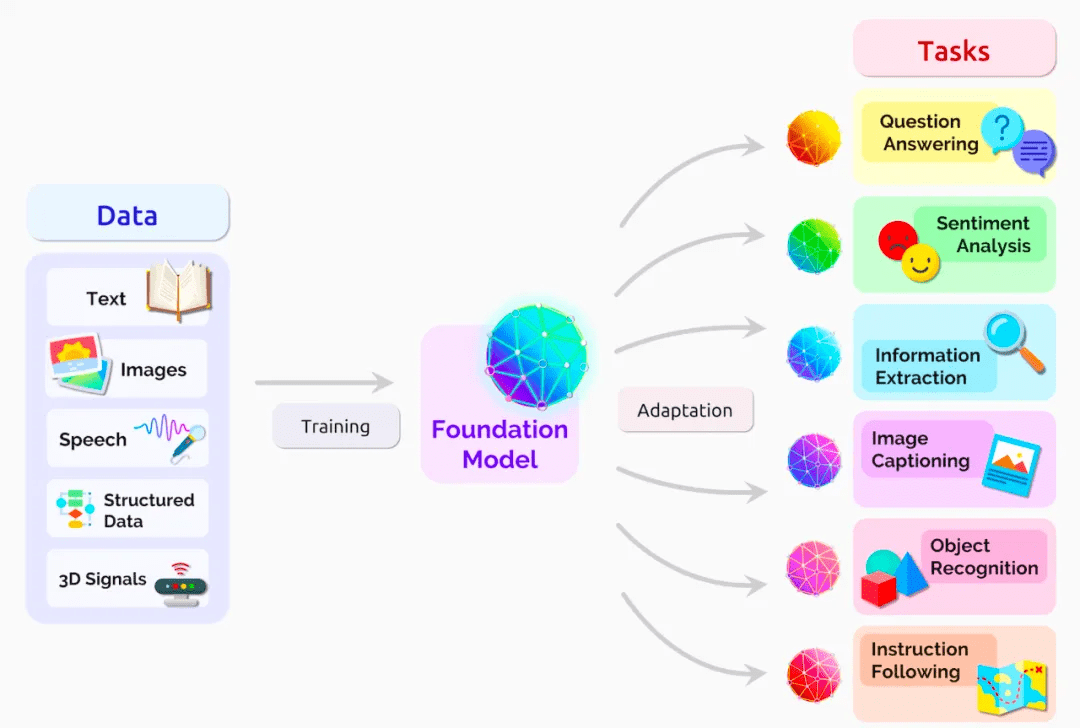

要深入理解AIGC与大型语言模型之间的联系,我们首先需要对AI大模型有一个基本的了解。这些模型(例如OpenAI的GPT、Google的PaLM)通过在海量数据集上进行训练,并利用复杂的神经网络结构,获得了生成自然语言文本的能力。这种能力构成了AIGC技术进步的基石。AIGC与大型语言模型之间的联系表现在,大型语言模型赋予了AIGC强大的文本生成和理解功能,使得AI能够自动产出连贯且逻辑性强的内容。

AI大模型的优势包括:

- 大规模数据训练:通过海量的语言数据,增强了AIGC与大语言模型的关系,使模型能够生成更加符合人类语言的内容。

- 自适应学习能力:大语言模型可以生成连贯、逻辑合理的文本,从而提升了AIGC系统在各种任务中的表现。

- 可扩展性:预训练和微调技术使得大语言模型能够适应不同领域的需求,进一步凸显了AIGC与大语言模型的关系在实际应用中的广泛性

截图_17340600525301.png) ## 二、AIGC的核心概念

## 二、AIGC的核心概念

要掌握AIGC与大语言模型之间的联系,我们首先需要明确AIGC的定义。AIGC指的是运用人工智能技术来自动化地生成包括文本、图像、视频在内的各种内容,这改变了以往主要依靠人工创作的方法。特别是在文本创作领域,AIGC与大型语言模型的联系尤为密切,因为大型语言模型在文本生成方面的能力为AIGC提供了关键的技术支撑。

AIGC应用场景包括:

- 文本生成:如新闻报道、市场营销文案等,依赖大语言模型的自然语言生成能力,充分体现了AIGC与大语言模型的关系。

- 图像和视频生成:虽然大语言模型主要用于文本生成,但AIGC与大语言模型的关系也体现在跨模态生成中,通过描述性文本驱动图像或视频生成。

三、AIGC与大语言模型的关系

1、大语言模型是AIGC的核心驱动力

在AIGC与AI大模型的关系中,大语言模型可以说是AIGC的核心技术驱动力。文本生成、对话系统等任务无不依赖于大语言模型的强大能力。正是因为有了大语言模型,AIGC才能生成连贯、流畅且具有逻辑性的文本内容,显著提升了内容创作的自动化水平。

例如,基于GPT的AI大模型可以自动生成各种形式的文章、脚本和技术文档,这充分展现了AIGC与大语言模型的关系在内容创作中的重要性。此外,AIGC系统中经常使用的大语言模型,还可以执行内容摘要、校对等任务,大幅提升文本处理效率。

2、大语言模型扩展了AIGC的应用领域

AIGC与大型语言模型的联系不仅限于文本创作,还扩展到了多模态内容生成的应用。以对话系统为例,AIGC中的对话生成功能依赖于大型语言模型的支持,使得人工智能能够产出与人类交流相似的对话内容。这种关系表明,AIGC与大型语言模型共同推动了应用场景的拓展,不仅覆盖了书面内容的生成,还包括了实时互动的智能对话。

此外,大型语言模型与其他人工智能技术的融合,进一步加深了AIGC与大型语言模型之间的联系。例如,将文本生成技术与图像生成技术相结合,AIGC系统能够创作出包含文本和图像的丰富内容,为用户提供更加多元的体验。

3、创意内容生成中的应用

在创意领域,AIGC与AI大模型的关系也得到了广泛的应用和认可。过去,创意内容(如广告文案、文学作品等)需要依赖人类的创造力。而现在,AI大模型能够学习大量的文本素材,生成富有创意的内容,这显著降低了创作门槛。AIGC与AI大模型的关系使得创意人员可以更加高效地生成内容,并且还能获得新的灵感来源。

四、 AIGC与大语言模型的关系的未来展望

展望未来,AIGC与AI大模型的关系将进一步深化,推动AIGC技术向更高层次发展。大语言模型将不仅仅用于文本生成,还会与多模态生成技术相结合,推动跨领域内容生成的发展。这种发展趋势将进一步加强AIGC与AI大模型的关系,使其成为各行业自动化创作内容的核心技术。

1、个性化与定制化内容生成

在个性化内容生成领域,AIGC与AI大模型的关系尤为关键。通过大语言模型,AIGC系统可以生成符合特定用户需求的个性化内容。未来,随着大语言模型的发展,AIGC有望根据用户的个人兴趣、偏好和历史行为,生成高度定制化的内容,进一步体现了AIGC与AI大模型的关系在用户体验提升方面的价值。

2、跨语言与跨文化内容生成

随着全球化需求的增加,AIGC与AI大模型的关系还将在跨语言和跨文化内容生成领域展现更大的潜力。大语言模型具有多语言处理能力,能够帮助AIGC系统生成适应不同语言和文化背景的内容,从而促进全球信息的无障碍传播。

五、结语

AIGC与AI大模型之间的关系确实是紧密且互为支撑的。AI大模型为AIGC提供了强大的文本生成和理解能力,这是AIGC技术发展的核心。随着技术的进步,这种关系不仅推动了文本内容的自动化生产,还扩展到了多模态内容的生成,包括图像、视频和音频等。

在多模态应用中,例如对话系统,AIGC生成的对话内容依赖于AI大模型的能力,使得AI能够生成与人类沟通相似的对话内容。这种互动不仅限于静态内容,还能实现实时互动的智能对话,极大地提升了用户体验。

此外,AI大模型与其他AI技术的结合,如将文本生成技术与图像生成相结合,使得AIGC系统能够创造出图文并茂的内容。这种多模态内容的生成为用户提供了更丰富的体验,并且正在成为未来智能化内容生产的核心动力。

随着AI大模型的持续发展,AIGC的应用场景也在不断扩展和深化。从文娱产业到商业领域,AIGC技术正在帮助企业优化工作流程、降低成本、提升效率,并且推动新产品的开发。例如,在影视行业中,AIGC工具已经开始被用来生成美术物料,支持宣传设计师的创意工作。在游戏行业,AIGC技术也在声音、配音、市场推广和用户获取等方面展示了其广泛应用的可能性。

未来,AIGC与AI大模型的关系将继续推动内容生产的智能化和自动化,不仅在文本领域,还在图像、视频和音频等多个领域发挥重要作用。这将为文娱产业带来前所未有的创新机会和发展潜力,同时也会对其他行业产生深远的影响。