如何调用 Minimax 的 API

近日,来自美国德克萨斯大学奥斯汀分校(UT奥斯丁)等机构的研究人员提出了一项名为StreamingT2V的AI视频生成技术,引起了业界的广泛关注。这项技术打破了传统视频生成的局限,实现了高度一致且长度可扩展的视频生成,为视频创作领域带来了革命性的突破。

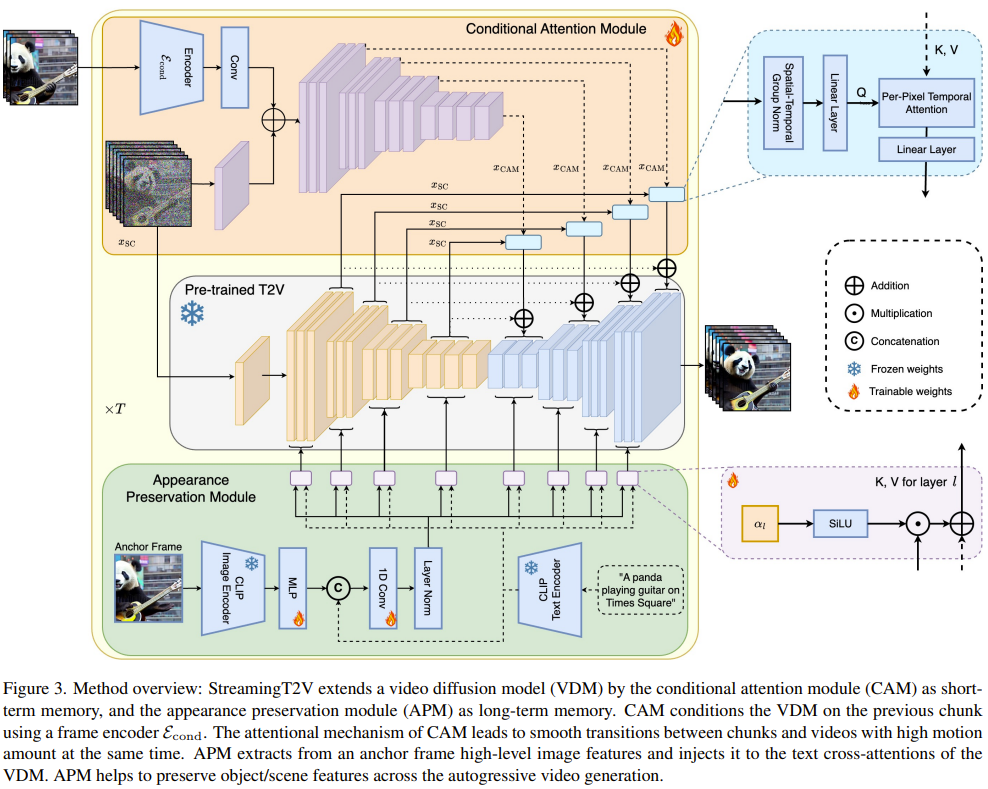

StreamingT2V技术的核心构架包括条件注意力模块(CAM)。CAM利用短期记忆单元确保视频的连续性和动态连贯性。通过这种方式,生成的视频不仅动态流畅,而且视觉效果达到了高质量水平。在实验过程中,研究人员成功利用Streaming T2V生成了1200帧,长达2分钟的视频。

APM则作为长期记忆单元,保持视频中对象或场景的一致性。这两个模块的完美结合,使得生成的视频不仅动态流畅,而且视觉效果达到了高质量水平。

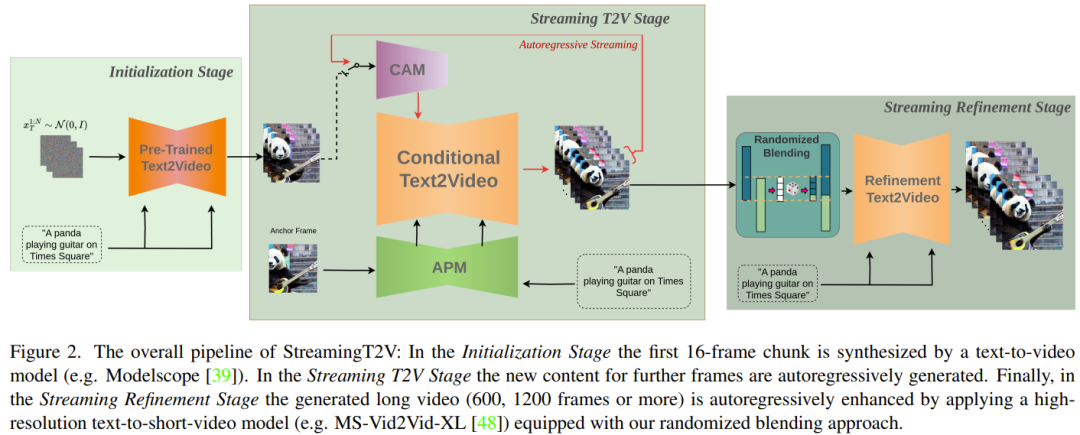

StreamingT2V技术的实现过程可分为三个阶段:初始化、Streaming T2V生成和Streaming Refinement。在初始化阶段,研究人员利用先进的文本到视频模型创造出视频的前16帧。

随后进入Streaming T2V阶段,通过自回归技术生成后续帧,确保视频内容的连贯性和一致性。这种方法利用了自回归方法的优势,大幅提升了视频生成的质量。

最后,在Streaming Refinement阶段,对生成的视频进行优化处理,进一步提升画质和动态效果。这一步骤确保了视频的高质量输出,并减少了生成过程中的不一致性。

这一突破性技术的出现,无疑将为视频创作领域带来巨大的变革。相较于传统的视频生成方法,StreamingT2V技术具有更高的灵活性和可扩展性,有望在未来广泛应用于电影制作。

在广告制作中,利用StreamingT2V技术,可以快速生成高质量的视频广告,提高广告的视觉冲击力和观众的观看体验。

在线教育平台可以利用这项技术生成丰富的教学视频,为学生提供更生动的学习体验,提升学习效果。

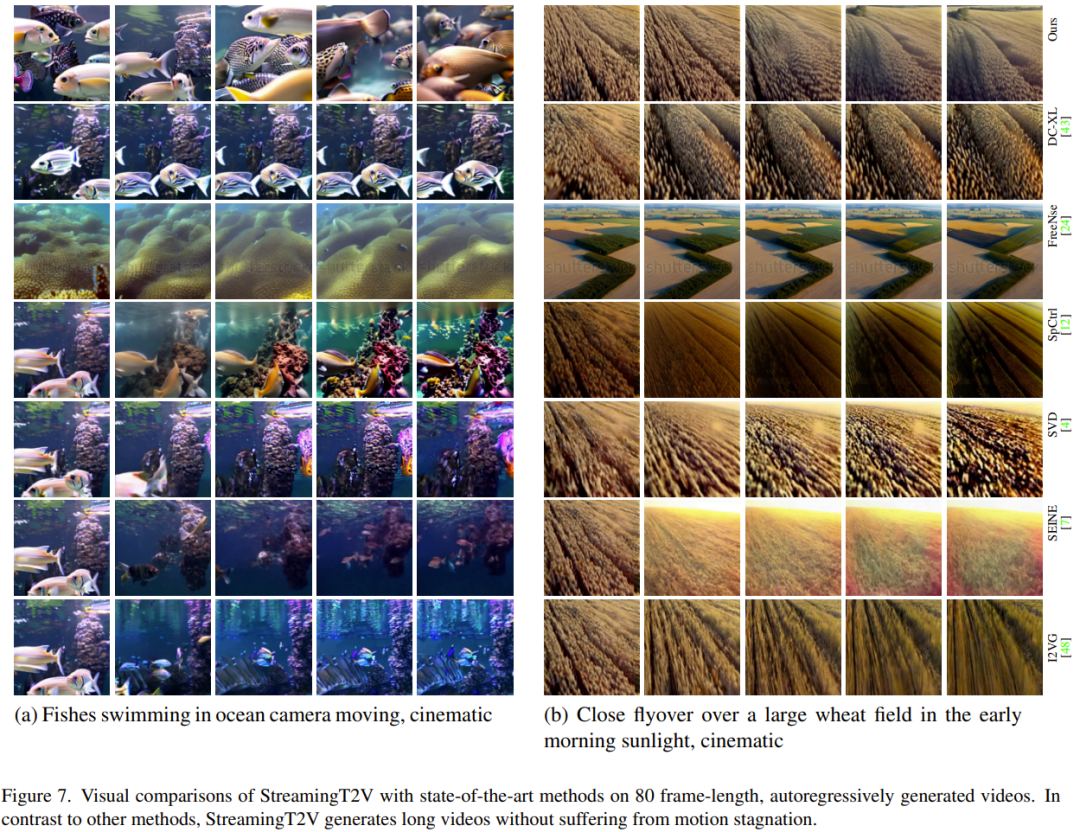

研究团队通过定量和定性评估比较了StreamingT2V与多种模型,包括使用自回归方法的图像到视频方法I2VGen-XL、SVD、DynamiCrafter-XL、SEINE等。结果表明,StreamingT2V在无缝视频块过渡和运动一致性方面的表现最佳。

在定性评估中,StreamingT2V生成的视频不仅在动态效果上优于其他方法,还能更好地维持视觉一致性。这种优势使其在多个领域中具有广泛的应用潜力。

随着技术的不断发展和完善,我们有理由相信,StreamingT2V技术将为人类创造更加丰富多彩的视频世界。未来,这项技术可能会进一步优化,应用于更多的场景和领域。

问:什么是StreamingT2V?

问:StreamingT2V 的应用场景有哪些?

问:StreamingT2V与传统视频生成技术的区别是什么?

问:实现 StreamingT2V 技术需要哪些步骤?

问:StreamingT2V如何确保视频的一致性?