如何调用 Minimax 的 API

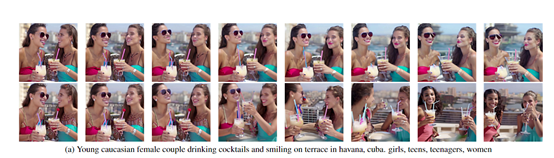

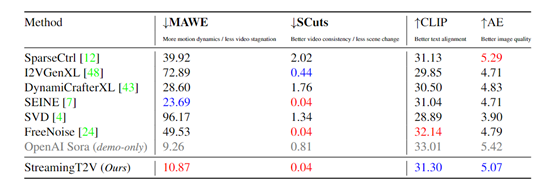

近年来,随着人工智能技术的不断进步,视频生成技术也在快速迭代。由Picsart人工智能研究所、德克萨斯大学和SHI实验室的研究人员联合推出的StreamingT2V视频模型,通过文本即可生成高质量的长视频。这一技术的出现,标志着长视频生成进入了一个全新的时代。

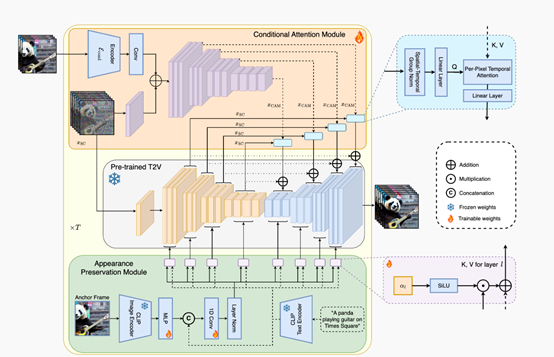

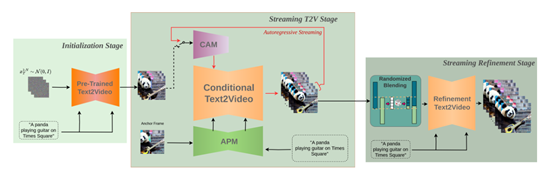

StreamingT2V模型的核心在于其创新的自回归技术框架。通过条件注意力、外观保持和随机混合三个模块,模型能够生成时长2分钟甚至更长的视频,确保动作的连贯性和画面的高质量。这种技术的突破,为长视频的生成提供了新的思路。

条件注意力模块是StreamingT2V的关键组成部分。该模块通过从前一视频块中提取特征,并将其注入到当前视频块中,确保了视频块之间的自然过渡。这种方法不仅提高了视频的流畅性,还保留了高速运动的特征,使得视频生成的效果更加真实和自然。

previous_block_features = extract_features(previous_video_block)

current_video_block = generate_video_block(current_text_input, previous_block_features)

为了确保生成视频的全局场景和外观的一致性,外观保持模块从初始图像(锚定帧)中提取高级场景和对象特征。这些特征贯穿于整个视频生成流程,使得对象和场景特征在自回归过程中得以连续保持。

随机混合模块主要用于增强视频的分辨率。通过将低分辨率视频划分为多个视频块,再利用高分辨率模型对这些块进行增强,实现了视频质量的提升。该模块通过生成新混合帧,使得视频块之间的过渡更加自然。

StreamingT2V的推出,不仅在技术上实现了突破,还为其广泛应用奠定了基础。在娱乐领域,StreamingT2V可以生成风格多样、内容丰富的视频作品,满足用户的需求。同时,在教育、培训和模拟领域,这一技术也能够发挥巨大的作用,为学习者提供更加直观的体验。

在教育领域,StreamingT2V可以生成逼真的教学视频,帮助学生更好地理解复杂的概念。通过模拟演练场景,增强学生的学习体验,提高学习效果。

在娱乐行业,StreamingT2V可以生成各种风格的视频,供创作者进行创意表达。无论是电影、动画还是广告,这一技术都能带来新的创作可能。

尽管StreamingT2V在长视频生成领域取得了显著进展,但它仍面临着一些挑战。在视频质量和多样性方面,还有进一步提升的空间。此外,随着其他AI视频生成模型的不断涌现,StreamingT2V需要持续创新以保持竞争力。

对于希望使用StreamingT2V技术的开发者和研究人员,API的申请是一个重要步骤。以下是API申请的一般流程:

{

"name": "StreamingT2V API Example",

"version": "1.0",

"description": "Example for accessing StreamingT2V API",

"apiKey": "your-api-key"

}除了StreamingT2V,市场上还有其他优秀的AI视频生成工具,如千帆大模型开发与服务平台、Lumen5等。这些工具各有特点,能够满足不同用户的需求。

千帆平台支持多种视频风格和分辨率的选择,易用性和灵活性方面更具优势,适合没有专业背景的用户快速上手。

Lumen5可以将文本内容转化为视频,提供丰富的视频模板供选择,用户可以对制作过程进行微调,享有高度的自由度。

答:StreamingT2V通过条件注意力模块提取前一视频块的特征,并注入当前视频块中,实现视频块之间的流畅过渡。

答:可以通过Picsart AI Research网站注册账户并提交API申请,经过审核后获取API密钥。

答:StreamingT2V可应用于娱乐、教育、培训等多个领域,为用户提供丰富的创作和学习体验。

答:使用StreamingT2V需要一定的编程能力,了解API调用和视频生成的基本概念。

答:理论上,StreamingT2V可以无限扩展视频长度,但具体实现需考虑计算资源和模型设置。

StreamingT2V为AI视频生成技术带来了新的可能性。通过不断的技术创新和应用探索,未来的AI生成视频将更加生动自然,为人们带来前所未有的视觉体验。