文心一言写代码:代码生成力的探索

OpenAI 的 GPT-4 API 发布以来,以其强大的多模态能力和优越的性能引起广泛关注。本文将深入探讨 GPT-4 API 的价格策略、功能特性及其相较于前代模型的优势。通过对各个方面的详细分析,帮助开发者们更好地理解如何利用这一强大的工具。

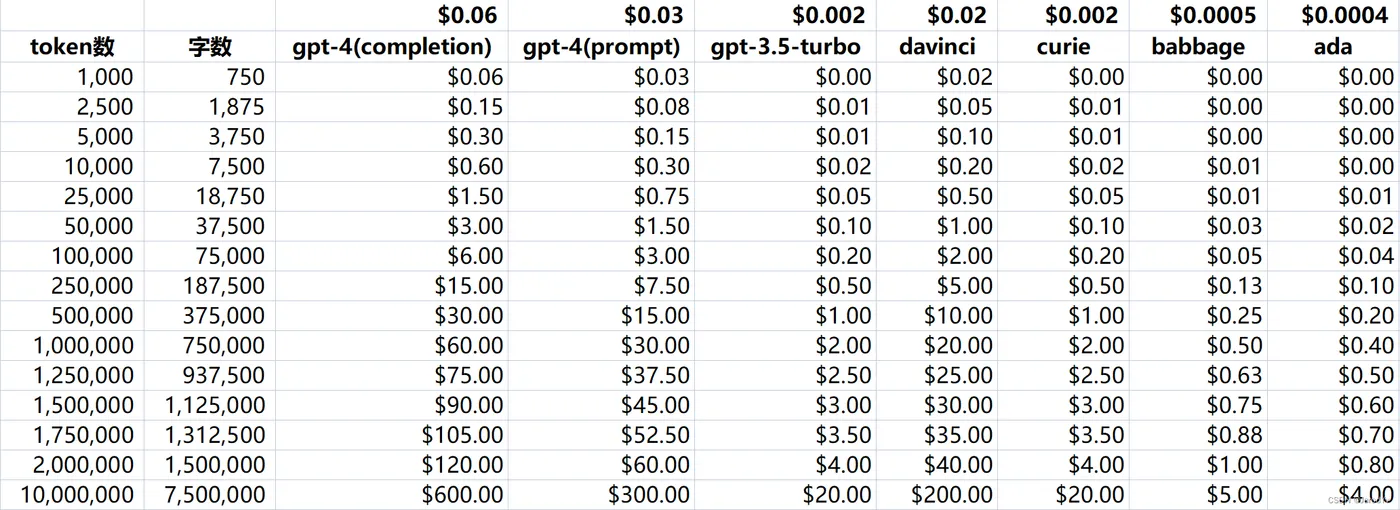

GPT-4 API 的定价策略与之前的模型有所不同。不同于 GPT-3.5 Turbo 统一的 token 计价方式,GPT-4 的定价将 prompt token 和生成响应 token 分开计价。这种策略使得开发者需要更加精确地评估其使用成本。具体价格为:

这一定价相对于 GPT-3.5 Turbo 的 $0.002 / 1K tokens 增加了至少 15 倍。这一变化促使开发者在大规模使用前需进行详细的成本效益分析。

GPT-4 作为 OpenAI 的最新旗舰模型,其功能优势明显,支持复杂任务的执行,并且在多模态环境下表现卓越。不同版本的 GPT-4 模型在 token 上限、训练数据截止日期等方面有所不同。

这些特性使得 GPT-4 能够在处理长文本和复杂任务时表现出色,尤其是在需要高精度和上下文处理的场景中。

由于 GPT-4 API 仍处于 beta 阶段,其调用频次受到限制:

这些限制对于功能测试和概念验证已经足够,但在生产环境中使用时,需要考虑到这些限制带来的影响。

通过对比发现,GPT-4 相较于 GPT-3.5 Turbo,无论是在 prompt 还是生成响应的成本上都有显著提升。具体来说,GPT-4 prompt 的费用是 GPT-3.5 Turbo 的 14 倍,而生成响应的费用则是 29 倍。综合来看,若 prompt 和 completion 的字数比例为 1:4,则 GPT-4 的综合成本是 GPT-3.5 Turbo 的 27 倍。

这种巨大的价格差异促使开发者在选择使用 GPT-4 时,需仔细评估其价格是否能被其带来的功能提升所抵消。

对于高正确性要求的场景,如法律、教育等领域,GPT-4 的高精度带来的改进无疑是值得的。然而,在其他用例中,开发者需通过深入测试来确定其额外成本是否能带来相应的效益。

GPT-4 模型的最大 token 数是 GPT-3.5 Turbo 的两倍,因此对于长文本生成的场景,GPT-4 是优选。同时,GPT-4 提供了 32K 版本,支持 32,768 token,尽管价格更高,却为需要处理大量上下文信息的应用提供了可能性。

在选择合适的 GPT 模型时,项目的特定需求和约束是关键因素。以下是一些考虑因素:

在人工智能的快速发展中,选择合适的模型不仅仅是技术的较量,更是战略的选择。通过深入了解 OpenAI 的 GPT-4 API 的价格与功能,我们可以更好地利用这一强大的工具来实现业务目标。