PixverseAI互动功能(HUG)在AI拥抱视频生成中的应用

One-API 是一个强大的工具,旨在简化和统一对多个大模型的访问。通过其标准化的 API 接口,开发者可以轻松调用不同的 AI 模型,极大地提高了开发效率。本篇文章将详细介绍如何在本地安装和使用 One-API,并提供相关的操作示例和常见问题解答。

One-API 是一个开源项目,其主要目标是通过标准的 OpenAI API 格式来访问各种大模型。它支持多个知名的 AI 模型提供商,包括 OpenAI、Google、Baidu 等,使得开发者可以通过一个统一的接口来调用和管理不同的 AI 模型。

One-API 的主要功能包括负载均衡、令牌管理、渠道管理等,支持多种用户登录注册方式,并提供了丰富的自定义设置。

在本地安装 One-API 可以通过多种方式进行,最常用的方法是使用 Docker 进行安装。以下是详细步骤:

拉取 One-API 镜像

docker pull justsong/one-api这将从 Docker Hub 拉取最新的 One-API 镜像。

启动容器

docker run --name one-api -d --restart always -p 3000:3000 -e TZ=Asia/Shanghai -v C:/LLM/OneApi-V-Data:/data justsong/one-api这里需要注意的是数据卷的映射路径,确保路径格式正确。

如果不想使用 Docker,可以选择手动安装。需要下载最新的可执行文件并进行运行。具体步骤可以在 One-API 的 GitHub 页面找到。

安装完成后,需要进行基本的配置来开始使用 One-API。

http://localhost:3000/。渠道配置是 One-API 的核心功能之一,用于管理不同 AI 模型的调用信息。

令牌用于通过 API 调用 One-API 时进行鉴权。

配置完成后,就可以开始使用 One-API 进行模型调用了。

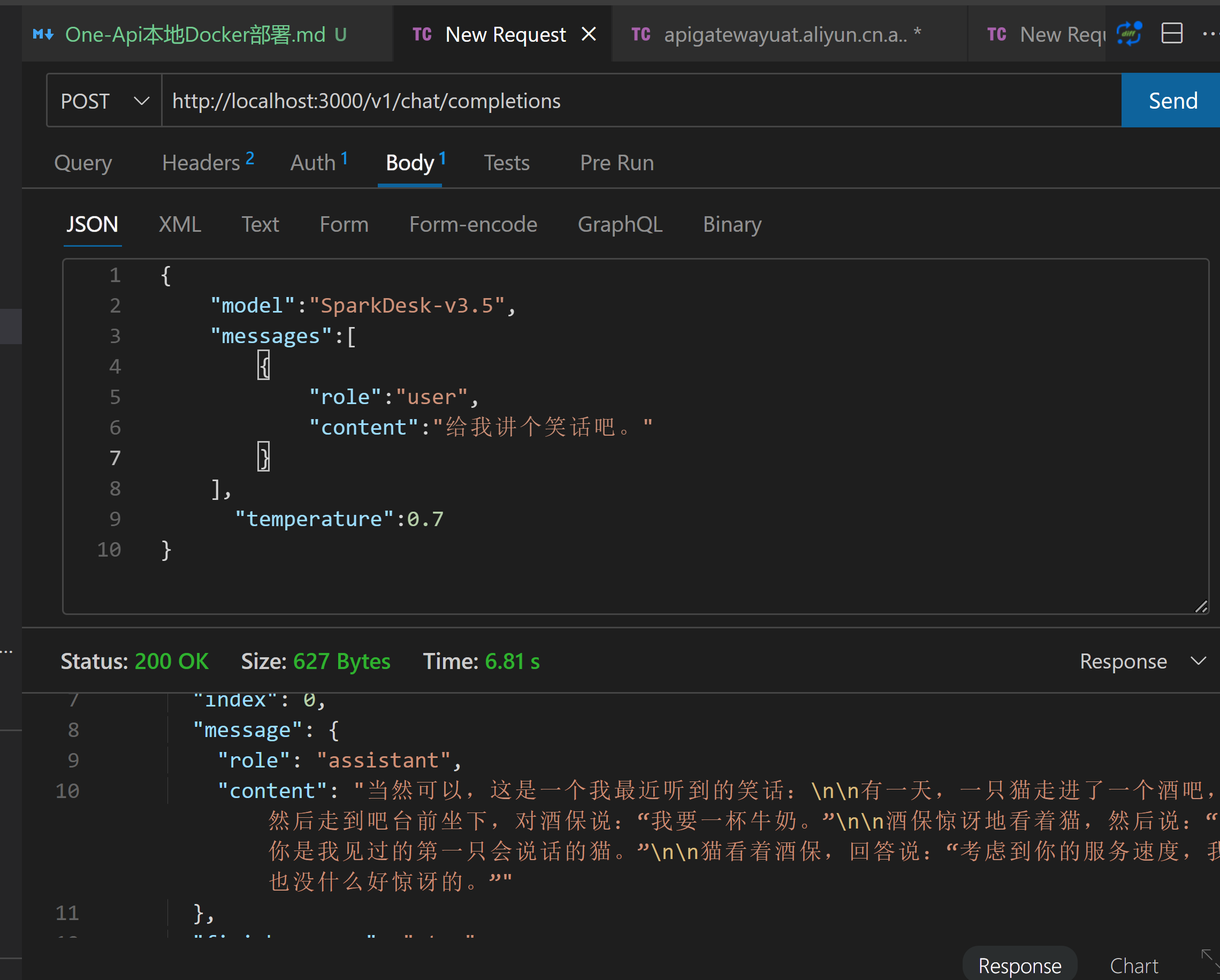

可以使用 API 测试工具来验证 One-API 的接口。

请求地址

http://localhost:3000/v1/chat/completions请求头

Authorization: Bearer {OneApiToken}请求体示例

{

"model": "SparkDesk-v3.5",

"messages": [

{

"role": "user",

"content": "给我讲个笑话吧。"

}

],

"temperature": 0.7

}

可以通过修改环境变量来直接使用 openai 的代码进行调用。

import openai

openai.api_base = 'http://localhost:3000/v1'

openai.api_key = 'YOUR_API_KEY'

response = openai.ChatCompletion.create(

model="SparkDesk-v3.5",

messages=[{"role": "user", "content": "给我讲个笑话吧。"}],

temperature=0.7

)

print(response)问:如何更新 One-API?

问:One-API 支持哪些 AI 模型?

问:如何解决 API 调用失败的问题?

通过本文,您应该能更清晰地理解如何安装和使用 One-API 来简化大模型的调用和管理。该平台不仅支持多种大模型,同时还提供了丰富的功能设置,使得开发者可以根据自身需求进行灵活配置。