如何调用 Minimax 的 API

Stable Video Diffusion 是一款引领AI视频合成领域的强大工具,广泛应用于媒体、娱乐、教育和营销等行业。本文将详细解析Stable Video Diffusion的基本原理、优点、局限性及实际应用,并提供API购买指南。

Stable Video Diffusion 模型基于潜在的视频扩散模型,通过在小型、高质量的视频数据集上插入时间层并进行微调,将传统的2D图像合成模型转化为生成视频模型。其核心优点在于能够生成高分辨率的视频,并且具有强大的运动表示能力。这种方法使得Stable Video Diffusion在视频生成任务中具有独特的优势。

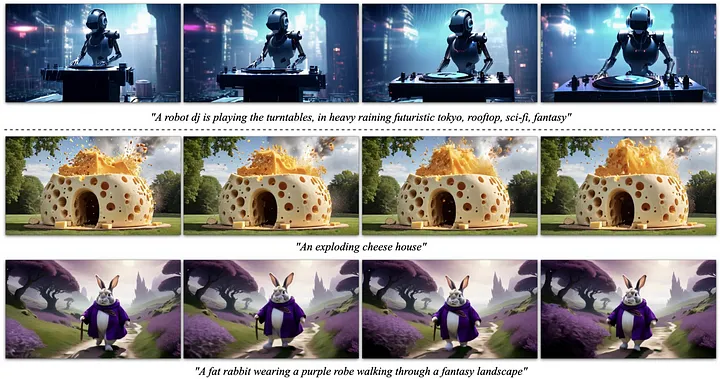

Stable Video Diffusion 能够接受一张静态图像作为条件并生成高分辨率的视频。这一特性使得它在视频生成任务中具有显著的优势,尤其是在需要高质量视觉表现的场景中。

该模型的运动表示能力强,可以适应各种摄像机运动,从而生成更自然的视频。这使得Stable Video Diffusion 在视频编辑、增强和修复等任务中具有广泛的应用前景。

Stable Video Diffusion 的强大基础使得它能够在各种不同的任务上进行微调,如文本到视频、图像到视频和帧插值等。这一特性赋予了该模型极高的灵活性和可扩展性。

尽管Stable Video Diffusion 模型具有诸多优点,但它也存在一些局限性。首先,生成的视频相对较短,且运动不够自然流畅,这在一定程度上限制了该模型在某些特定任务上的应用。

其次,该模型无法直接用文本进行控制,这在一定程度上降低了其应用的便捷性。用户需要通过特定的接口和参数设置来实现更加复杂的需求。

Stable Video Diffusion 模型可以通过微调生成最先进的图像到视频合成模型,如LoRAs。这在相机控制任务中取得了显著效果,尽管计算量只是之前方法的一小部分。

该模型在多视图合成任务中也取得了最先进的结果,展示了其在复杂视频合成任务中的潜力。

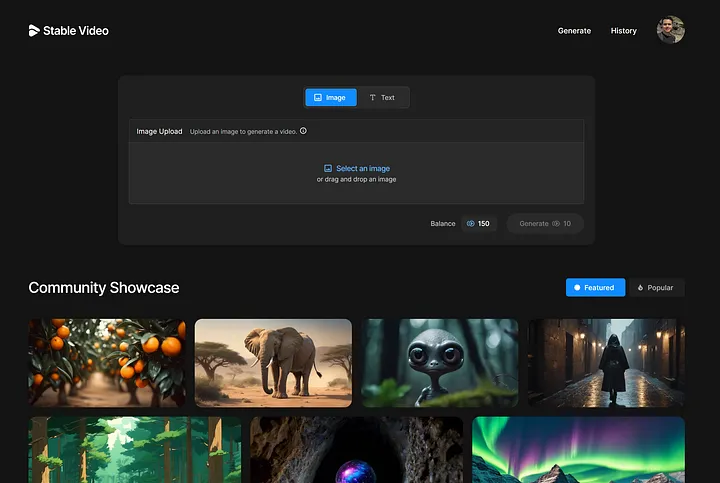

要使用Stable Video Diffusion 模型进行视频生成,用户可以通过该模型的API接口进行操作。首先,用户需要准备一张静态图像作为条件输入。然后,通过调用API接口,将图像传递给Stable Video Diffusion 模型进行视频生成。模型会根据输入的图像生成一个高分辨率、高质量的视频,并具有一定的运动表示能力。

Stable Video Diffusion 提供了多种购买选项以满足不同用户的需求。新用户将获得150个免费积分。额外的积分可以按照以下方式购买:

这种灵活的计费方式使得用户可以根据自己的使用需求选择合适的购买方案。

Stable Video Diffusion 模型作为一种强大的视频合成工具,在AI视频合成领域具有广泛的应用前景。尽管该模型存在一些局限性,但其优点仍然使得它在许多任务中表现出色。未来,随着技术的不断进步和模型的不断优化,我们期待Stable Video Diffusion 模型能够在AI视频合成领域发挥更大的作用,为我们带来更加丰富的视觉体验。

问:Stable Video Diffusion 是否支持长视频生成?

问:如何提高生成视频的流畅性?

问:Stable Video Diffusion 是否支持实时视频处理?

问:购买积分后是否有时间限制?

问:如何访问Stable Video Diffusion API?