如何调用 Minimax 的 API

在人工智能领域的快速发展中,Meta 的 Large Concept Models (LCM) 引起了广泛关注。作为一种新型的 AI 模型,LCM 不仅改进了传统大语言模型 (LLM) 的一些局限性,还为多模态和多语言任务处理带来了新的可能性。本文将深入探讨 LCM 的技术背景、开发流程及其在 AI 领域的应用。

LCM 模型相较于 LLM 的最大区别在于其高维嵌入空间和概念级建模。这两者的结合使 LCM 能够更好地处理跨语言和跨模态任务。

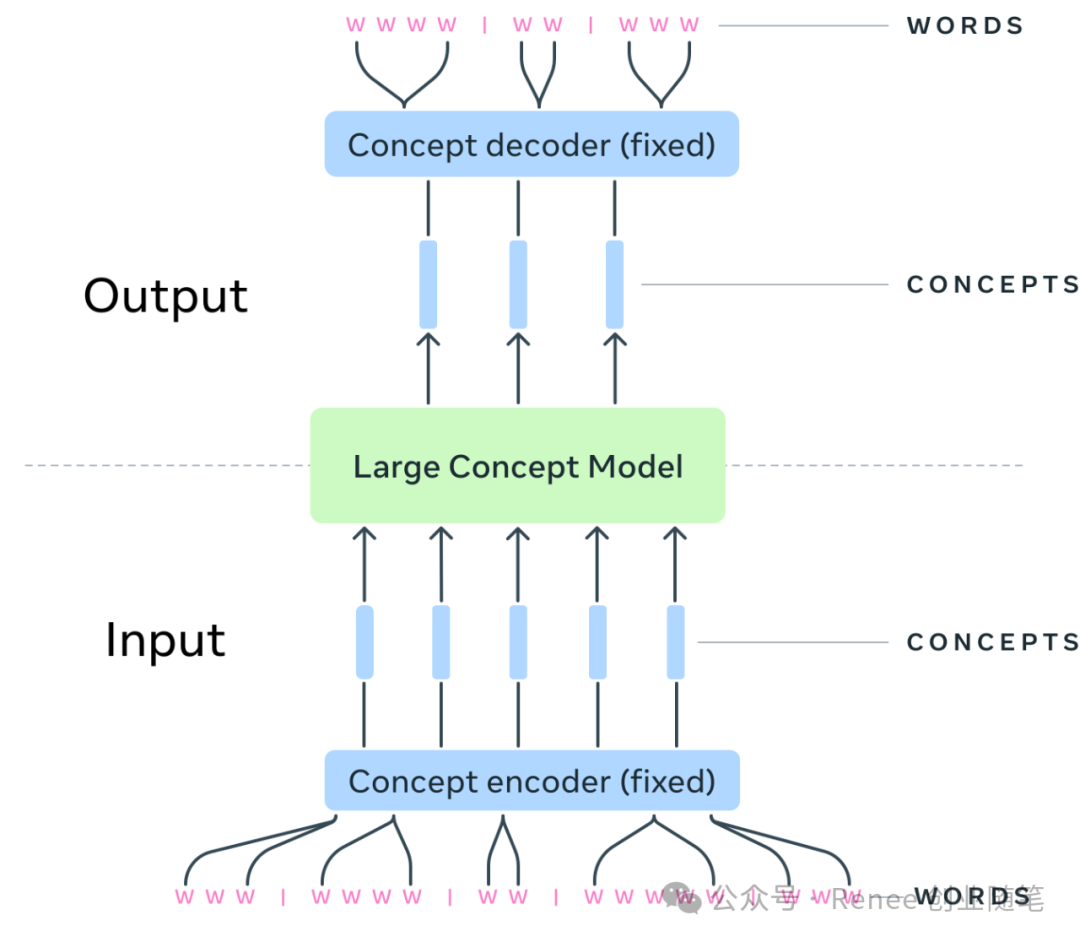

LCM 不再依赖于传统的离散 token 序列,而是在一个统一的语义嵌入空间中进行建模。这种方式允许 LCM 更加高效地理解和处理来自不同语言和模态的数据。通过高维嵌入空间,LCM 能够捕捉到更复杂的语义关系,这是传统 LLM 难以实现的。

LCM 的概念级建模通过将语义单元表示为抽象的概念,提升了模型的理解和生成能力。每个概念通常通过句子嵌入进行编码,使得 LCM 能够在上下文理解和语义表达上实现更高效的操作。这种抽象性使得 LCM 可以跨越语言和模态的限制,提供更灵活的解决方案。

LCM 的开发涉及多个关键技术和创新点,这些技术的融合使得 LCM 在处理复杂任务时表现出色。

在 LCM 中,一个“概念”通常代表一整句话。这种定义允许 LCM 利用现有的句子嵌入空间(SONAR),支持超过 200 种语言的处理,涵盖了文本与语音两种模态。通过这样的设计,LCM 能够在更高的语义层次上进行建模。

LCM 的模型设计依托于 SONAR 嵌入空间进行训练,以实现自回归句子预测。初步实验中,LCM 使用了 1.6B 参数的模型,训练数据规模达到了 1.3 万亿 tokens。后续还将扩展到 7B 参数,训练数据达到 7.7 万亿 tokens。

LCM 的多模态和多语言能力使其在许多应用场景中表现出色,特别是在生成任务和跨语言任务中。

LCM 展示了卓越的零样本泛化能力,尤其是在多语言环境下的表现优于同等规模的现有 LLM。这使得 LCM 在摘要生成和扩展等任务中具有显著的优势。

为了促进社区研究,Meta 已经开源了 LCM 的训练代码。研究者可以在 GitHub 上获取相关资源并进行进一步的开发和优化。

LCM 的方法探索涵盖了多种生成策略和模型优化手段,其中包括 MSE 回归和基于扩散的生成变体。

基于均方误差 (MSE) 的训练方法被称为 base_lcm,这一实现已在代码仓库中提供。通过 MSE 回归,LCM 能够在生成任务中实现更高的精度和效率。

使用扩散机制的生成模型称为 two_tower_diffusion_lcm,该模型同样在代码发布内容中包含。扩散机制的引入为 LCM 提供了更强的生成能力。

LCM agent 的开发涉及多个步骤,从配置模块驱动到代码编译和烧写,每一步都需要精细的操作和调试。

在 kernel 和 lk 中配置 LCM 模块驱动相关文件是开发的基础步骤。开发者需要在相应的目录中更新 .c 和 .mk 文件,并将 LCM 添加到配置文件中。

完成模块配置后,开发者需要通过特定的编译命令生成可执行代码,并使用 Smart phone Flash Tool 进行烧写。这一过程要求开发者熟练掌握工具使用和命令行操作。

source build/envsetup.sh

lunchfull_hq6737t_66_1hg_m-eng

make -j13 2>&1 | tee build.logLCM 的高层次概念建模和多模态处理能力为 AI 领域带来了新的可能性。未来,随着技术的不断进步和社区的深入研究,LCM 有望在更多应用场景中发挥重要作用。

LCM 的抽象语义表示可能成为自学习 AI 的重要里程碑。凭借其在复杂任务中的灵活性和高效性,LCM 将为 AI 系统的思考与推理能力带来全新突破。

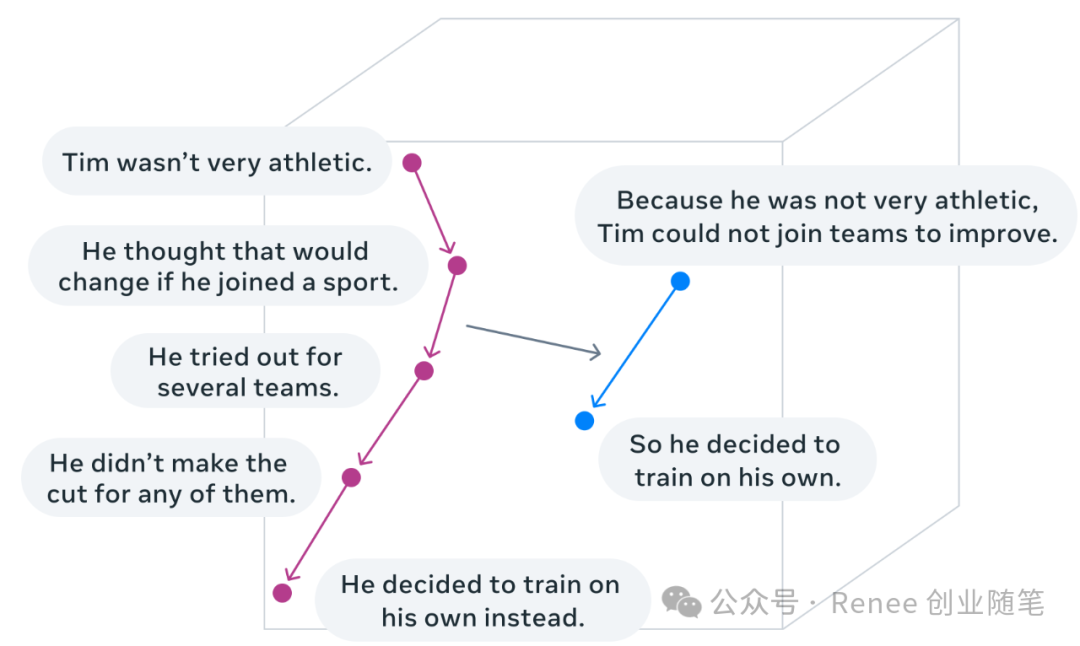

LCM 的设计理念超越了传统 token 操作,为模型在复杂任务中的灵活性提供了更多可能。其在潜在空间中规划概念,再将其具体化为语言的模式,使得 LCM 更加接近人类思维的模拟。

LCM,即 Large Concept Models,是一种新型 AI 模型,旨在通过高维嵌入空间和概念级建模提高多模态和多语言任务的处理能力。

LCM 不再依赖离散的 token 序列,而是在语义嵌入空间中建模,并通过概念级建模实现更高效的语义理解和生成。

Meta 已经在 GitHub 上开源了 LCM 的训练代码,开发者可以访问 LCM 开源项目 获取相关资源。

LCM 在生成任务、摘要生成与扩展、跨语言任务等多领域展现了卓越的性能,尤其在多语言环境下的表现优于同等规模的现有 LLM。

LCM 的开发涉及模块驱动配置、代码编译和烧写。开发者需要在 kernel 和 lk 中配置相关文件,并使用编译命令和工具进行调试和部署。