Stable Diffusion Agent 开发:技术解析与应用前景

Stable Diffusion是一个基于深度学习的图像生成模型,通过调用其API,我们可以实现多种图像生成任务。本文将详细介绍如何调用Stable Diffusion的API,包括环境设置、请求构建、参数配置等。我们将通过具体的代码示例和图片链接来帮助读者更好地理解和应用。

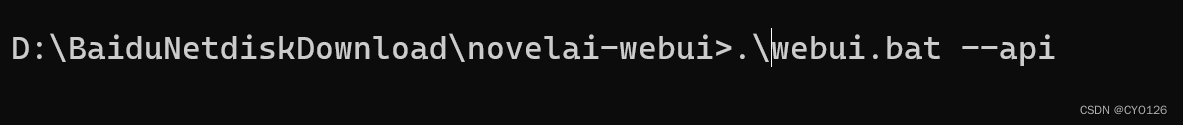

在开始调用API之前,我们需要首先部署Stable Diffusion的Web-UI环境。部署环境是调用API的基础,确保你拥有可以运行的本地接口。以下是部署步骤:

webui-user.bat文件来启动Web-UI,在启动时添加--api参数以开启API接口。http://localhost:7860/docs检查接口是否正常启动。

如果成功启动,你将看到API文档,可以使用其中的功能进行测试。

API请求是Stable Diffusion图像生成的重要步骤。通过构建正确的请求,我们可以生成所需的图像。以下是构建请求的步骤:

import requests

url = "http://127.0.0.1:7860/sdapi/v1/txt2img"

payload = {

"prompt": "puppy dog",

"steps": 5

}

response = requests.post(url=url, json=payload)

r = response.json()

print(r)这段代码通过POST请求发送prompt参数生成图像。如果得到的响应是一串长乱码,说明请求成功,你收到的是图像文件的Base64编码。

import io

import base64

from PIL import Image

r = response.json()

for i in r['images']:

image = Image.open(io.BytesIO(base64.b64decode(i.split(",", 1)[0])))

image.save('output.png')该代码段用于解码响应中的图像数据并保存为本地文件。确保在运行前安装PIL库。

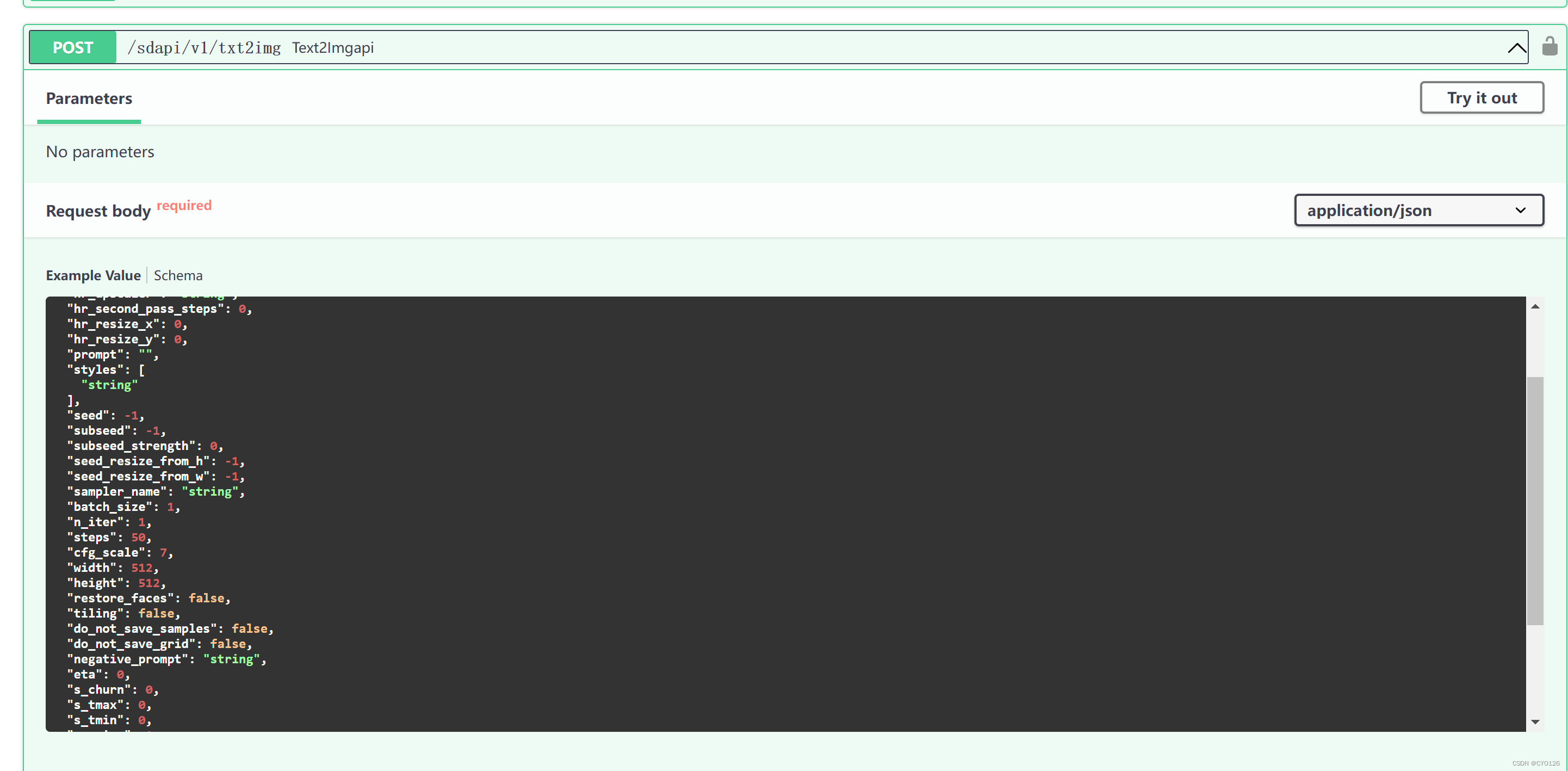

Stable Diffusion API提供丰富的参数选项,用户可以根据需求调整生成参数以得到期望的结果。

以下是一个完整的请求示例:

{

"prompt": "a cat sitting on a couch",

"negative_prompt": "blurred background",

"steps": 50,

"width": 512,

"height": 512,

"cfg_scale": 7,

"sampler_name": "Euler"

}生成的图片可以通过API响应获得,并可以保存到本地进行查看和使用。以下是处理图片的代码示例:

import base64

from PIL import Image

import io

response = requests.post(url, json=payload)

image_data = response.json()["images"][0]

image = Image.open(io.BytesIO(base64.b64decode(image_data.split(",", 1)[0])))

image.save("generated_image.png")确保你安装了PIL库来处理图片数据,并检查图片是否正确保存。

在调用API的过程中,可能会遇到一些常见的问题,以下是一些解决方案:

如果收到{'detail': 'Not authenticated'}的错误信息,需要在请求中添加身份验证头:

headers = {

"Authorization": "Basic YWFhYTphYWFh"

}

response = requests.post(url, json=payload, headers=headers)确保你的Web-UI和API服务在同一网络下,并且端口未被占用。

Stable Diffusion Web-UI支持多种插件和扩展,可以通过API调用来丰富你的应用场景。

ControlNet是一个强大的扩展工具,可以通过附加参数来增强生成图像的控制力。

{

"alwayson_scripts": {

"controlnet": {

"args": [

{

"enabled": true,

"model": "control_v11p_sd15_softedge",

"input_image": "base64SrcImg"

}

]

}

}

}通过设置ControlNet参数,可以大幅提高图像生成的细节控制能力。

Stable Diffusion API为图像生成提供了极大的灵活性和多样性。通过正确的环境配置和参数设置,我们可以生成期望的高质量图像。本文详细介绍了从环境部署到API请求的全过程,并提供了代码示例和常见问题的解决方案,希望能为你的开发工作提供帮助。

问:如何解决API请求中的身份验证问题?

问:生成的图像质量不高,如何改善?

问:如何在请求中指定不同的采样方法?

问:收到的响应是一串乱码,该如何处理?

问:如何使用ControlNet增强图像生成?