Stable Diffusion Agent 开发:技术解析与应用前景

在人工智能迅速发展的浪潮中,智能对话机器人成为了一个引人注目的焦点。随着大规模语言模型(LLMs)的崛起,它们在知识表达和任务规划方面展现出的潜力让人们看到了将语言计划与机器人操作结合的广阔前景。然而,将这些模型的推理能力与物理世界的操作结合,依然是一个亟待解决的挑战。本文介绍了一种名为GLiDE(Grounding Language in Demonstrations)的新框架,它通过反事实扰动的方式,将语言计划与机器人演示的学习相结合,为执行复杂任务的机器人提供了新的思路。

在智能对话机器人的研究中,语言模型被赋予了极大的期望。然而,如何将这些模型的知识转化为具体的机器人行为,尤其是在多步骤任务中,是一个巨大的挑战。传统方法主要依赖于符号空间中直接利用LLMs生成行动计划,或者依靠手动定义的高层抽象来实现。这些方法虽然直观,但在实际应用中常常需要预先定义技能和工具,这使得适应性和灵活性大打折扣。

为了克服这些局限性,GLiDE框架应运而生。通过将语言计划与机器人演示的轨迹结合,GLiDE能够从语言中提取任务结构,并将其映射到具体的物理动作上。这种方法的核心思想是将动作抽象为模式家族,这些模式通过特定的运动约束将机器人配置进行分组,从而在高层语言表示与低层物理轨迹之间建立抽象层。

GLiDE框架的提出,不仅是对传统语言模型的一次突破,更是为机器人与人类更自然的互动提供了可能。通过分析反事实扰动,GLiDE可以在不直接依赖手动定义技能的情况下,生成适应性强的任务计划。这意味着,在没有明确指明具体步骤的情况下,机器人也能通过语言指令执行复杂任务。

这种创新不仅提升了智能对话机器人的操作能力,也为未来更多的语言与行动结合的研究提供了新的方向。GLiDE框架通过反事实扰动生成的计划,能够适应不同的任务环境和需求,从而为机器人执行复杂任务提供了新的思路。

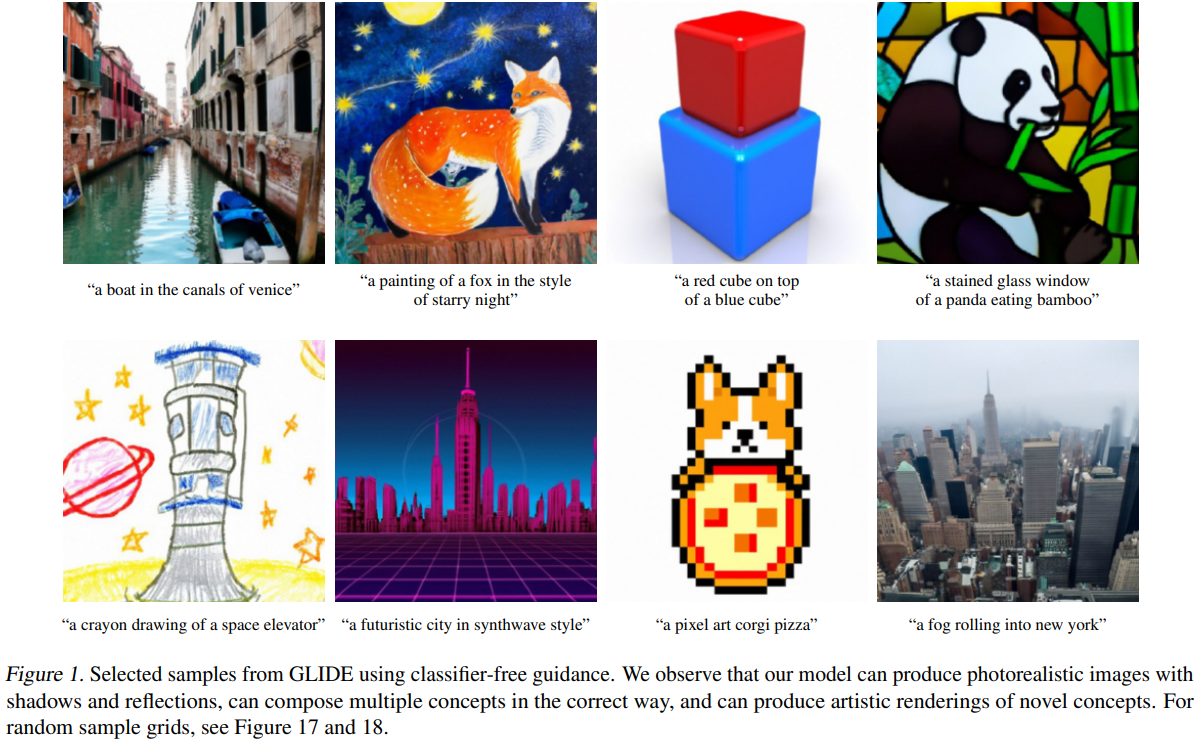

在文本条件图像生成领域,GLiDE同样展现了其强大的能力。扩散模型最近被证明可以生成高质量的合成图像,特别是在结合引导技术后,能够在牺牲多样性来换取更高保真度的情况下,生成逼真的图像。利用GLiDE框架,这些图像的生成变得更为高效且具有更高的语义合理性。

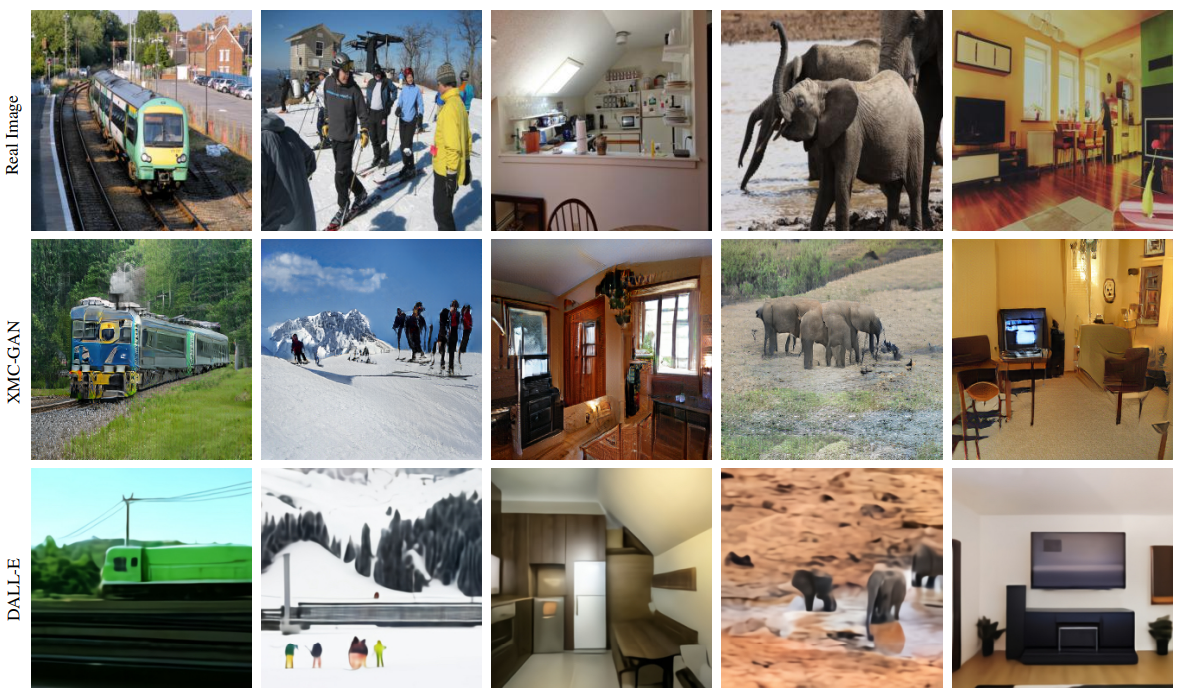

在图像生成中,GLiDE模型通过无分类器指导能够生成更高质量的图像样本。相比于使用CLIP重新排序的DALL-E样本,GLiDE生成的图像在真实感和字幕相似性方面更受人类评估者的青睐。

GLiDE的方法论涉及多个方面,包括64×64分辨率训练的35亿参数文本条件扩散模型,以及另一个15亿参数文本条件上采样扩散模型。通过这些模型,GLiDE能够以文本为条件生成高质量的图像,并通过微调支持无条件图像生成。

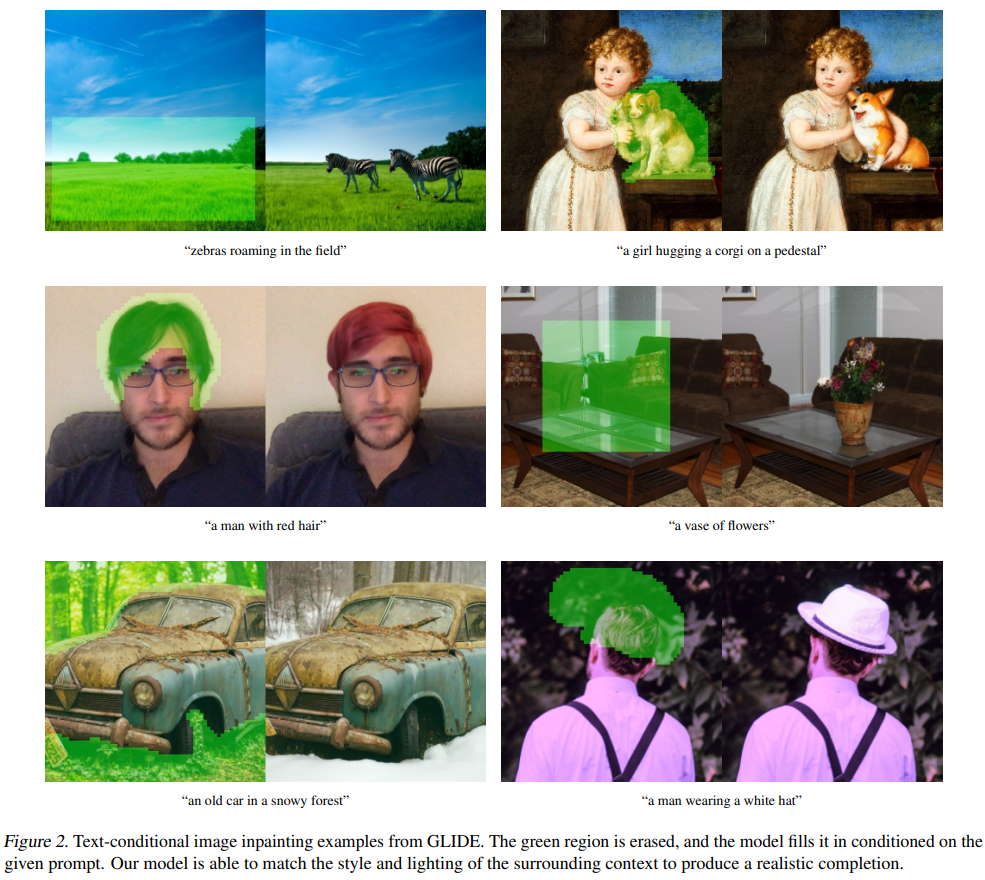

在图像绘画任务中,GLiDE通过对模型的微调,能够在采样过程中处理噪声和上下文不一致的问题。这使得模型能够在采样后更好地匹配图像的已知区域,从而生成更精确的图像修复结果。

在实验中,GLiDE展示了其在图像生成与修复方面的突出表现。通过对比不同模型的生成结果,GLiDE展现了其独特的优势。例如,在MS-COCO提示上的随机图像样本中,GLiDE能够在没有CLIP重新排序或挑选的情况下,生成高质量的图像。

尽管如此,GLiDE也有其局限性。例如,在处理非常不寻常的对象或场景时,模型可能无法完全捕捉描述的所有细节。同时,GLiDE的采样过程耗时较长,这也是当前许多扩散模型面临的共同挑战。

GLiDE的出现,为智能对话机器人在实际应用中的发展提供了新的可能。通过将语言计划与机器人演示结合,机器人能够更好地理解复杂的指令,并在不同情境下执行相应的任务。

这种能力不仅提升了机器人的自动化水平,也使其在各种场景中具有更高的适应性。无论是家庭助手还是工业自动化,GLiDE在智能对话机器人中的应用前景都十分广阔。

GLiDE框架的提出,为智能对话机器人在语言理解与行动执行上的结合提供了新的可能。通过反事实扰动与演示的结合,GLiDE不仅提升了语言模型的实用性,也为未来更多的研究方向提供了参考。

在未来,随着计算能力的提升和算法的优化,GLiDE有望在更多领域中得到应用,为人类与机器人之间的沟通与协作搭建更为自然的桥梁。

问:GLiDE框架的核心优势是什么?

问:GLiDE在图像生成中有什么突破?

问:GLiDE在智能对话机器人中有哪些应用前景?