API是什么?深入解析API及其应用

在现代深度学习中,全连接层(Fully Connected Layer)扮演着关键角色。本文将详细探讨全连接层的结构、功能及其在神经网络中的重要性,并结合实际应用案例来加深理解。

全连接层是神经网络中一种较为基础的层结构。它的特点是层中的每一个神经元都与前一层的所有神经元相连接。这种全连接的结构使得它能够很好地捕捉和表征数据的全局特征。

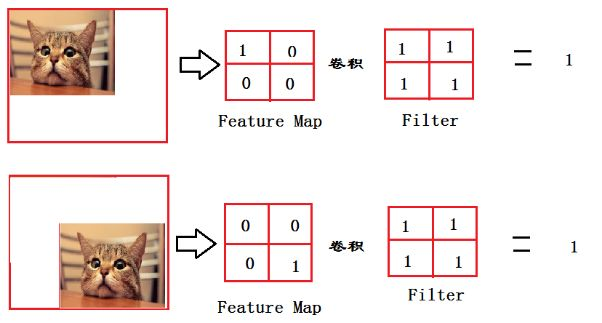

在全连接层中,输入数据通过权重矩阵进行线性变换,然后通过激活函数进行非线性变换,从而实现对输入数据的复杂映射。这使得全连接层能够对输入数据进行特征提取和模式识别。

全连接层的核心在于其权重矩阵。假设输入为一个向量 ( x ),权重矩阵为 ( W ),则输出 ( y ) 可以表示为:

import numpy as np

def fully_connected_layer(x, W, b):

return np.dot(W, x) + b其中,( b ) 为偏置向量。这个线性变换过程可以帮助模型捕捉输入数据的线性关系。

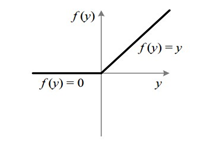

在全连接层中,激活函数可以提供非线性能力,使得网络能够拟合复杂的函数关系。常见的激活函数包括 ReLU、sigmoid 和 tanh。

激活函数的选择对模型的性能有很大影响,需根据具体任务进行选择。

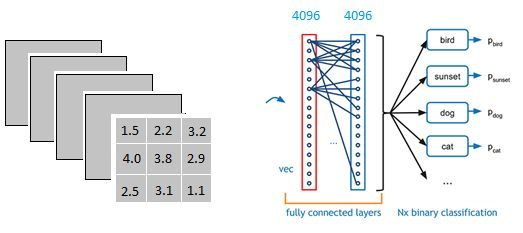

VGG网络是一种经典的深度卷积神经网络,它在最后几层使用了多个全连接层来进行分类任务。例如,在 VGG-16 中,最后一层卷积的输出为7x7x512,而全连接层的输出则是一个4096维的向量。

这种设计使得 VGG 网络能够很好地提取图像的高层语义特征,并进行有效的分类。

ResNet引入了残差连接(Residual Connection),并在某些版本中用全局平均池化(GAP)替代了全连接层,从而减少参数量并提升模型性能。

这种设计不仅提高了模型的训练速度,而且在某些任务上也提高了准确性。

一种有效的减少全连接层参数量的方法是使用全局平均池化(Global Average Pooling,GAP)替代全连接层。这种方法不仅减少了参数量,还能提高特征的全局性。

正则化技术(如L2正则化、Dropout等)是防止过拟合的有效手段。通过在训练过程中引入惩罚项,可以限制模型的复杂度,从而提高模型的泛化能力。

通过调整全连接层的层数和每层的神经元数量,可以在模型复杂度和计算效率之间取得平衡。通常情况下,较少的神经元和层数可以减少参数量,但可能会降低模型的表达能力。

在图像分类任务中,全连接层通常位于网络的末端,负责将卷积层提取的特征进行分类。以猫的分类任务为例,全连接层可以通过对输入图像的特征进行加权求和,最终输出一个概率值,表示图像中包含某个类别的可能性。

在这个过程中,全连接层的作用就如同一个“决策者”,负责将前一层提取的复杂特征进行整合,从而做出最终的判断。

在自然语言处理(NLP)任务中,全连接层同样发挥着重要作用。例如,在文本分类任务中,全连接层可以将前一层提取的文本特征进行整合,并输出分类结果。

在这种任务中,全连接层的设置(如层数、神经元数量、激活函数等)需要根据具体任务需求进行调整,以达到最佳效果。

全连接层是神经网络中一种基本的层结构,特点是层中的每一个神经元都与前一层的所有神经元相连接。它常用于特征整合和分类任务。

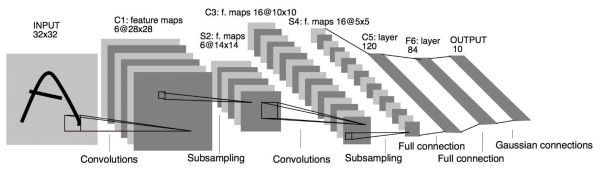

卷积层主要用于局部特征提取,而全连接层用于全局特征整合。因此,卷积层通常放在网络的前部,而全连接层通常放在后部,用于最终的分类或回归任务。

可以通过使用正则化技术(如L2正则化、Dropout等)来减少过拟合。此外,适当减少层数和神经元数量,以及使用数据增广等方法也有助于提高模型的泛化能力。

全连接层的参数量直接影响模型的复杂度和计算效率。过多的参数可能导致过拟合,而过少的参数可能导致模型表达能力不足。因此,需在参数量和模型性能之间取得平衡。

全局平均池化(GAP)可以减少模型的参数量,从而减少过拟合的风险。此外,GAP能够提高特征的全局性,有助于提升模型在某些任务上的表现。

本文通过详尽的例子和分析,帮助您理解全连接层在深度学习中的角色及其重要性。无论是在图像处理还是自然语言处理任务中,全连接层都扮演着不可或缺的角色。