Stable Diffusion Agent 开发:技术解析与应用前景

在现代科技的快速发展中,AI Agent 的开发和集成已经成为企业数字化转型的重要策略之一。特别是随着大模型的不断进化,如何有效地利用这些模型来简化复杂任务,并将其无缝集成到企业的生产环境中,是开发者和企业共同关注的焦点。本文将详细探讨如何利用 FLUX.1-dev 进行 AI Agent 的开发,从提示工程到流程工程的演变,以及如何通过上下文缓存技术提升工作流的性能与稳定性。

随着大模型的崛起,AI 开发模式从提示工程(Prompt Engineering)逐渐向流程工程(Workflow Engineering)演进。提示工程主要通过优化输入提示词以提高模型表现,但这种方式在处理复杂任务时显得力不从心,尤其是当推理链较长时,调试和排错的难度显著增加。

流程工程则不同,它将复杂任务拆分为多个模块,每个模块负责特定的任务,串联形成完整的工作流。通过模块化处理,开发者可以逐步分析和优化各个环节,降低对单一模型推理能力的依赖,提高系统的稳定性和可维护性。例如,在某些编程任务中,传统提示工程的解题成功率可能只有 19%,而使用流程工程将任务拆解后,成功率可提升至 44%。这充分说明了流程工程在处理复杂任务中的优势。

FLUX.1-dev 是一个强大的工具集,为 AI Agent 的开发提供了丰富的功能。它不仅支持多种控制模式,还可以与其他工具结合使用,形成更复杂的应用场景。其开发环境灵活且易于扩展,开发者可以根据需求定制工作流,实现高效的 AI 应用。

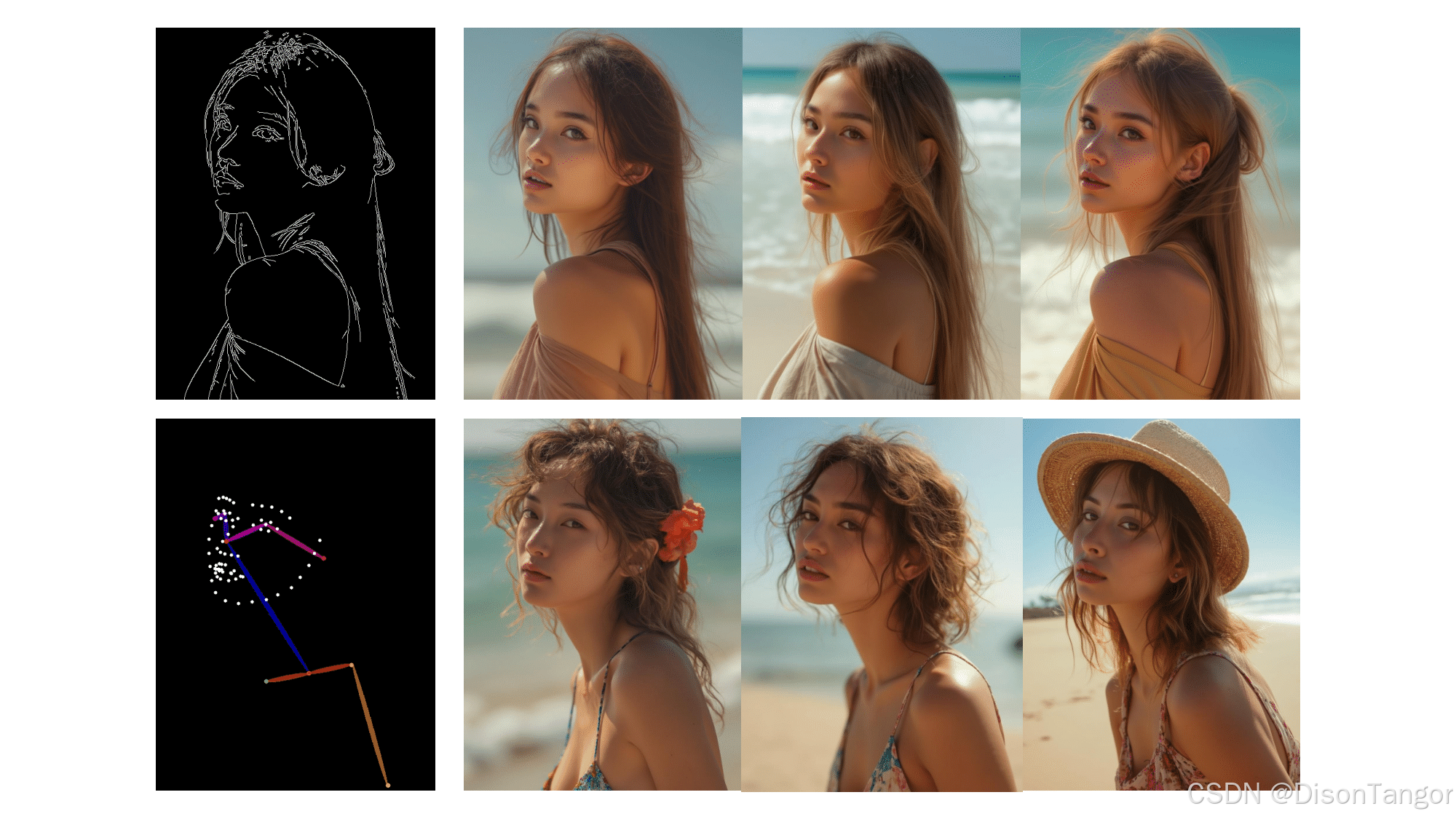

FLUX.1-dev 支持多达七种控制模式,包括 canny、tile、depth、blur、pose、gray 和 low quality。这些模式使得开发者可以根据具体应用场景选择合适的控制模式,达到最佳的效果。

FLUX.1-dev 的设计考虑了与其他 ControlNets 的兼容性,开发者可以轻松将其与现有的工具和模型集成,扩展应用的功能和性能。这种灵活性使得 FLUX.1-dev 成为开发复杂 AI Agent 的理想选择。

在实际开发中,Moonshot API 提供了一种简单而高效的方式来构建 AI 工作流。开发者只需将相关文档内容传递给大模型,通过 HTTP 请求模块传递请求信息,模型便能根据文档内容自动判断并回答问题。

以下是一个简单的 Moonshot API 工作流示例:

import requests

url = "https://moonshot.api/answer"

headers = {

"Content-Type": "application/json",

"Authorization": "Bearer YOUR_API_KEY"

}

data = {

"prompt": "请根据以下文档内容回答问题:文档内容..."

}

response = requests.post(url, headers=headers, json=data)

print(response.json())通过这样简化的工作流,开发者可以轻松构建基于大模型的自动问答系统。

随着任务复杂度的增加,单纯依赖大模型处理所有上下文信息的效率会显著降低。上下文缓存技术通过缓存公共的上下文部分,减少重复计算的开销,显著提升了系统的响应速度。

这种方式显著减少了模型推理的延迟,同时节省计算资源和成本。

随着上下文缓存技术的成熟,AI Agent 工作流的效率和稳定性将进一步提升。未来,随着模型的扩展和新技术的引入,我们可以期待更多基于流程工程的创新应用,例如:

使用 FLUX.1-dev 和 Moonshot API 构建 AI 工作流不仅提升了任务处理的效率,也大大降低了开发和维护的复杂性。流程工程通过模块化处理复杂任务,结合上下文缓存技术,开发者可以更高效地开发智能应用,并在多个领域中推动 AI 技术的应用落地。

未来,随着上下文缓存、流程工程等技术的不断发展,AI Agent 将在更多场景中展现其强大的能力,为开发者和企业提供更智能的解决方案。

问:什么是上下文缓存技术?

问:FLUX.1-dev 支持哪些控制模式?

问:如何在 Moonshot API 中使用上下文缓存技术?

问:流程工程如何提高任务处理效率?

问:如何获取 SiliconFlow 的 API Key?