DeepSeek Janus-Pro 应用代码与图片链接实践

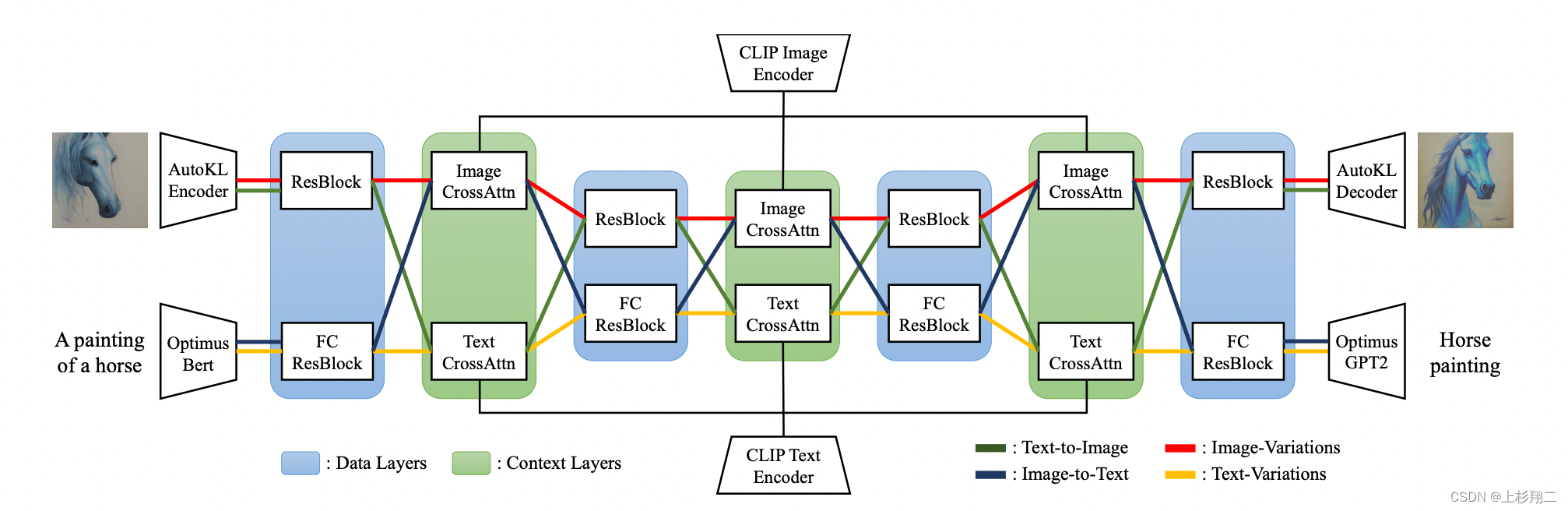

在当今的深度学习领域,AltDiffusion技术通过其卓越的多语言处理能力和高效的推理速度,正吸引越来越多的关注。本文将详细探讨AltDiffusion的应用与实现,深入了解其背后的技术原理,并展示相关代码示例,帮助读者更好地掌握这一前沿技术。

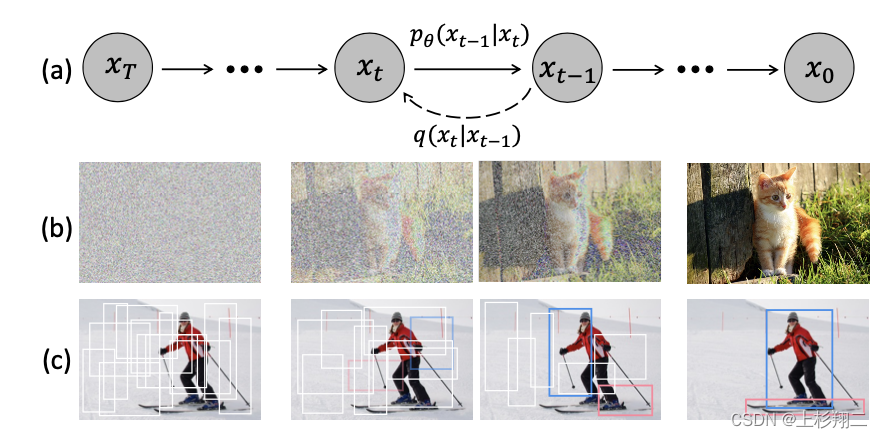

AltDiffusion是一种新颖的推理方法,基于扩散过程来实现多语言环境下的高效推理。这一方法通过引入随机扰动,提升了模型的语义理解能力和输出的多样性,特别是在处理多语言输入时表现出色。AltDiffusion结合了键模型迁移技术,使得不同语言之间的语义差异得以有效解决。

AltDiffusion通过其独特的多语言处理能力,能够同时支持多达九种语言的输入和输出。这一特性得益于其在WuDao 和 LAION 数据集上的训练,使得模型在中文和其他语言的语义理解上表现优异。AltDiffusion的多语言能力不仅体现在文本生成上,还在图像生成和图像-文本对齐任务中展现出强大优势。

在AltDiffusion中,键模型迁移是实现多语言处理的重要技术。通过将源模型的知识迁移到目标模型上,AltDiffusion能够在不增加计算复杂度的情况下显著提升目标模型的性能。这种迁移通常是通过将一个模型的权重参数作为初始化参数传递给另一个模型来实现的。

键模型迁移技术的核心在于有效利用源模型的权重参数。在AltDiffusion的训练过程中,源模型被称为“键”模型,而目标模型则是“迁移”模型。通过这种方式,模型能够在不同语言之间实现快速的语义迁移和知识共享。

import torch

source_model_weights = torch.load('source_model.pth')

target_model = MyModel()

target_model.load_state_dict(source_model_weights)多语言AltDiffusion在推理过程中,通过在模型内部表示中引入梯度噪声,显著提高了推理速度。这种方法不仅提升了模型的生成能力,还保证了输出的多样性和创造性。在多语言环境下,AltDiffusion能够处理不同语言之间复杂的语义差异。

AltDiffusion的推理过程通过引入随机扰动,生成更加多样化的输出。这一过程通过在模型的内部表示中施加梯度噪声,实现了对多语言输入的有效处理。推理速度的提高也使得AltDiffusion在实际应用中更具优势。

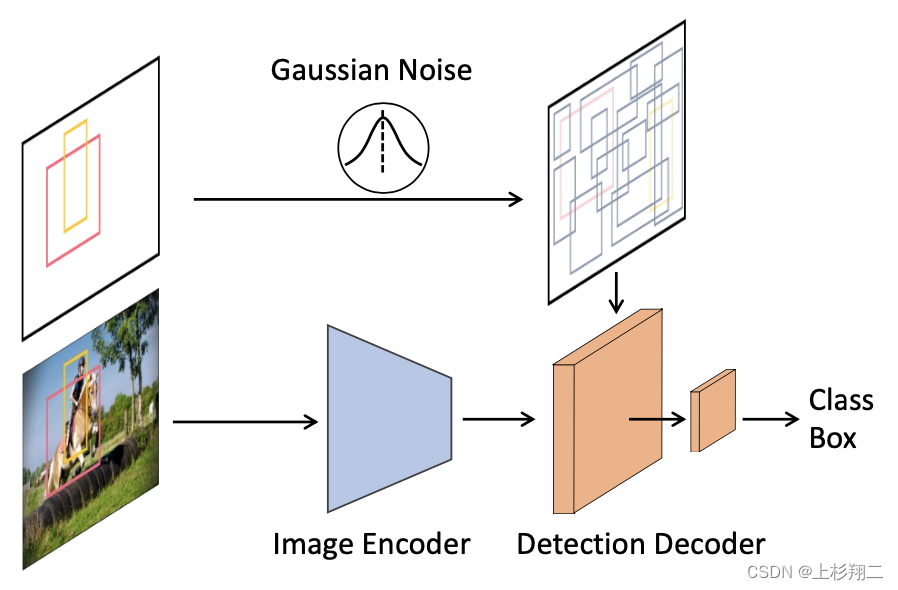

随着AltDiffusion技术的不断发展,它逐渐被应用于目标检测任务中。通过将目标检测视为一个去噪扩散过程,AltDiffusion能够以更加灵活的方式处理检测任务。其动态框设计使得模型能够在不同的检测场景中灵活调整精度和速度。

在目标检测任务中,AltDiffusion通过将噪声框逐步去噪为真实目标框,实现了对目标的精准识别。这一过程不仅提高了目标检测的准确性,还显著减少了模型的训练时间。

def train_loss(images, gt_boxes):

"""

images: [B, H, W, 3]

gt_boxes: [B, *, 4]

"""

feats = image_encoder(images)

pb = pad_boxes(gt_boxes)

pb = (pb * 2 - 1) * scale

t = randint(0, T)

eps = normal(mean=0, std=1)

pb_crpt = sqrt(alpha_cumprod(t)) * pb + sqrt(1 - alpha_cumprod(t)) * eps

pb_pred = detection_decoder(pb_crpt, feats, t)

loss = set_prediction_loss(pb_pred, gt_boxes)

return lossAltDiffusion的应用不仅限于图像生成和目标检测,它在视频生成领域同样展现出强大的潜力。通过自回归潜在扩散模型,AltDiffusion能够生成连续帧的图像,保证视频内容的连贯性和高质量。

自回归潜在扩散模型利用历史帧的信息指导当前帧的生成,确保生成视频的连续性和一致性。这一方法通过对每一帧进行独立生成,大幅提升了视频生成的灵活性。

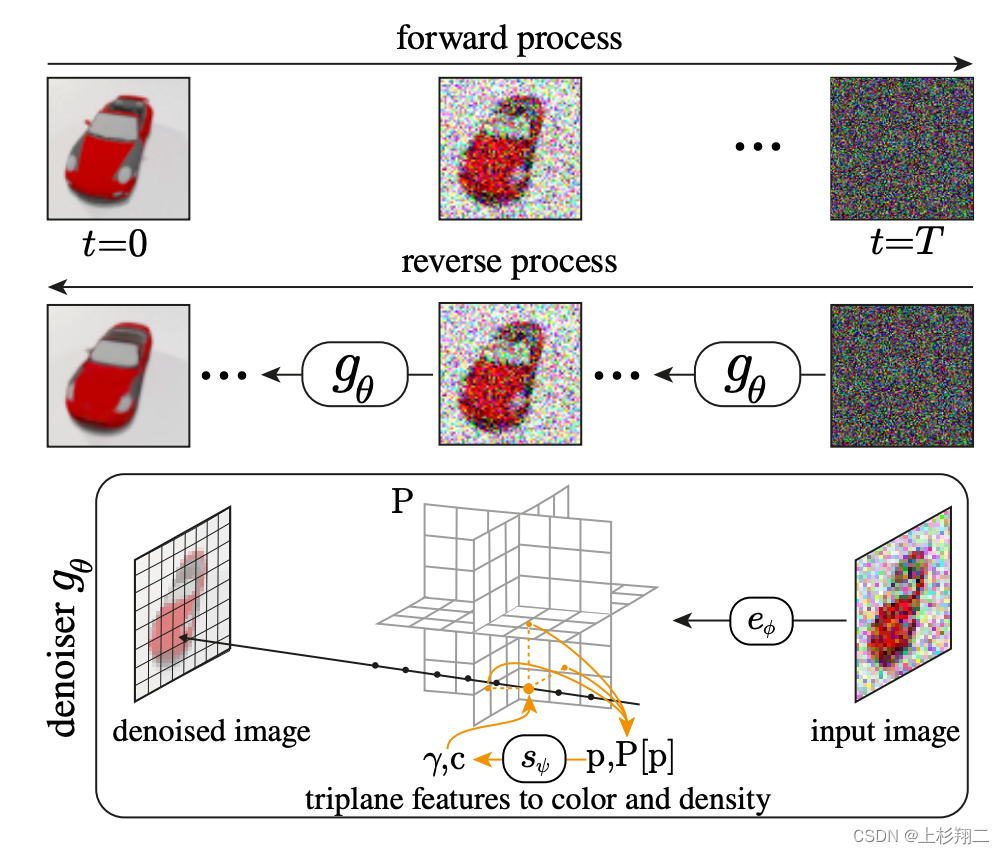

在3D场景生成领域,AltDiffusion通过将3D结构引入到传统的2D扩散中,实现了3D场景的高效生成和推理。通过体积渲染,AltDiffusion能够在每个去噪步骤中生成并渲染场景的中间三维表示。

AltDiffusion在3D场景生成中,通过在图像去噪架构中引入3D表示,实现了对3D场景的高精度生成。体积渲染过程不仅提高了生成的真实感,还增强了模型的泛化能力。

随着AltDiffusion技术的不断完善,其应用领域将不断扩展。未来,AltDiffusion将在更多的计算机视觉任务中展现出强大的潜力,为多语言环境下的应用提供更为高效的解决方案。

AltDiffusion的多语言处理能力和高效的推理速度,使其在多模态生成、图像编辑等任务中具备广阔的应用前景。随着技术的不断进步,AltDiffusion有望成为多语言环境下的标准推理方法。

问:AltDiffusion如何提升多语言处理能力?

问:AltDiffusion在目标检测中有哪些优势?

问:AltDiffusion是否可用于视频生成?

问:如何在3D场景生成中应用AltDiffusion?

问:未来AltDiffusion的发展方向是什么?