DeepSeek Janus-Pro 应用代码与图片链接实践

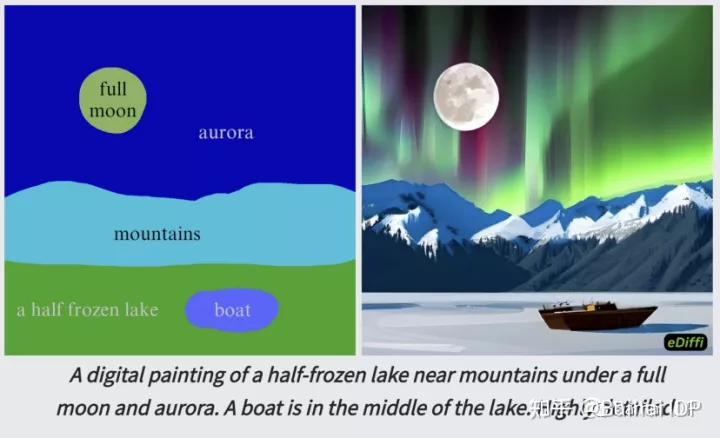

Nvidia的eDiff-I模型以其独特的图像合成算法获得了广泛关注。作为一款新一代生成性人工智能内容创作工具,eDiff-I在图像生成领域中展现了强大的文转图功能。其开发者在最近发表的论文中指出,目前的图像合成算法在很大程度上依赖于文本提示来生成对应的图像信息,而eDiff-I通过一系列的去噪过程,将图像合成任务转化为生成高度逼真的图片。这种方法有效地提升了图像生成的质量和控制力。

eDiff-I模型通过三个扩散模型组成的合成管道来实现图像生成:一个低分辨率扩散模型用于生成64×64分辨率的样本,以及两个高分辨率扩散模型分别将图像上采样到256×256和1024×1024分辨率。这一过程利用了T5 XXL嵌入和CLIP图像编码,使得生成的图像在风格和细节上更为丰富。

此外,eDiff-I提供了风格转移功能,使用户能够使用参考图像的风格来控制生成图案的风格。这一功能对于需要特定场景的用户提供了极大的便利。

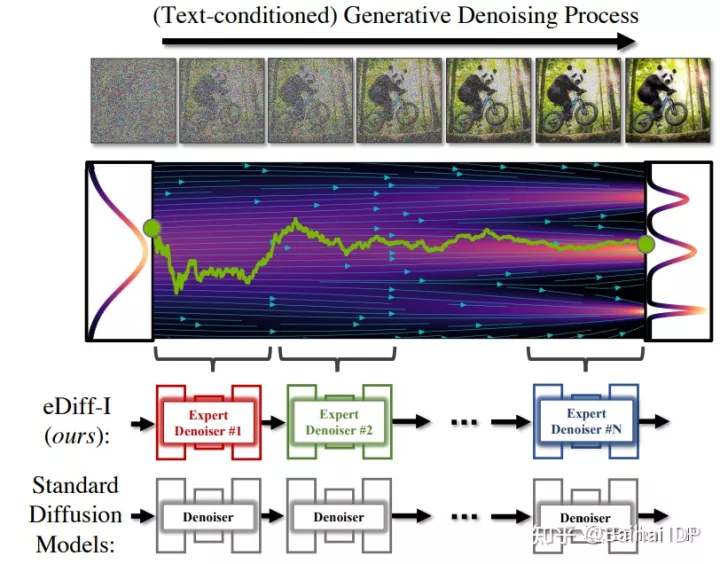

在图像生成过程中,去噪是一个关键步骤。eDiff-I通过引入一组专门用于不同阶段的去噪器集合,显著提高了图像生成的质量。传统的生成模型通常在整个去噪过程中使用同一个去噪器神经网络,而eDiff-I则在生成过程的不同时期内训练专门的去噪器。这样的“专家级去噪器”策略为合成图像的质量提供了保障。

Deepgram的首席执行官Scott Stephenson指出,这种创新方法可以被应用到DALL-E或Stable Diffusion的新版本中,以提高图像的合成质量和控制能力。

与同时代的产品如DALL-E 2和Imagen相比,eDiff-I在同一模型中使用了两个编码器,这一架构使它能够从相同的文本输入中生成大量不同的视觉效果。CLIP编码器为图像提供了风格化的效果,而T5文本嵌入则根据文本信息生成更精确的内容。两者的结合使得eDiff-I在合成输出上表现出色。

研究表明,eDiff-I在Frechet Inception Distance(FID)的评估中表现优于其竞争对手。其在MS-COCO等标准数据集上的评估结果也显示出CLIP+T5的组合优于单独使用任何一种编码器。

生成式AI虽然带来了艺术表达的普及,使用户能够轻松创建高质量的图像,但也面临着一些挑战。当前的大规模文转图生成模型的训练数据集往往未经筛选,可能包含偏差。模型可能反映出这些偏差,因此需要通过收集更具代表性的数据或使用偏差校正方法来抵消这些偏差。

此外,生成图像的真实度和控制能力是另一个挑战。Nvidia表示,可以通过自动验证图像真实性和检测伪造内容来应对这些挑战。

尽管现有的文转图模型已经取得了显著进展,但仍缺乏理解现实所需的先验条件。reVolt公司的创始人Kyran McDonnell认为,下一代的文转图架构,如eDiff-I,将解决目前的许多问题,并为生成式AI的应用开辟更多的领域。

未来,生成模型可以根据品牌风格和“氛围”进行训练,创造出无限的创意,为企业应用提供广阔的空间。生成式AI仍在等待它的“辉煌时刻”。

eDiff-I模型的成功不仅体现在图像生成上,也为智能对话机器人的发展提供了新的思路。通过将文生图技术与自然语言处理结合,智能对话机器人可以更直观地理解用户需求,提供更准确的反馈。

视觉化理解:eDiff-I的图像生成能力使对话机器人能够通过图像提供用户反馈,增强交流的直观性。

个性化定制:通过分析用户的语音和文本输入,智能对话机器人可以生成个性化的图像内容,提升用户体验。

多模态交互:结合文本、语音和图像,智能对话机器人能够提供更加丰富的交互体验。

计算资源需求:高质量图像生成需要强大的计算能力,这对硬件环境提出了更高的要求。

数据偏差:如前所述,训练数据集中的偏差可能影响模型的生成效果,需要通过数据集优化来解决。

实时性:对话机器人的实时反馈能力是一个重要指标,如何在生成高质量内容的同时保证响应速度是一个挑战。

随着eDiff-I模型的不断进步,智能对话机器人将在多个领域展现其潜力。教育、医疗、电子商务等领域都将受益于这一技术的应用。在教育领域,机器人可以通过生成图像帮助学生更好地理解知识点;在医疗领域,机器人可以通过图像识别进行初步诊断;在电子商务中,个性化的商品推荐将成为可能。

问:eDiff-I与其他生成模型相比有什么优势?

问:如何解决生成式AI中的数据偏差问题?

问:eDiff-I在智能对话机器人中有哪些应用?

问:eDiff-I的去噪过程如何提升图像质量?

问:未来智能对话机器人的发展方向是什么?