PixVerse V3 API Key 获取:全面指南与实践

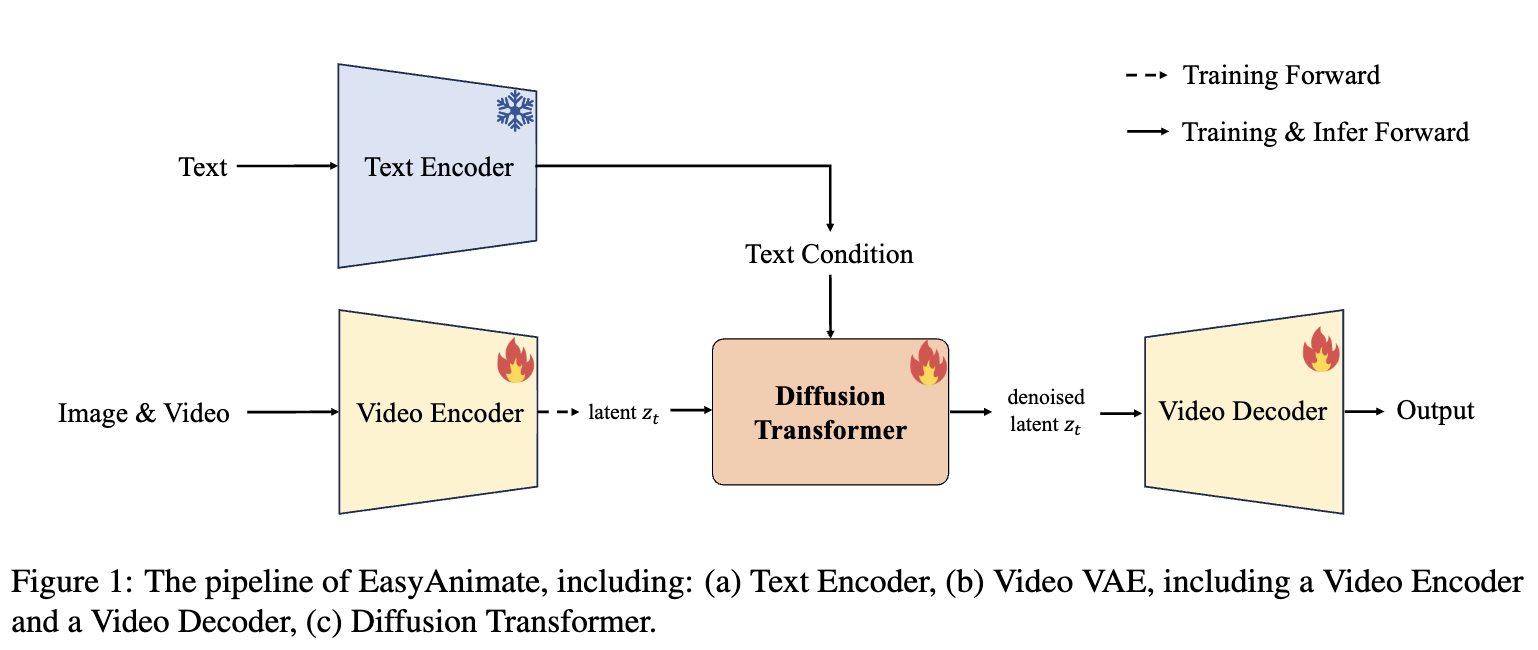

EasyAnimate 是一种用于视频生成的高级工具,基于 Transformer 架构,旨在实现高效的视频合成。它不仅扩展了原有的 DiT 框架,更通过引入运动模块来适应 3D 视频生成。这些特性使其在生成多风格视频时表现出色,能够处理不同帧速率和分辨率的图像和视频。

申请 EasyAnimate API 是一个简单而直接的过程。首先,用户需要在官方网站上注册一个账户,并填写相关的个人资料和用途说明。注册完成后,用户将收到一封确认邮件,其中包含 API 的详细说明和使用指南。

成功注册后,用户需在其账户中找到 API 申请页面,填写必要的申请表格。这些表格通常要求用户提供项目的详细信息,包括预期的使用场景、请求频率等。提交申请后,通常会在几个工作日内收到审批结果。

在使用 EasyAnimate API 时,有几点需要特别注意:

Diffusion Transformer 是 EasyAnimate 的核心组件之一。它通过扩散模型实现图像的去噪和生成,能够快速创建高分辨率的图像。与传统的 DDPM 模型相比,DiT 使用了更高效的采样器,减少了采样时间,同时提升了生成的质量。

Stable Diffusion 3 是 EasyAnimate 中的另一个重要组成部分。它通过引入自注意力机制,优化了文本信息的注入方式,使得生图质量更高,符合人类的偏好。Stable Diffusion 3 不仅提高了生成图片的质量,还通过减少计算量来提升模型的效率。

CogVideoX 是一款开源的视频生成模型,其特点在于使用了 3D VAE 结构,极大地降低了训练成本和难度。它在时间维度上能够更好地捕捉帧间关系,提升了视频的生成质量。

在 EasyAnimateV5 中,使用了约 10m 的 SAM 图片数据和 26m 的图片视频混合预训练数据进行模型训练,其支持图生视频、文生视频和视频生视频的生成。EasyAnimateV5 还具有以下特点:

在视频生成过程中,添加噪声可以大大提升生成效果。通过在非零参考图上添加噪声来破坏原图,追求更大的运动幅度。同时,利用正态分布生成噪声幅度,以确保噪声在合理范围内。

EasyAnimateV5 推荐使用 Docker 进行部署,这样可以避免环境配置问题。以下是使用 Docker 启动项目的基本步骤:

docker pull mybigpai-public-registry.cn-beijing.cr.aliyuncs.com/easycv/torch_cuda:easyanimate

docker run -it -p 7860:7860 --network host --gpus all --security-opt seccomp:unconfined --shm-size 200g mybigpai-public-registry.cn-beijing.cr.aliyuncs.com/easycv/torch_cuda:easyanimate

git clone https://github.com/aigc-apps/EasyAnimate.git

easyanimate

mkdir models/Diffusion_Transformer

mkdir models/Motion_Module

mkdir models/Personalized_Model通过 Gradio 提供的图形界面,用户可以轻松进行文生视频、图生视频和视频生视频的生成。用户只需选择合适的预训练模型,填写提示词,并调整所需的视频参数,即可生成所需视频。

问:如何申请 EasyAnimate API?

问:EasyAnimate 是否支持自定义模型?

问:如何提高生成视频的质量?

问:EasyAnimate 支持哪些格式的输入?

问:使用 EasyAnimate 时需要注意什么?

通过对 EasyAnimate 的全面介绍,希望读者能够更好地理解其功能和应用,充分利用其强大的视频生成能力。