大模型RAG技术:从入门到实践

图神经网络(Graph Neural Networks, GNNs)在处理图结构数据时表现出色,而邻接矩阵作为图的基础表示形式,在多阶传播中扮演着关键角色。本文将深入探讨邻接矩阵在多阶传播中的应用,并结合不同的图神经网络模型进行分析。

图神经网络是一类专门用于处理图结构数据的神经网络模型。它们通过对图中节点及其邻居进行特征聚合,实现信息的传播与表征。传统的GNN模型通常只在邻居层级上聚合信息,但在多阶传播中,信息可以在图中更远的范围内传播。

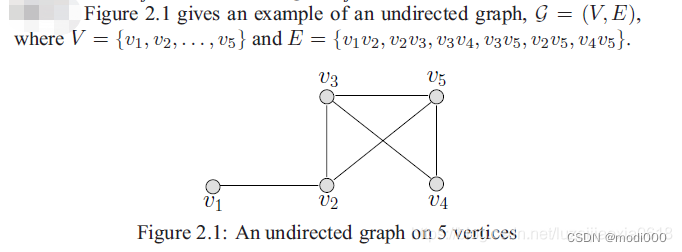

邻接矩阵是图论中的基本概念,用于表示图中顶点之间的连接关系。对于一个图G = (V, E),其中V是顶点集,E是边集,邻接矩阵A是一个n阶方阵(n为顶点数量),其元素A[i][j]表示顶点i到顶点j之间的边关系。

在图神经网络中,多阶传播能够捕获更远距离的节点信息,提高模型的表达能力。然而,传统的单层GNN架构在进行多阶传播时,容易导致节点特征过平滑的问题。为了解决这一问题,研究人员提出了多种改进方案。

DCNN是一种通过扩散卷积实现多阶传播的图神经网络模型。其核心思想是直接对每个节点采用多阶跳的矩阵进行表征,实现远程信息的聚合。

class NodeClassificationDCNN(object):

"""A DCNN model for node classification.

(K, X) -> DCNN -> Dense -> Out

"""

def __init__(self, parameters, A):

self.params = parameters

self.var_K = T.tensor3('Apow')

self.var_X = T.matrix('X')

self.var_Y = T.imatrix('Y')

self.l_in_k = lasagne.layers.InputLayer((None, self.params.num_hops + 1, self.params.num_nodes), input_var=self.var_K)

self.l_in_x = lasagne.layers.InputLayer((self.params.num_nodes, self.params.num_features), input_var=self.var_X)

def get_output_for(self, inputs, **kwargs):

Apow = inputs[0]

X = inputs[1]

Apow_dot_X = T.dot(Apow, X) # 公式中P与X的相乘

Apow_dot_X_times_W = Apow_dot_X * self.W

out = self.nonlinearity(Apow_dot_X_times_W)

return outDAGCN通过在注意力机制中引入多跳信息,扩展了GNN的感受野。其主要利用了Multi-hop Attention Diffusion操作,通过对多阶次的注意力进行加权,实现信息的更广泛传播。

在分析图神经网络时,了解图论基础知识是至关重要的。邻接矩阵和度矩阵是图结构数据的基本表示方式。

在大规模图数据中,邻接矩阵的存储和计算开销是一个重要的问题。为了提高计算效率,需要对邻接矩阵进行优化。

邻接矩阵在许多实际应用中扮演着重要角色,尤其是在社交网络、物流网络等领域。

邻接矩阵在多阶传播中的应用为图神经网络提供了强大的工具,能够有效捕获图中节点间的复杂关系。通过对邻接矩阵的优化和模型的改进,GNN在大规模图数据中的应用前景广阔。

问:什么是邻接矩阵?

问:多阶传播如何提高GNN的性能?

问:如何优化邻接矩阵的存储?

问:DCNN与传统GNN有何不同?

问:邻接矩阵在社交网络分析中的作用是什么?