文心一言写代码:代码生成力的探索

360gpt2-pro是由360公司开发的一款强大的大语言模型,具有独特的本地知识库功能。这一模型集成了先进的自然语言处理技术,能够在多种应用场景中提供智能化解决方案。360gpt2-pro在技术上结合了最新的深度学习算法,支持高效的数据处理和信息检索功能,使其在文本生成、语言翻译、情感分析等方面表现出色。

360gpt2-pro的技术架构基于Transformer框架,采用多层自注意力机制来提升模型的语义理解能力。这种架构能够在处理长文本时保持高效的性能,同时在复杂的任务中提供准确的结果。此外,360gpt2-pro还支持多语言处理,通过对不同语言语料库的训练,实现跨语言的自然语言处理。

为了展示360gpt2-pro的应用,我们来看一个简单的Python代码示例:

from transformers import GPT2LMHeadModel, GPT2Tokenizer

model_name = "360gpt2-pro"

model = GPT2LMHeadModel.from_pretrained(model_name)

tokenizer = GPT2Tokenizer.from_pretrained(model_name)

input_text = "人工智能正在改变世界"

inputs = tokenizer(input_text, return_tensors="pt")

outputs = model.generate(inputs['input_ids'], max_length=50)

print(tokenizer.decode(outputs[0], skip_special_tokens=True))

本地知识库是360gpt2-pro的重要功能之一,它能够通过本地化的数据存储和管理,提供快速、精准的信息检索服务。这一功能在企业级应用中尤为重要,可以用于客户服务、智能问答系统等多个领域。

360gpt2-pro的本地知识库管理系统支持多种数据格式的导入和管理,用户可以通过简单的接口实现对知识库的更新和维护。此外,系统还支持自动化的数据清洗和分类,使得知识库始终保持最新状态。

在客户服务领域,360gpt2-pro可以通过本地知识库快速响应用户的查询。它能够根据用户输入的关键词,从知识库中检索相关信息,并生成自然流畅的回答。这种能力极大地提升了客户服务的效率和用户满意度。

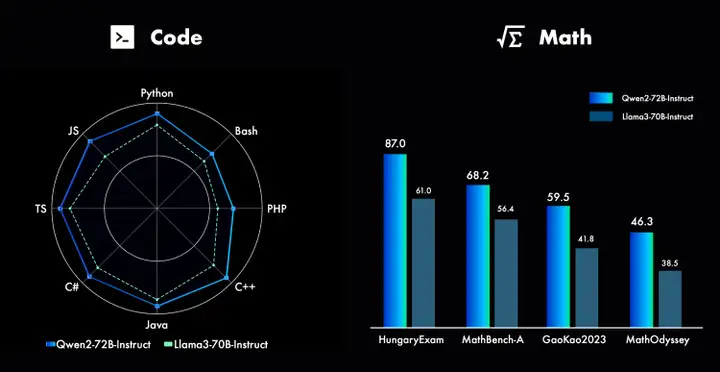

在性能评估方面,360gpt2-pro通过多种国际测评标准验证了其卓越的能力。其中,MMLU、HELM等评测框架为360gpt2-pro提供了全面的性能评估支持,这些评测标准涵盖了语言理解、文本生成、信息检索等多个方面。

MMLU是全球范围内使用最广泛的多任务语言理解评测之一。360gpt2-pro在这一评测中表现优异,证明了其在处理复杂语言任务中的强大能力。其在基础数学、计算机科学、法律等多领域的任务测试中均取得了优异成绩。

HELM评测框架由斯坦福大学提出,旨在通过标准化评估方法对不同模型进行透明的性能评估。360gpt2-pro在HELM评测中的表现同样出色,充分展示了在多种任务环境中的适应能力。

展望未来,360gpt2-pro将持续优化其模型性能,包括进一步提升语义理解能力和信息检索速度。此外,360公司计划扩展本地知识库的功能,使其能够更好地支持大规模数据的管理和应用。

未来的开发计划中,360gpt2-pro将支持更广泛的行业应用场景,包括医疗、金融、教育等领域。通过不断的技术创新,360gpt2-pro将为用户提供更加智能化的解决方案。

360gpt2-pro的持续发展离不开开源社区的支持。360公司将继续加强与开源社区的合作,促进技术交流和创新,以推动整个AI生态系统的发展。

360gpt2-pro作为一款先进的大语言模型,通过其强大的本地知识库功能和卓越的性能表现,在现代AI应用中展现出了巨大的潜力。随着技术的不断进步,360gpt2-pro将在更多的应用场景中发挥重要作用,为用户提供更加智能、高效的解决方案。

答:360gpt2-pro通过本地知识库快速检索和生成自然流畅的回答,大大提高了客户服务的响应速度和准确性,提升了用户满意度。

答:用户可以通过360公司的官网获取部署指南,按照提供的步骤进行模型的本地化部署,确保数据的安全性和模型的高效运行。

答:360gpt2-pro提供多种编程语言的API接口,包括Python、Java、C++等,方便开发者在不同平台上进行集成和开发。

答:是的,用户可以通过简单的接口对360gpt2-pro的本地知识库进行扩展和更新,以满足不同应用场景的需求。

答:360gpt2-pro在数据传输和存储过程中采用多重加密技术,确保用户数据的安全性和隐私保护。