制定蓝图:什么样的API策略能够确保未来的成功?

检索增强生成(RAG)是指对大型语言模型输出进行优化,使其能够在生成响应之前引用训练数据来源之外的权威知识库。大型语言模型(LLM)用海量数据进行训练,使用数十亿个参数为回答问题、翻译语言和完成句子等任务生成原始输出。在 LLM 本就强大的功能基础上,RAG 将其扩展为能访问特定领域或组织的内部知识库,所有这些都无需重新训练模型。这是一种经济高效地改进 LLM 输出的方法,让它在各种情境下都能保持相关性、准确性和实用性。

LLM 是一项关键的人工智能(AI)技术,为智能聊天机器人和其他自然语言处理(NLP)应用程序提供支持。目标是通过交叉引用权威知识来源,创建能够在各种环境中回答用户问题的机器人。不幸的是,LLM 技术的本质在 LLM 响应中引入了不可预测性。此外,LLM 训练数据是静态的,并引入了其所掌握知识的截止日期。

LLM 面临的已知挑战包括:

● 在没有答案的情况下提供虚假信息。

● 当用户需要特定的当前响应时,提供过时或通用的信息。

● 从非权威来源创建响应。

● 由于术语混淆,不同的培训来源使用相同的术语来谈论不同的事情,因此会产生不准确的响应。

您可以将大型语言模型看作是一个过于热情的新员工,他拒绝随时了解时事,但总是会绝对自信地回答每一个问题。不幸的是,这种态度会对用户的信任产生负面影响,这是您不希望聊天机器人效仿的!

RAG 是解决其中一些挑战的一种方法。它会重定向 LLM,从权威的、预先确定的知识来源中检索相关信息。组织可以更好地控制生成的文本输出,并且用户可以深入了解 LLM 如何生成响应。

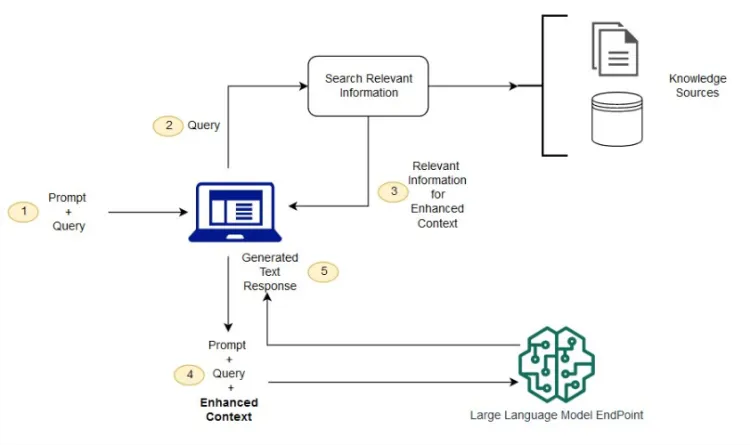

如果没有 RAG,LLM 会接受用户输入,并根据它所接受训练的信息或它已经知道的信息创建响应。RAG 引入了一个信息检索组件,该组件利用用户输入首先从新数据源提取信息。用户查询和相关信息都提供给 LLM。LLM 使用新知识及其训练数据来创建更好的响应。以下各部分概述了该过程。

创建外部数据

LLM 原始训练数据集之外的新数据称为外部数据。它可以来自多个数据来源,例如 API、数据库或文档存储库。数据可能以各种格式存在,例如文件、数据库记录或长篇文本。另一种称为嵌入语言模型的 AI 技术将数据转换为数字表示形式并将其存储在向量数据库中。这个过程会创建一个生成式人工智能模型可以理解的知识库。

检索相关信息

下一步是执行相关性搜索。用户查询将转换为向量表示形式,并与向量数据库匹配。例如,考虑一个可以回答组织的人力资源问题的智能聊天机器人。如果员工搜索:“我有多少年假?”,系统将检索年假政策文件以及员工个人过去的休假记录。这些特定文件将被退回,因为它们与员工输入的内容高度相关。相关性是使用数学向量计算和表示法计算和建立的。

增强 LLM 提示

接下来,RAG 模型通过在上下文中添加检索到的相关数据来增强用户输入(或提示)。此步骤使用提示工程技术与 LLM 进行有效沟通。增强提示允许大型语言模型为用户查询生成准确的答案。

更新外部数据

下一个问题可能是——如果外部数据过时了怎么办? 要维护当前信息以供检索,请异步更新文档并更新文档的嵌入表示形式。您可以通过自动化实时流程或定期批处理来执行此操作。这是数据分析中常见的挑战——可以使用不同的数据科学方法进行变更管理。

下图显示了将 RAG 与 LLM 配合使用的概念流程。

语义搜索可以提高 RAG 结果,适用于想要在其 LLM 应用程序中添加大量外部知识源的组织。现代企业在各种系统中存储大量信息,例如手册、常见问题、研究报告、客户服务指南和人力资源文档存储库等。上下文检索在规模上具有挑战性,因此会降低生成输出质量。

语义搜索技术可以扫描包含不同信息的大型数据库,并更准确地检索数据。例如,他们可以回答诸如 “去年在机械维修上花了多少钱?”之类的问题,方法是将问题映射到相关文档并返回特定文本而不是搜索结果。然后,开发人员可以使用该答案为 LLM 提供更多上下文。

RAG 中的传统或关键字搜索解决方案对知识密集型任务产生的结果有限。开发人员在手动准备数据时还必须处理单词嵌入、文档分块和其他复杂问题。相比之下,语义搜索技术可以完成知识库准备的所有工作,因此开发人员不必这样做。它们还生成语义相关的段落和按相关性排序的标记词,以最大限度地提高 RAG 有效载荷的质量。

| 特征/方面 | RAG API | 大型语言模型 (LLM) |

| 定义 | 结合检索机制和生成语言模型的API | 在大量数据集上预训练的语言模型 |

| 主要目的 | 增强数据检索和内容生成,关注上下文感知响应 | 生成类似人类的文本,用于多种NLP任务 |

| 应用范围 | 特定任务,如问答、内容生成、文本摘要 | 广泛的NLP任务,如翻译、情感分析等 |

| 上下文感知 | 强 | 较弱,但可通过微调增强 |

| 定制和控制 | 允许精细控制,易于定制 | 提供一定程度的定制能力 |

| 用例明确性 | 适合明确的上下文感知内容需求 | 适合多才多艺的广泛需求 |

| 预先训练能力 | 专注于检索和生成,可能不涉及其他任务 | 强大的语言理解,适合处理大量文本数据 |

| 更新和适应性 | 可能需要针对特定任务进行再训练 | 定期再训练以适应新数据和趋势 |

| 主动学习 | 可以实施,以提高性能和准确性 | 可以通过主动学习技术进行改进 |

| 数据增强 | 重要,以保持准确性和相关性 | 通过增强数据存储来防止性能下降 |

将 RAG API 视为RAG 即服务。 它将 RAG 系统的所有基础知识整合到一个软件包中,使您可以方便地在您的组织中使用 RAG 系统。 RAG API 允许您专注于 RAG 系统的主要元素,并让 API 处理其余部分。

当我们深入研究检索增强生成 (RAG) 的复杂性时,我们发现 RAG 查询可以分解为三个关键元素:上下文、角色和用户查询。这些组件是支持 RAG 系统的构建块,每个组件都在内容生成过程中发挥着至关重要的作用。

上下文构成了RAG API 查询的基础,是存放重要信息的知识库。利用现有知识库数据的语义搜索可以获得与用户查询相关的动态上下文。

角色定义了 RAG 系统的目的,指导其执行特定任务。它指导模型生成符合需求的内容、提供解释、回答查询或总结信息。

用户查询是用户的输入,标志着 RAG 流程的开始。它代表用户与系统的交互并传达他们的信息需求。

语义搜索使 RAG API 中的数据检索过程变得高效。这种方法允许进行多维数据分析,从而提高我们对基于上下文的数据关系的理解。简而言之,通过语义搜索掌握 RAG 查询和数据检索的结构使我们能够释放这项技术的潜力,促进高效的知识访问和上下文感知内容生成。

RAG API,即检索增强生成API,是数据检索和内容生成的强大工具,具有以下优势:

RAG API的这些特性使其成为重新定义数据交互和探索数据处理新时代的理想选择。您准备好利用这一技术来转变您的数据处理方式了吗?

在幂简API平台可以通过以下两种方式找到所需API:通过关键词搜索RAG、或者从API Hub分类页进入寻找。

幂简集成是国内领先的API集成管理平台,专注于为开发者提供全面、高效、易用的API集成解决方案。幂简开发者社区会编写API入门指南、多语言API对接指南、API测评等维度的文章,让开发者快速使用目标API。

原文链接:RAG API:含义、元素和提示词