模型 API 才是打开 AI 的最佳方式

黄仁勋:“在 19 世纪 90 年代末期,尼古拉·特斯拉发明了交流发电机,而 NVIDIA 现在发明了AI发电机。交流发电机生成电子;AI 发电机生成的是 Token,这两样东西都有巨大的市场机会,Token 几乎可以应用于每个行业,这就是为什么这是一场新的工业革命”。

大模型 API 是什么

API 就是传输 token 的接口,无论是大模型厂商、云计算平台,还是开源、闭源模型,他们可能不会直接提供 ChatBot 对话助手,但都会提供其模型 API。

像 Huggingface、魔搭这样的开源模型托管平台,提供了数万个大模型,有大模型厂商开源的,也有组织、个人微调过的,而且大多都支持免费调用推理 API,无需部署算力、服务器。

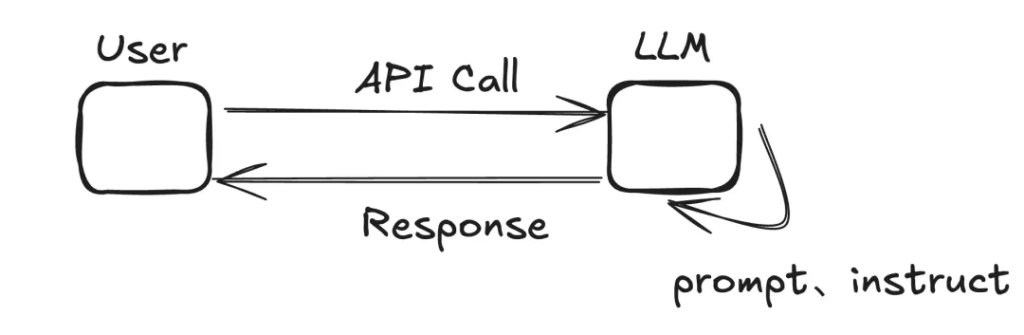

API 一端连接着 AI 大模型服务,另一端则开放给用户。用户想要接入并使用这些模型的功能,只需将 API 集成到各种应用程序中,输入的内容传输到后端的大模型服务,经处理后,结果再返回给应用,完成一次 API 调用。

相比于对话框式的 AI 助手,API 推理更加灵活,它可以集成在自己开发的应用中,如果你没有深厚的编程能力,也能利用各种开源应用和插件,大大降低使用 AI 的摩擦力。

已经无需赘述 AI 的能力和好处了,它完全可以充当个人助理,我在谁在用 AI 以及如何用?中论述,当前 AI 产品使用现状,很多人用不起来,不是因为不会写 Prompt,也不是因为找不到适合自己 Agent,最重要的是如何和业务结合,让 AI 在你的数字空间无处不在。

通过大模型 API 集成各种应用,就可以做到让你的数字世界有一个随处跟随的 AI 精灵。

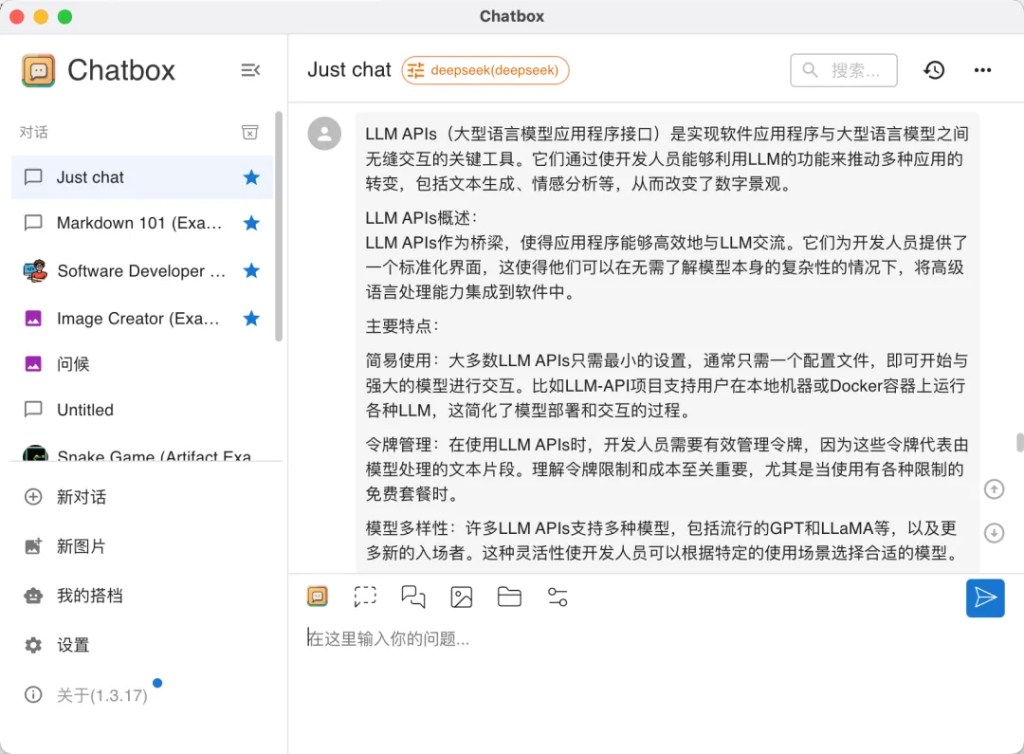

比如使用 chatbox 这个 mac 客户端,我集成了 deepseek 的大模型,flux 的图像生成,基本上做到了 GPT4 的平替,并且 API 成本足够低,平台赠送的 token 我还没有花完。

再比如使用 chatgptbox 这个浏览器插件,做到了 Monica 的平替,在飞书里可以续写,在 flomo 里可以碰撞自己的想法,还能翻译,在任意网页随时和 AI 对话。

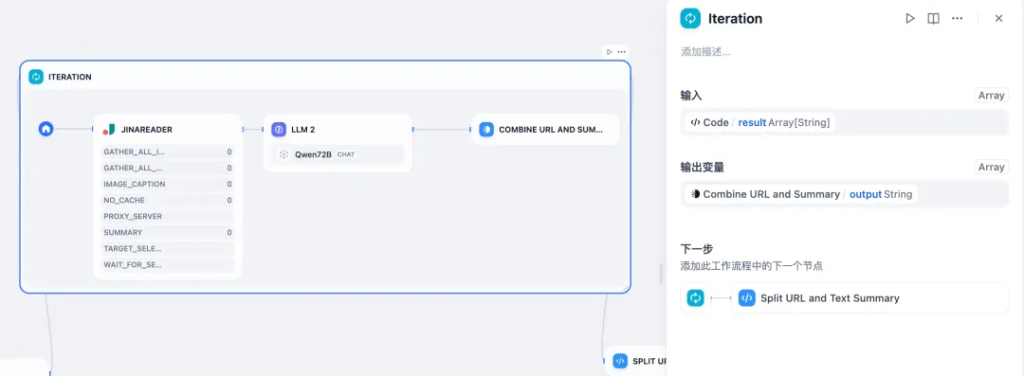

高级一点是使用 dify 和快捷指令,可以自动化工作流,比如可以搭建一个 RSS 阅读器,每天为自己总结我所关注的博主的文章,提取出创作灵感。

总结来说,使用 API 推理还有以下好处:

- 不局限于大模型官方推出的 chatbot,将 API 接入各种开源应用,它可以是浏览器插件、手机 APP、小程序等等,大大降低使用 AI 的门槛。

- 不局限于只用一个模型,通过像 ChatBox 这样的应用,可以在一个窗口接入多个大模型,同时回答你的问题。

- 不因付费而困扰,API 计费方式一般是用多少扣多少,而且现在价格免费,很多平台可白嫖。

- 定制化能力更强,调用接口集成在自己应用中,也可以调整大模型的参数,适应你的应用功能。

咱们用好 AI ,不说去创作副业,就只是节省你的工作时间,提前下班,享受摸鱼的快乐,大模型 API 的使用是比要学会 prompt、Agent 更重要的一步。

我会在本篇文章分享有哪些 API 可在国内免费使用,在文末分享数十种,你或许用得上的应用。

这篇文章依旧顺应“用好 AI”的宗旨,不炒概念,不谈未来,就只是谈谈如何把 AI 用好。

国内 LLM API 提供商

关于费用:Kimi、智谱、Deepseek 模型能力够强,而且要么送 20 块钱,要么送百万 token,对于个人,够用一个月。还有像 siliconflow 这样的开源模型 API 平台,很多免费可用。

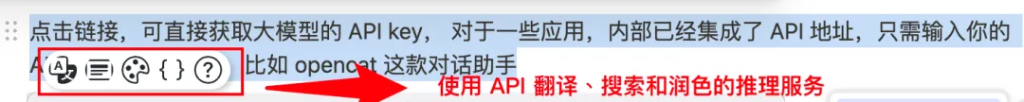

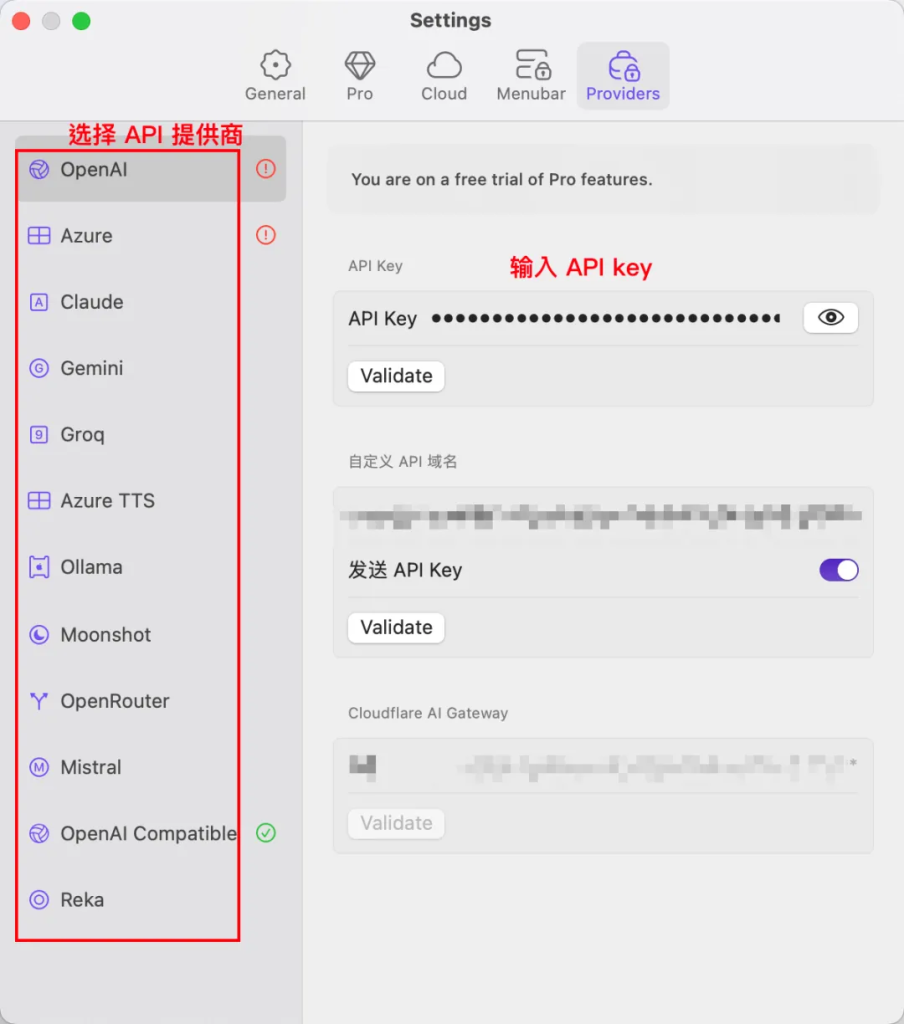

如何用:点击上表链接,可直接获取大模型的 API key, 有的应用,内部已经集成了 API 地址,只需输入你的 API key 就可以请求,比如下图这款 Opencat 这款对话助手,可以看到很多主流的模型提供商,选择后,再输入该平台提供的 API key 就能请求了:

那么对于大部分没有集成 API 提供商的应用,来看看如何使用 API :

- 掌握三个概念

- 拿到三样信息

- 按步骤接入应用

三个概念

1.模型

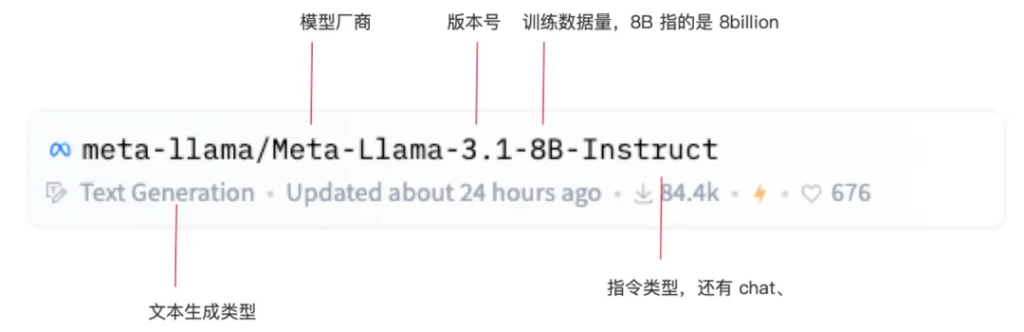

模型 LLM 是由数据集训练而成的,模型有数据集、版本和类型的区别

- 模型领域:文本生成、视频生成、语音生成、图像生成、代码生成等

- 训练数据量:比如8B 、70B、30M等,训练量大模型效果好

- 类型:对话、补全、指令等

- 版本:如 GPT 有 GPT4、GPT4o 等,不同版本能力不同

因此在选择 API 时候,要选对模型类型,以及适合自己使用场景的

2.Token

文本生成模型处理文本时,是以 Token 作为基本单位的。Token 通常指的是文本中常见的字符或字符序列。

比如,一个复杂的汉字“龘”可能会被拆分成几个 Token,而像“你好”这样常用且简短的词语则可能直接作为一个 Token 来处理。一般来说,对于普通的中文文本,一个 Token 大约对应 1.5 到 2 个汉字。

API 的收费标准就是按照 Token 的输入和输出量来算的。现

3.API 参数

不同类别、不同模型的参数都不一样,参数可以调节控制模型的输出结果,最常见的参数有

- Temputerture(温度):调整生成内容的创新性和意外性。

- Top_P(累积概率阈值):定义生成内容的多样性。

- Top_K(最高排名选择):限制选择词汇的范围。

- max_tokens(最大令牌数):设置生成内容的最大长度。

获取三个信息

登录模型平台后,拿到以下三样信息:

1. 模型 API 的 url

以 kimi 大模型为例,登录 kimi 的开放平台。

在接口文档中就能看到对话类型的 API 地址:https://api.moonshot.cn/v1/chat/completions。

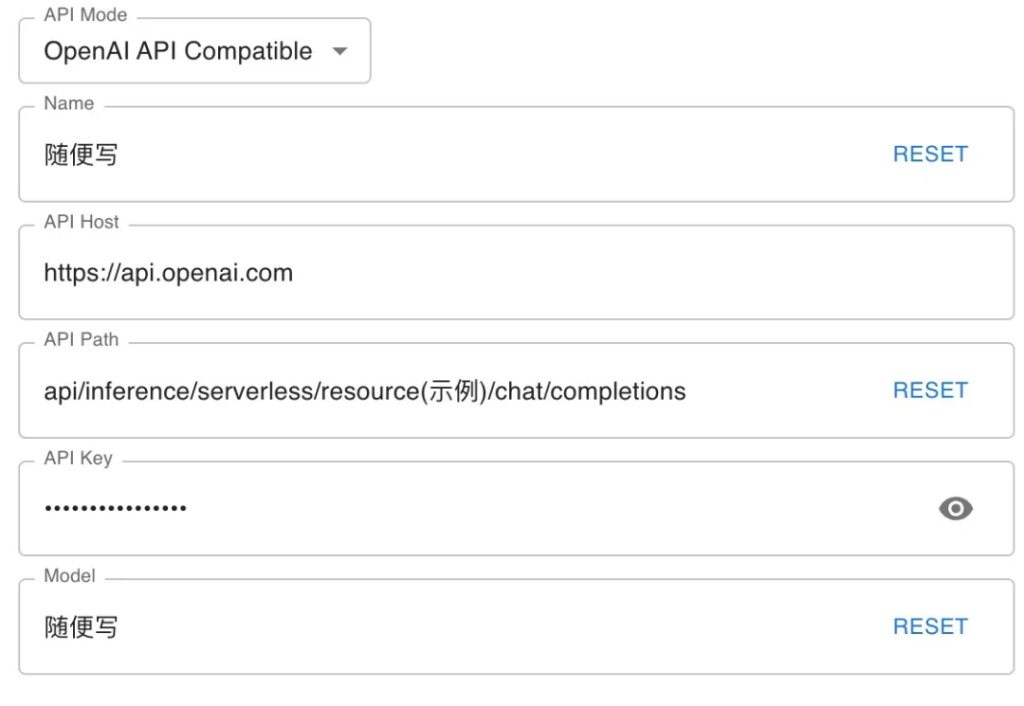

如果应用中未提供模型的接口填写地址,选择 OpenAI Compatible,大部分接口是和 OpenAi 的相兼容的。如下图@

2. 模型 API key

API key 是请求服务时,验证自己身份的密钥,对于各大模型平台,登录成功后,在账号的控制台下就能看到

3.一个可接入 API 的应用

下面提供了近 20 款应用,它们运行在我们常用平台上,有客户端也有小插件。

最后我们以沉浸式翻译这款必备的插件,讲解下,怎么把 智谱模型 接入,能达到沉浸式翻译的会员提供的 GPT4 翻译效果。

配置指南

- 浏览器安装 沉浸式翻译

- 进入设置——翻译服务——添加兼容 OpenAI 接口的 AI 翻译服务

- 来到智谱获取 API 请求地址:https://open.bigmodel.cn/api/paas/v4/chat/completions:

- 输入 API URL

- 输入API Key

最后,点击测试服务,测试成功即可。

前期安装和搭建花几个小时,后面带来的便利和收益肯让你无法戒断。

文章转自微信公众号@空格的键盘