如何获取Moonshot AI API Key 密钥(分步指南)

Moonshot的文本生成模型(指moonshot-v1)是训练用于理解自然语言和书面语言的,它可以根据输入生成文本输出。对模型的输入也被称为“prompt”。通常我们建议您提供明确的指令以及给出一些范例,来让模型能够完成既定的任务,设计 prompt 本质上就是学会如何“训练”模型。moonshot-v1模型可以用于各种任务,包括内容或代码生成、摘要、对话、创意写作等。

本文旨在为你提供一份详尽的分步指南,教你如何轻松获取Moonshot AI API的密钥。通过一系列简单明了的步骤,你将顺利完成注册并成功获取密钥。一旦你拥有了这个密钥,你就可以将其集成到你的应用中,充分利用Moonshot AI的强大功能来优化和提升你的产品体验。

1. 注册并登录 Moonshot 开放平台

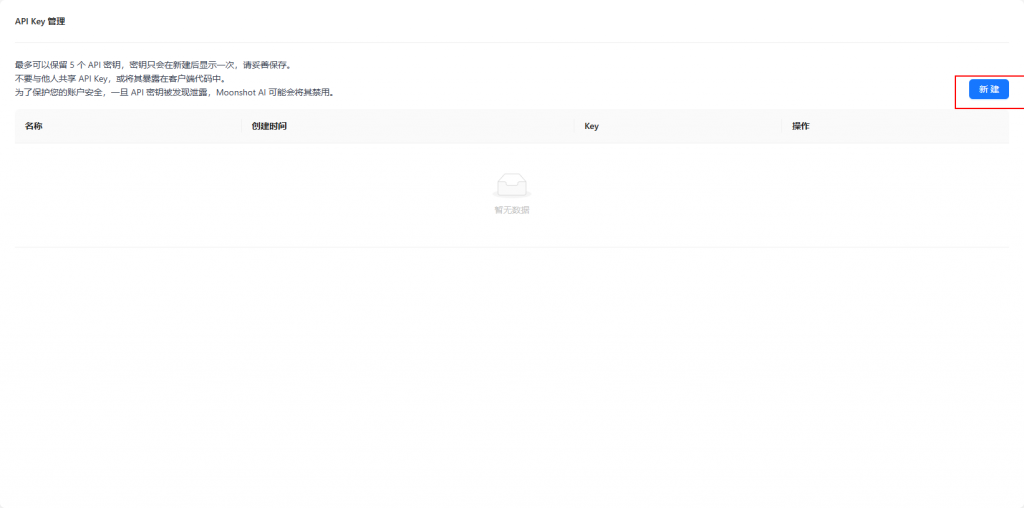

2. 创建密钥

在 账户信息中找到API Key 管理菜单,并创建新的密钥

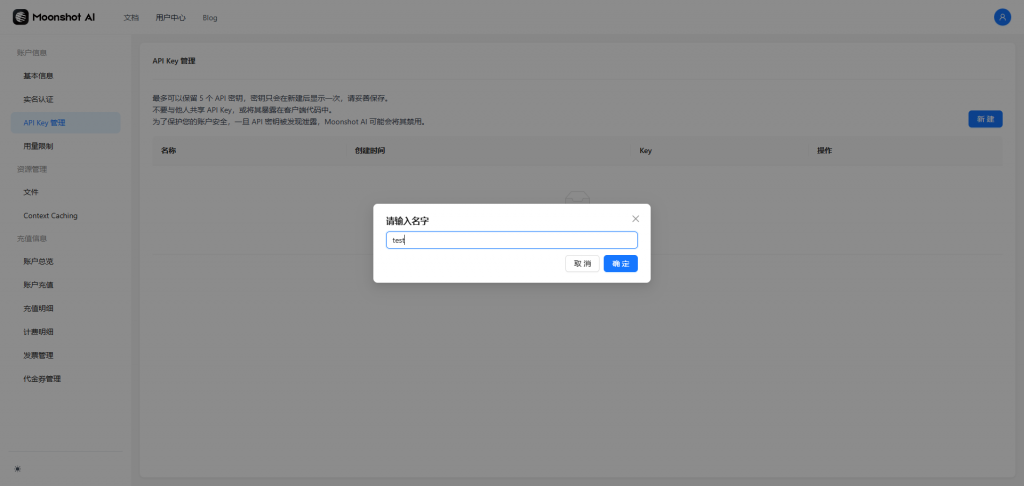

填写一个 API 密钥的名称并创建

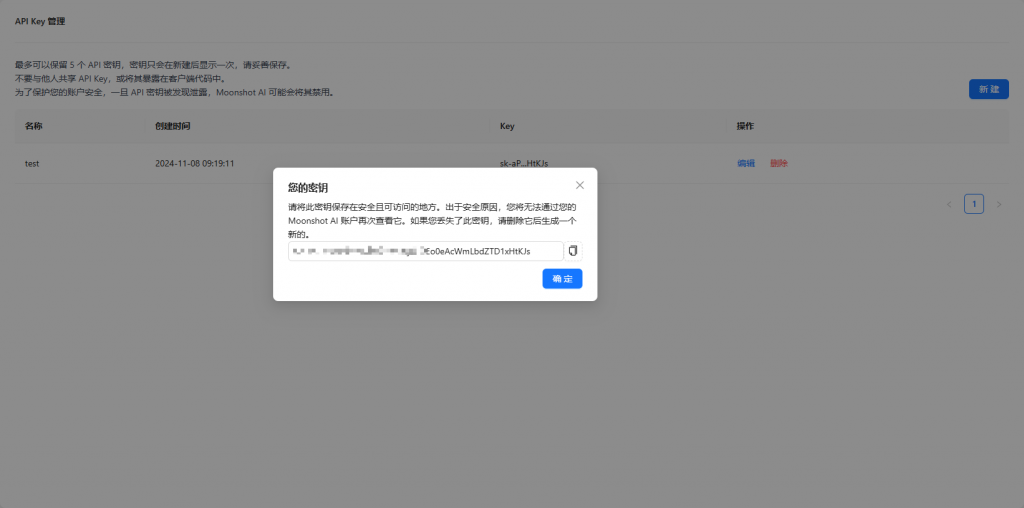

在弹出的对话框中复制 API 密钥,并妥善保存

3. 快速接入

复制完整代码并执行

Kimi API 提供了与 Kimi 大模型交互的能力,以下是一个简单示例代码:

from openai import OpenAI

client = OpenAI(

api_key="MOONSHOT_API_KEY", # 在这里将 MOONSHOT_API_KEY 替换为你从 Kimi 开放平台申请的 API Key

base_url="https://api.moonshot.cn/v1",

)

completion = client.chat.completions.create(

model = "moonshot-v1-8k",

messages = [

{"role": "system", "content": "你是 Kimi,由 Moonshot AI 提供的人工智能助手,你更擅长中文和英文的对话。你会为用户提供安全,有帮助,准确的回答。同时,你会拒绝一切涉及恐怖主义,种族歧视,黄色暴力等问题的回答。Moonshot AI 为专有名词,不可翻译成其他语言。"},

{"role": "user", "content": "你好,我叫李雷,1+1等于多少?"}

],

temperature = 0.3,

)

# 通过 API 我们获得了 Kimi 大模型给予我们的回复消息(role=assistant)

print(completion.choices[0].message.content)为了成功运行上述代码,你可能需要准备:

- Python 环境 或 Node.js 环境,我们推荐使用 Python 3.8 及以上版本的 Python 解释器;

- OpenAI SDK,我们的 API 完全兼容 OpenAI 的 API 格式,因此你可以直接使用 Python 或 Node.js OpenAI SDK 进行调用,你可以通过如下方式来安装 OpenAI SDK:

pip install --upgrade 'openai>=1.0' #Pythonnpm install openai@latest #Node.js - 将你从 Kimi 开放平台申请的 API Key,将其传入

OpenAi Client以便于我们能正确识别你的身份;

如果您成功运行上述代码,且没有任何报错,那么您将看到类似如下的内容输出:

你好,李雷!1+1 等于 2。这是一个基本的数学加法问题。如果你有其他问题或需要帮助,请随时告诉我。字段说明

| 字段 | 是否必须 | 说明 | 类型 | 取值 |

|---|---|---|---|---|

| messages | required | 包含迄今为止对话的消息列表 | List[Dict] | 这是一个结构体的列表,每个元素类似如下:{"role": "user", "content": "你好"} role 只支持 system,user,assistant 其一,content 不得为空 |

| model | required | Model ID, 可以通过 List Models 获取 | string | 目前是 moonshot-v1-8k,moonshot-v1-32k,moonshot-v1-128k 其一 |

| max_tokens | optional | 聊天完成时生成的最大 token 数。如果到生成了最大 token 数个结果仍然没有结束,finish reason 会是 “length”, 否则会是 “stop” | int | 这个值建议按需给个合理的值,如果不给的话,我们会给一个不错的整数比如 1024。特别要注意的是,这个 max_tokens 是指您期待我们返回的 token 长度,而不是输入 + 输出的总长度。比如对一个 moonshot-v1-8k 模型,它的最大输入 + 输出总长度是 8192,当输入 messages 总长度为 4096 的时候,您最多只能设置为 4096,否则我们服务会返回不合法的输入参数( invalid_request_error ),并拒绝回答。如果您希望获得“输入的精确 token 数”,可以使用下面的“计算 Token” API 使用我们的计算器获得计数 |

| temperature | optional | 使用什么采样温度,介于 0 和 1 之间。较高的值(如 0.7)将使输出更加随机,而较低的值(如 0.2)将使其更加集中和确定性 | float | 默认为 0,如果设置,值域须为 [0, 1] 我们推荐 0.3,以达到较合适的效果 |

| top_p | optional | 另一种采样方法,即模型考虑概率质量为 top_p 的标记的结果。因此,0.1 意味着只考虑概率质量最高的 10% 的标记。一般情况下,我们建议改变这一点或温度,但不建议 同时改变 | float | 默认 1.0 |

| n | optional | 为每条输入消息生成多少个结果 | int | 默认为 1,不得大于 5。特别的,当 temperature 非常小靠近 0 的时候,我们只能返回 1 个结果,如果这个时候 n 已经设置并且 > 1,我们的服务会返回不合法的输入参数(invalid_request_error) |

| presence_penalty | optional | 存在惩罚,介于-2.0到2.0之间的数字。正值会根据新生成的词汇是否出现在文本中来进行惩罚,增加模型讨论新话题的可能性 | float | 默认为 0 |

| frequency_penalty | optional | 频率惩罚,介于-2.0到2.0之间的数字。正值会根据新生成的词汇在文本中现有的频率来进行惩罚,减少模型一字不差重复同样话语的可能性 | float | 默认为 0 |

| response_format | optional | 设置为 {"type": "json_object"} 可启用 JSON 模式,从而保证模型生成的信息是有效的 JSON。当你将 response_format 设置为 {"type": "json_object"} 时,你需要在 prompt 中明确地引导模型输出 JSON 格式的内容,并告知模型该 JSON 的具体格式,否则将可能导致不符合预期的结果。 | object | 默认为 {“type”: “text”} |

| stop | optional | 停止词,当全匹配这个(组)词后会停止输出,这个(组)词本身不会输出。最多不能超过 5 个字符串,每个字符串不得超过 32 字节 | String, List[String] | 默认 null |

| stream | optional | 是否流式返回 | bool | 默认 false, 可选 true |

4. 常见问题

Q:如何找到Moonshot AI

A:幂简集成是国内领先的API集成管理平台,专注于为开发者提供全面、高效、易用的API集成解决方案。幂简API平台可以通过以下两种方式找到所需API:通过关键词搜索API(例如,输入’Moonshot AI ‘这类品类词,更容易找到结果)、或者从API hub分类页进入寻找。

Q:为什么 API 返回的结果和 Kimi 智能助手返回的结果不一致?

A:API 和 Kimi 智能助手使用的是同一模型,如果你发现模型输出结果不一致,可以尝试修改 System Prompt,Kimi 智能助手的 System Prompt,可以参考这里(opens in a new tab)的例子;另一方面 Kimi 智能助手提供了诸如计算器等工具,而 API 并未默认提供这些工具,需要用户自行组装;

Q:Kimi API 是否拥有 Kimi 智能助手的“上网冲浪”功?

A:现在,Kimi API 提供了联网搜索功能,请查阅我们的指南:使用 Kimi API 的联网搜索功能。如果你想自己通过 Kimi API 实现联网搜索功能,也可以参考我们撰写的工具调用 tool_calls 指南

Q:Kimi API 返回的内容不完整或被截断?

A:如果你发现 Kimi API 返回的内容不完整、被截断或长度不符合预期,你可以先检查响应体中的 choice.finish_reason 字段的值,如果该值为 length,则表明当前模型生成内容所包含的 Tokens 数量超过请求中的 max_tokens 参数,在这种情况下,Kimi API 仅会返回 max_tokens 个 Tokens 内容,多余的内容将会被丢弃,即上文所说“内容不完整”或“内容被截断”。

Q:Kimi 大模型的输出长度是多少?

A:

- 对于

moonshot-v1-8k模型而言,最大输出长度是8*1024 - prompt_tokens; - 对于

moonshot-v1-32k模型而言,最大输出长度是32*1024 - prompt_tokens; - 对于

moonshot-v1-128k模型而言,最大输出长度是128*1024 - prompt_tokens;

Q:文件抽取内容不准确、图像无法被识别?

A:我们提供各种格式的文件上传和文件解析服务,对于文本文件,我们会提取文件中的文字内容;对于图片文件,我们会使用 OCR 识别图片中的文字;对于 PDF 文档,如果 PDF 文档中只包含图片,我们会使用 OCR 提取图片中的文字,否则仅会提取文本内容。;注意,对于图片,我们只会使用 OCR 提取图片中的文字内容,因此如果你的图片中不包含任何文字内容,则会引起解析失败的错误。

Q:Moonshot AI 的替代品有哪些?

提供AI大模型API的服务商除了Moonshot AI ,还有其他替代服务商也提供类似api服务,例如:

360多模态大语言模型、语音大模型服务MiniMax-稀宇科技、通用大模型开放平台-华藏、讯飞星火认知大模型

更多竞品可以在幂简集成开放平台中找到。

Q:通义千问API这个密钥还适用于哪些api?

5. 总结

本文为开发者提供了获取Moonshot AI 密钥的详细分步指南,从注册账号到完成开发者认证,直至获取密钥,每一步都清晰明了。此外,还强调了获取密钥后进行测试的重要性,以确保顺利集成API至应用中。本文为开发者提供了一个全面、实用的指南,帮助他们顺利获取Moonshot AI 密钥,并有效地将这一能力集成到应用中,从而提升应用的交互性和功能性。