了解 API 技术:REST、GraphQL 和异步 API 的比较分析

最近,Forrester发表了一篇颇有愿景的趋势报告。标题为「借助Agentic AI,生成式AI正在从言语演变为行动」,副标题为「Agentic AI和Agentic Workflows塑造消费者和企业的互动」。

对于这份报告,单是看标题和简介,就能感受到Forrester对Agentic AI未来的看好,而其中的重点就在于AI Agent能够让GenAI从生成内容变为执行任务。

不要小看这小小的一步行动,它足以为生产端和消费端带来翻天覆地的变化。

一个简单的例子就是,以前企业用人力作为客服,现在企业正在逐步将人类客服替换为能够自主行动的智能体。以后我们在各个平台消费时的商品咨询、售后等,则都有可能是在跟智能体交流,你甚至感觉不到对方不是人类客服,并且服务会比现在更好。

这个用户体验的简单变化,对于企业的增效降本是显而易见的,当然用智能体替代客服、销售等人类职业的进程也是在快速推进的。

在Forrester看来,Agentic AI不仅能“思考”更能“行动”,还能设定自己的目标,做出复杂的决策,并适应不断变化的环境,表现出更人性化的能动性,为自动化、个性化服务和智能系统等领域的更先进、更通用的基于AI的通用应用铺平了道路。

麦肯锡则认为,GenAI使Agent系统能够计划他们的行动,使用在线工具完成这些任务,与其他Agent和人员协作,并学习提高他们的表现。GenAI智能体最终可以充当熟练的虚拟同事,以无缝和自然的方式与人类合作。

这就像大语言模型(Large Language Models,LLM )可以对它们尚未明确训练的提示做出可理解的反应一样,基于Gen AI尤其是LLM的智能体可以适应更多不同的场景。

通过使用自然语言而不是编程代码,人类用户可以指导一个由AI支持的Agent系统完成复杂的工作流程。然后多智能体系统可以将此工作流解释和组织为可操作的任务,将工作分配给专门的智能体,使用数字工具生态系统执行这些精细的任务,并与其他智能体和人类协作以迭代方式提高其操作质量。

这样,Agentic workflow成了这些任务的基础单元,最终构成Agentic AI的万千生态。

过去一年,海外科技巨头Google、Microsoft、OpenAI 和其他公司都在致力于Agentic AI的布局,投资或构建软件库和框架以支持Agent功能和LLM 驱动的应用程序。

比如Microsoft Copilot、Amazon Q 和Google 即将推出的Project Astra,正在从基于知识转变为更加基于行动。Adept、crewAI 和Imbue等公司和研究实验室,也在开发基于智能体的模型和多智能体系统。

国内也是一样。目前字节跳动、百度、阿里巴巴、腾讯等都推出了自己的智能体及构建平台,阿里最近还投资了推出秘塔搜索的秘塔科技,大量科技企业都在研发他们的智能体产品,基于AI Agent的项目也越来越多。

Agentic workflow已被公认为AI Agent的下一步趋势,很多人都认同吴恩达等专家教授的观点:智能体工作流是释放大型语言模型真正潜力的关键,也是实现通过上下文学习的目标的核心。

现在很多相关的项目及产品都开始支持整合与兼容Agent工作流,出现了更多的Agentic workflow开源项目。

在GitHub上,Dify已累积了42w+的星标,Flowise的星标接近19w,FastGPT的星标也超过了16w。而AutoGen、LangGraph、DB-GPT等开源项目,也已成为企业和开发者构建智能体工作流的神兵利器。

除了以上几个耳熟能详的项目,从Agentic workflow提出到现在不到半年的时间里,还有哪些相关的开源项目值得关注、学习和应用?本文,王吉伟频道为整理了20个构建Agentic workflow的开源项目,帮助大家更好地理解与应用智能体工作流。

开源LLM 应用程序开发平台,结合AI 工作流、RAG 管道、Agent功能、模型管理、可观察性功能等,快速从原型进入生产。

项目地址:https://github.com/langgenius/dify?tab=readme-ov-file

中文官网:https://dify.ai/cn

体验地址:https://cloud.dify.ai/apps

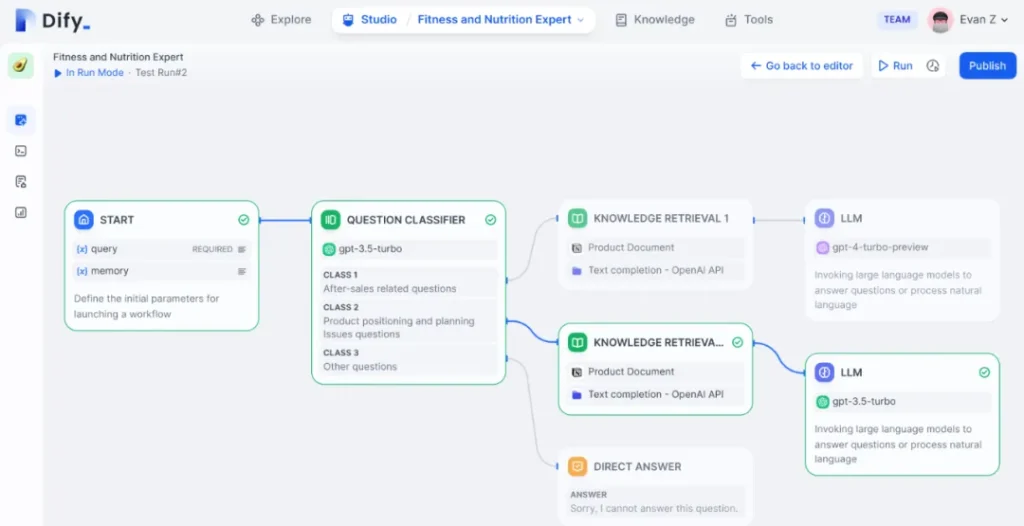

Dify是一个开源的大型语言模型(LLM)应用开发平台。它直观的界面融合了人工智能工作流、RAG(Retrieval-Augmented Generation)流程、智能体能力、模型管理、可观测性特性等,让您能够快速从原型阶段过渡到生产阶段。以下是核心特性:

通过这些特性,Dify平台为开发人员提供了一个强大而灵活的工具集,以构建、测试和部署基于LLM的应用程序,加速开发流程,并提高最终产品的质量和性能。

Dify也是著名的AI Agent构建平台之一,大家可以通过上面的体验地址,在线构建AI Agent及Agentic workflow。

基于 LLM 构建的基于知识的平台,提供一套全面的开箱即用功能,例如数据处理、RAG 检索和视觉 AI 工作流编排项目地址:https://github.com/labring/FastGPT

官网:https://fastgpt.in/

FastGPT项目是一个基于大型语言模型(LLM)构建的开源知识库问答平台。它提供了一系列即用型功能,如数据处理、模型调用、RAG检索以及可视化AI工作流编排,使得用户可以轻松开发和部署复杂的问答系统,而无需进行广泛的设置或配置。

FastGPT的主要能力包括:

FastGPT从V4版本开始采用新的交互方式构建AI应用,使用Flow节点编排工作流,提高可玩性和扩展性。FastGPT支持多种模型,包括但不限于OpenAI的GPT系列、Claude、文心一言等,并且项目开源,允许社区贡献和二次开发。它适用于构建特定领域的AI客服、自动化数据预处理、工作流编排等场景,提供了简易模式和高级编排能力,以适应不同用户的需求。

开发者可以通过Sealos进行一键部署,或者使用Docker Compose进行快速部署。FastGPT还提供了详细的开发与部署指南,包括系统配置文件说明、多模型配置、版本更新/升级操作等。

AI的编程框架项目地址:https://github.com/microsoft/autogen案例库:https://microsoft.github.io/autogen/docs/Gallery

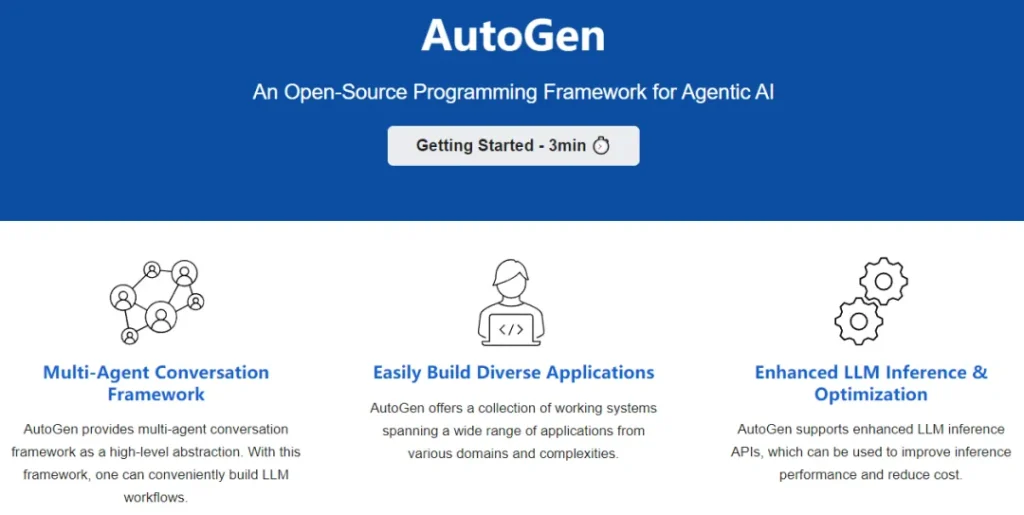

AutoGen是由微软、宾夕法尼亚州立大学和华盛顿大学的合作研究团队共同开发的开源编程框架,旨在简化人工智能智能体的构建和开发,以及促进多个智能体之间的协作,共同解决问题。AutoGen的目标是降低AgentAI开发和研究的门槛,其作用类似于PyTorch在深度学习领域的贡献。该框架提供了一系列功能,包括:

AutoGen框架能够以极低的工作量快速构建基于多智能体对话的新一代LLM应用程序。它简化了复杂的LLM工作流的编排、自动化和优化过程,充分发挥了LLM模型的潜力,同时克服了它们的局限性。

该框架支持多种对话模式,适用于复杂的工作流程。开发人员可以利用AutoGen提供的可定制和可对话的智能体,构建出不同规模和结构的对话系统,无论是简单的一对一对话还是复杂的多智能体交流网络。

AutoGen还提供了一系列不同复杂度的工作系统示例,覆盖了多个领域和不同程度的应用场景,展示了其在支持多样化对话模式方面的灵活性和强大能力。

此外,AutoGen还增强了LLM的推理能力,提供了包括API统一管理、缓存机制等实用工具,以及高级功能,如错误处理、多配置推理、上下文编程等,以满足更高级的使用需求。这些特性使得AutoGen成为一个功能全面、高效的AI智能体开发框架。

以下是两个使用AutoGen的案例

1、autogen_focus_group:虚拟焦点小组,包含自定义角色、产品详细信息和使用 AutoGen、Ollama/Llama3 和 Streamlit 创建的最终分析。

2、Research agent 3.0:基于Autogen + GPT 建立了AI Agent团队,能够生成高质量的研究并验证彼此的工作。

拖放UI以构建您的自定义LLM流程项目地址:https://github.com/FlowiseAI/Flowise

官网:https://flowiseai.com/

文档:https://docs.flowiseai.com/

Flowise是一个开源的低代码工具,专为开发者设计,以便快速构建定制化的LLM(大型语言模型)工作流和AI智能体。它基于LangChain.js提供,通过拖放式的用户界面,使用户无需编写代码即可轻松创建强大的AI应用程序,如聊天机器人、智能客服和知识问答等。

Flowise的主要特点包括:

安装部署方面,Flowise支持NPM部署和Docker部署。通过简单的命令行操作即可启动Flowise,并通过浏览器访问其用户界面进行进一步的操作。

此外,Flowise还提供了应用市场,其中包含预配置的应用程序,帮助用户快速构建原型,缩短开发时间。Flowise的文档和社区支持也为用户提供了丰富的学习资源和交流平台。

Flowise作为一个无代码的LLM应用程序构建平台,极大地降低了开发AI应用的门槛,提高了开发效率,使得构建个性化的AI解决方案变得更加容易和快捷。

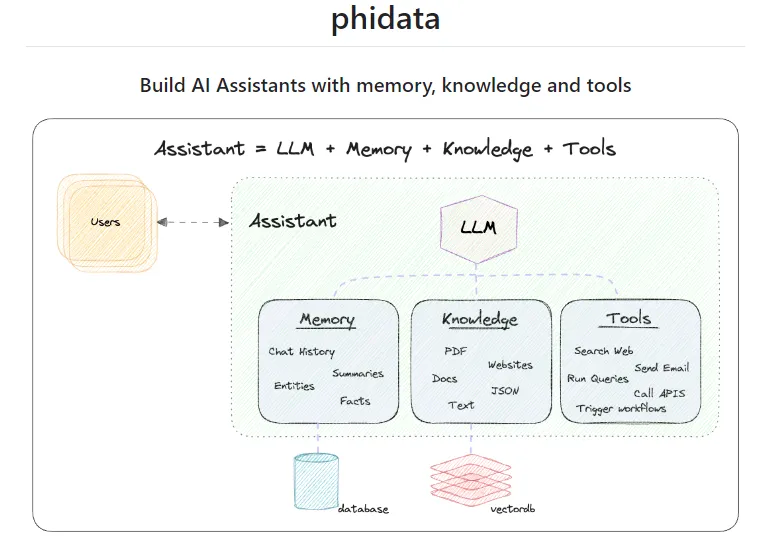

使用内存、知识和工具构建AI助手项目地址:https://github.com/phidatahq/phidata

文档:https://docs.phidata.com/introduction

PhiData是一个开源框架,专为构建具有长期记忆、丰富知识和执行操作能力的AI助手(也称为智能体或Agent)而设计。它通过提供记忆、知识和工具的整合,增强了传统大型语言模型(LLMs)的能力,使其能够更加智能和自适应地响应用户需求 。

PhiData的设计理念是,一个Assistant是以LLM为核心,加上长期记忆(Memory)、知识(结构化、非结构化)和工具(Tools,比如搜索、api调用等),这样就组成了一个完整的Assistant。基于这一理念,PhiData可以帮助用户方便构建助手应用,这些助手不仅拥有长期记忆,能够记住与用户的每一次对话,还具备丰富的业务知识和执行各种动作的能力。

PhiData的核心特点包括:

PhiData还提供了一些高级应用,例如与SQL数据库结合使用进行数据分析,以及支持从文本生成结构化数据模型的功能 。

作为一个功能强大且灵活的框架,PhiData适用于需要高度定制AI助手和自动化任务的场景,推动了AI技术的创新和应用 。此外,PhiData框架的安装简单直接,通过Python的包管理器pip即可完成安装 。

用PhiData构建AI助手的过程涉及三个主要步骤:创建一个Assistant对象;整合所需的工具、知识库和存储;通过Streamlit、FastApi或Django等平台部署AI应用 。

PhiData的应用示例包括但不限于利用DuckDuckGo进行网络搜索的助手、查询财务数据的助手、编写和运行Python代码的助手、使用SQL进行数据分析的助手、从文本生成Pydantic模型的助手及具有知识和存储功能的PDF助手等 。

以图形形式构建弹性语言agents

项目地址:https://github.com/langchain-ai/langgraph

LangGraph是一个基于LangChain之上构建的用于构建具有状态的、多参与者应用程序的库,它与大型语言模型(LLMs)一起使用,以创建Agent和多Agent工作流。它提供了一种新的方式,使用状态图(StateGraph)来构建复杂的智能体应用。它允许更精细的控制能力,支持大型语言模型(LLM)的循环调用以及在Agent过程中的精细化控制,这在构建复杂智能体时非常有用。

与其他LLM框架相比,它提供了以下核心优势:周期性、可控性和持久性。LangGraph 允许你定义涉及周期的流程,这对于大多数Agent架构至关重要,这与基于有向无环图(DAG)的解决方案不同。作为一个非常底层的框架,它为你的应用程序流程和状态提供了细粒度的控制,这对于创建可靠的Agent至关重要。此外,LangGraph 包括内置的持久性功能,这使得它能够支持高级的人工干预和记忆特性。

LangGraph的设计思想是通过图结构来协调多个Chain、Agent、Tool等的协作,支持LLM调用的“循环”能力。在LangGraph中,任务细节通过Graph进行精确定义,包括节点与边的定义,然后基于这个图来编译生成应用。在任务运行过程中,会维持一个中央状态对象,该对象会根据节点的跳转不断更新。

LangGraph的诞生主要是为了解决LangChain简单链(Chain)不具备“循环”能力的问题,以及AgentExecutor调度的Agent运行过于“黑盒”的问题。它提供了一种具备更精细控制能力的框架,来支持更复杂场景的LLM应用。

LangGraph支持持久性,允许Agent记住过去的交互并使用这些信息来指导未来的决策,支持高级的人机循环,使Agent能够与人类用户进行更自然、更有效的交互。

LangGraph与LangChain相比,引入了循环计算,允许节点根据图的状态被多次访问,这对需要迭代处理、反馈循环和复杂决策的应用至关重要。它的状态执行模型不断更新和传递状态,使计算更加上下文感知和适应性强。

具有 AWEL(Agentic Workflow Expression Language)和 Agents的AI原生数据应用程序开发框架项目地址:https://github.com/eosphoros-ai/DB-GPT

DB-GPT是一个开源的AI原生数据应用开发框架,它结合了AWEL(Agentic Workflow Expression Language)和智能体(Agents)技术。其核心目标是构建大模型领域的基础设施,通过开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等技术能力,简化围绕数据库构建大模型应用的过程,使得企业或开发者可以用更少的代码搭建自己的专属应用。

DB-GPT的特点包括:

DB-GPT的架构方案包括RAG框架、生成式BI(GBI)、微调框架、数据驱动的Multi-Agents框架、数据工厂和数据源对接等核心能力,旨在提供企业报表分析、业务洞察以及数据的清洗加工等数智化技术保障。

DB-GPT还提供了一些子模块,如DB-GPT-Hub用于微调以提升Text2SQL效果,DB-GPT-Plugins作为插件仓库,兼容Auto-GPT,以及GPT-Vis作为可视化协议和dbgpts作为官方提供的数据应用仓库。

DB-GPT支持数据隐私保护,确保数据隐私和安全通过私有化大型语言模型和Agent去标识化技术。它适用于需要处理和分析大量数据的场景,如金融、电商、物流、医疗等,并可以帮助企业实现高效的数据管理、智能决策支持和业务流程优化。

更多DG-GPT内容可阅读:DB-GPT:蚂蚁开源的Text-to-SQL利器

用于AIAgent和工作流的模块化Pythons框架,具有思维链推理、工具和内存项目地址:https://github.com/griptape-ai/griptape

官网:www.griptape.ai

Griptape是一个模块化的Python框架,专为构建AI智能体和工作流而设计,支持思维链推理、工具和记忆功能。它提供了一种企业级的替代方案,与LangChain相媲美,旨在简化自然语言处理(NLP)任务,提高开发者处理和理解大量文本数据的效率。

该项目基于PyTorch框架构建,利用BERT、RoBERTa等预训练模型,在多种NLP任务上实现优异性能,同时保持代码的模块化设计,易于扩展和定制。Griptape的API设计简单易懂,便于非NLP领域的开发者快速上手,并提供详尽的文档和社区支持,以帮助开发者快速入门和解决使用中的问题。”Griptape is an enterprise grade alternative to LangChain.”

此外,Griptape框架支持从数据预处理到模型部署的全流程,提供了丰富的工具和库,帮助开发者构建和部署机器学习模型。它支持多种机器学习框架,并提供了一些最佳实践,如数据预处理、模型选择和超参数调优,以提高模型的准确性和性能。

Griptape生态系统还包括多个相关项目,如Griptape-UI、Griptape-Deploy和Griptape-Data,共同构成了一个完整的机器学习开发和部署环境。”Griptape is a modular Python framework for building AI-powered applications that securely connect to your enterprise data and APIs.”

Griptape框架的推出,将助力开发者构建更加高效的AI工作流,其核心功能包括模块化配置、多功能支持和易用性,为AI工作流的开发者带来更加高效、灵活的工作体验。”griptape 框架推出,助力构建AI工作流”。

无代码多Agent框架,用于使用您的数据构建 LLM Agent、工作流和应用程序项目地址:https://github.com/trypromptly/LLMStack

官网:https://llmstack.trypromptly.com

LLMStack是一个开源的低代码平台,它使用户能够利用大型语言模型(LLMs)构建功能强大的AI体验。这个平台支持构建各种AI应用程序,包括文本生成、问题回答、文本摘要、文本翻译以及媒体生成等。用户还可以将多个LLMs组合起来构建复杂的AI应用,并且可以将个人数据连接到LLMStack以增强语言模型,或连接业务流程以自动化工作流。

LLMStack的主要特点包括:

LLMStack还提供了一个可视化编辑器,用于创建应用程序,这些应用程序可以通过API、用户界面调用或从Slack、Discord等触发。它还允许用户导入数据源,如CSV、PDF、URLs、Youtube等,并将它们用于应用程序中,同时支持数据的共享和变量的使用,以向处理器提供动态值。

LLMStack的设计目标是降低构建AI应用的门槛,提高开发效率,并降低成本,同时确保数据的安全性和隐私性。无论是大型企业还是初创公司,都可以利用LLMStack快速开发和部署高效的人工智能解决方案。

构建基于斯坦福大学DSP论文的LLM驱动的智能体和智能体工作流项目地址:https://github.com/ax-llm/ax

项目文档:axllm.dev

DSPy论文:https://arxiv.org/abs/2310.03714

DSPy项目: https://github.com/stanfordnlp/dspy

ax-llm/ax项目是一个用于构建大型语言模型(LLM)驱动的智能Agent和”Agent工作流”的框架,其设计灵感来源于斯坦福大学的DSP论文 。这个框架支持与多种LLM和向量数据库的无缝整合,并允许开发者构建RAG(Retrieval-Augmented Generation)管道或协作Agent来解决复杂问题。Ax框架提供了一系列高级功能,包括流式验证、多模态DSP等。

该项目原名llmclient,更改为“Ax”是为了强调团队对于支持智能体工作流的重视。该团队认同包括Andrew Ng教授在内等众多专家的观点:智能体工作流是释放大型语言模型真正潜力的关键,也是实现通过上下文学习的目标的核心。该项目同时深受斯坦福大学DSPy论文的启发,ax框架是这些理念融合的产物,为您提供了一个强大的工具,以便构建您的智能体应用。

ax框架的显著特点之一是其利用提示签名与LLM进行高效且类型安全的交互。提示签名是从简单签名自动生成的,可以具有多个输入和输出字段。Ax目前支持包括OpenAI、Azure OpenAI、Cohere、Anthropic、Mistral、Groq、DeepSeek、Ollama、Google Gemini和Hugging Face在内的多种LLM,同时也支持多种向量数据库,如In Memory、Weaviate、Cloudflare和Pinecone 。

ax还提供了一些其他功能,包括RAG管道、智能分块、嵌入、查询、使用优化器的自动提示调整等。它还包括OpenTelemetry跟踪/可观察性支持,并提供可投入生产的TypeScript代码 。

ax框架的安装非常简单,可以通过npm或yarn进行安装,且易于使用。开发者可以选择一个AI创建一个提示签名并执行提示程序,还可以通过定义函数并将其传递给提示来启用函数调用 。

控制你的AI Agent项目地址:https://github.com/PrefectHQ/ControlFlow

项目文档:https://controlflow.ai/welcome

ControlFlow项目是由PrefectHQ发起的一个Python框架,专门用于构建具有Agent性的人工智能工作流。ControlFlow提供了一个结构化且以开发者为中心的框架,允许用户定义工作流并将任务委托给大型语言模型(LLMs),同时不损失控制或透明度:

该框架的设计理念是将复杂的AI工作流分解为可管理、可观察的步骤,即任务(Tasks)。每个任务代表一个离散的目标或需要完成的目标,例如生成文本、分类数据或从文档中提取信息。任务定义了AI工作流中需要完成的”什么”(WHAT)。

在ControlFlow中,AI Agents扮演执行任务的角色,决定了”如何”(HOW)完成任务。每个Agent可以有针对特定类型任务的独特配置、个性和能力。Agent被分配给适合它们特性和可用性的任务,这种任务和Agent的分离允许创建灵活且功能强大的工作流。

Flows是ControlFlow中的高级容器,用于封装和协调整个AI驱动的工作流。它们提供一种结构化的方式来管理任务、Agent、工具和共享上下文。Flows可以维护所有组件的一致状态、管理任务的执行顺序以及提供Agent协作的共享上下文。

ControlFlow还提供了任务中心架构,允许用户在维持精细控制的同时利用AI处理复杂的工作流。通过为每个任务设定明确的目标和约束,用户可以在AI的自主性与精确监督之间取得平衡,从而充满信心地构建复杂的AI驱动应用程序。

ControlFlow框架正在积极开发中,并即将进行首次公开发布。它旨在解决构建既强大又可预测的AI驱动应用程序的挑战,支持多Agent协作、生态系统集成和系统可观察性,适用于对稳定性和维护性有高要求的AI应用开发。

一个灵活的事件/智能体和自动化系统

项目地址:https://github.com/muesli/beehive

由muesli推出的beehive项目是一个灵活的事件/Agent和自动化系统,它允许用户创建自己的Agent来执行由事件和过滤器触发的自动化任务。这个系统是模块化、灵活的,并且非常容易扩展,适合任何人使用。

它拥有模块(称之为 “Hives”),因此它可以与Twitter、Tumblr、Email、IRC、Jabber、RSS、Jenkins、Hue等平台进行接口、对话或信息获取。

这些模块相互连接可以创建极其有用的Agent,例如在Tumblr博客上重新发布推文、将收到的聊天消息转发到电子邮件账户、当温度低于某个值时开启暖气系统、运行IRC机器人触发Jenkins CI上的构建、控制Hue照明系统,以及当股票价格低于特定值时通知用户等 。

安装beehive非常简单,提供了多种方式,包括Arch Linux的AUR软件包、Linux和macOS的静态二进制文件、Windows的64位版本,以及通过Docker和Ansible的部署工具。此外,还可以从源代码构建,这要求有Go 1.13或更高版本的Go环境 。

配置beehive涉及到创建“蜜蜂”和设置“链”,通过Web界面可以图形化地进行配置。用户可以对事件做出反应并执行操作,例如监控RSS源并在有更新时发送电子邮件。beehive提供了完整的模板语言来处理事件参数,允许用户定制化地构造动作 。

此外,beehive还提供了开发支持,包括IRC或Gitter上的社区讨论,以及Twitter上的最新动态更新。项目的官方仓库提供了完整的文档和示例,方便用户开始他们的beehive之旅 。

Generative AI SDK for Web,用于为使用JavaScript、React、Angular、Vue、Ember、Electron 构建的应用程序创建AI Agent项目地址:https://github.com/alan-ai/alan-sdk-web官网:https://alan.app/

alan-sdk-web是由Alan AI提供的一个生成式AI软件开发工具包(SDK),专门用于Web平台。它允许开发者在基于JavaScript、React、Angular、Vue、Ember和Electron等技术构建的应用程序中创建和集成AI智能体。这个SDK旨在帮助开发者快速将先进的AI功能嵌入到他们的Web应用中,而无需对用户界面进行大量改动或改动最小。

Alan AI提供了一个全面的解决方案,充当企业的“统一大脑”,连接企业应用程序、API和数据源,以简化工作流程。它包括以下几个核心组件:

使用alan-sdk-web,开发者需要在Alan AI Studio注册,构建对话脚本,并使用SDK将AI智能体嵌入到Web应用或网站中。SDK提供了丰富的API和配置选项,支持自定义AI按钮、处理命令、播放文本和执行其他交互功能。

Alan AI还提供了示例应用程序,展示如何在不同框架中使用SDK,以及如何在React应用中集成Alan AI,包括如何添加SDK到项目、指定AI按钮参数、使用各种方法和处理程序。

Alan AI SDK for Web的版本更新记录显示,它持续增强了文本聊天功能,修复了UI问题,并增加了额外的配置选项和API。

Plan-Validate-Solve(PVS)Agent实现准确、可靠和可重复的工作流程自动化

项目地址:https://github.com/felixbrock/lemon-agent

lemon-agent是一个基于LLM的智能体框架,旨在通过自动化执行任务来提高工作流程的效率和准确性。也是一个基于ACL 2023论文“Plan-and-Solve Prompting”构建,用于精确、可靠和可复现的工作流自动化的Plan-Validate-Solve (PVS)独立的监督式计划和解决智能体,可以轻松集成到LangChain等框架中,并与任何模型协同工作。

lemon-agent不仅是一个工具,更是一整套工作流程自动化解决方案。用户可以使用Lemon Agent与Airtable、Hubspot、Discord、Notion和GitHub等工具进行交互,并构建强大的工作流自动化,让LLM智能体可靠地执行读写操作。在功能上 ,目前它支持:

任务分离与人机交互:Lemon Agent目前具备规划智能体(Planner Agent)和解决智能体(Solver Agent),以保持智能体的专注度并提升准确性。我们计划很快增加更多类型的智能体。此外,Lemon Agent将在相关工作任务流程中请求批准,确保执行操作符合预期。

无限的配置选项:定义工作流时,Lemon Agent为用户提供了无限的配置选项。例如,可以指示Lemon Agent在执行工作流步骤前请求许可,或者在模型每次执行工作流步骤时讲一个爸爸的笑话。

UI灵活性:可以在Lemon Agent之上构建任何用户界面(UI),或者通过内置的命令行界面(CLI)与之交互。

可视化分析:通过使用分析可视化工具,您可以轻松地更好地了解工具的使用频率和顺序。这样,您就可以识别智能体决策能力中的薄弱环节,并通过进一步配置您的Lemon Agent工作流,引导其行为更具确定性。

“lemon-agent”项目特别强调了Plan-Validate-Solve(计划-验证-解决)的自动化流程,这意味着它支持智能体在执行任务之前进行详尽的规划,执行过程中进行实时验证,并在遇到问题时进行解决,以确保任务的顺利完成。

AGentic Intelligence 操作系统项目地址:https://github.com/lion-agi/lionagi项目文档:https://ocean-lion.com/Welcome#Why+Automating+Workflows%3F

lionagi是一个智能Agent工作流程自动化框架,旨在实现智能智能体工作流的自动化,通过引入先进的机器学习模型到现有的工作流和数据基础设施中,从而提升效率和智能化水平。

为什么要自动化工作流程?诸如大语言模型 (LLM)之类的智能 AI 模型引入了人机互动的新可能性。LLM 因其“一模型胜任所有工作”的特点和令人难以置信的性能在全球范围内引起了广泛关注。使用 LLM 的一种方式是作为搜索引擎使用,然而这种用法因 LLM 的幻觉现象而变得复杂。

LLM 内部的运作更像是一个黑箱,缺乏可解释性,这意味着我们不知道它是如何得出某个答案或结论的,因此我们不能完全信任/依赖这样的系统输出。使用 LLM 的另一种方法是将其视为智能Agent,配备各种工具和数据源。

LionAGI作为智能Agent进行的工作流程有清晰的步骤,可以执行明确的工作流,其决策逻辑可指定、观察、评估和优化为执行操作而做出的每个决策的逻辑。这种方法,仍然无法准确指出LLM如何生成其输出,但流程本身是可解释的。

LionAGI还可以管理和指导其他Agents,也可以并行使用多个不同的工具。

通用 GUI,可实现AI工作流的无缝交互和管理

项目地址:https://github.com/jbexta/AgentPilot

AgentPilot是一个开源的桌面应用程序,它允许用户创建、管理和与AI智能体进行聊天。这个应用程序具备多种功能,包括多智能体支持、分支聊天,并通过LiteLLM与多个提供商进行集成。AgentPilot使用户能够在低代码环境中配置不同提供商的模型进行交互,并管理它们的语音、个性和操作 。

该应用程序目前是0.2版本前的预发布版,一些新功能尚未完全实现。新版本引入了语音输入、文件夹、工具和RAG(Retrieval-Augmented Generation)功能。AgentPilot允许用户对工作流程进行更好的组织,管理一系列工具,并可以分配给任何智能体以修改它们的功能 。

AgentPilot支持多种插件类型,包括可以覆盖默认智能体行为的“智能体”插件,以及可以覆盖默认工作流行为的“工作流”插件。此外,Open Interpreter已集成到AgentPilot中,可以作为插件独立使用,也可以由任何智能体来执行代码 。

用户可以通过Python包索引安装AgentPilot,或从提供的链接下载适用于不同平台的可执行文件。

使用 XState 创建状态机驱动的 LLM Agent项目地址:https://github.com/statelyai/agent

项目文档:https://stately.ai/docs/agents

Stately Agent是Stately.ai提供的一个基于actor模型和状态机创建AI智能体的框架。这些智能体能够观察环境、决定行动方案,并执行动作以实现目标。Stately Agent框架不仅支持文本生成和函数调用,还能够:

Stately Agent的创建和行为定制非常灵活,可以通过createAgent函数来创建智能体,并设置名称、使用的AI SDK语言模型、智能体能触发的事件等。智能体可以与状态机进行交互,根据当前状态和目标来决定下一步行动。此外,Stately Agent还具备记忆功能,包括短期(本地)记忆和长期记忆,能够记住消息、观察结果、反馈和计划 。

作为一个用于使用状态机构建AI Agent的灵活框架,Stately Agent 通过以下方式超越了普通的基于LLM的AI Agent:

Stately Agent 还可以与现有的状态机actor进行交互,以确定接下来应该执行的动作,为开发人员提供了一种强大的方式来构建能够理解环境、记忆并做出决策的AI智能体 。

异步数据流执行引擎,允许开发人员通过将Agent工作流描述为YAML或JSON中的声明性数据流图来构建Agent应用程序

项目地址:https://github.com/receptron/graphai

GraphAI是一个异步数据流执行引擎,它使得开发人员能够通过在YAML或JSON文件中描述智能体工作流的声明性数据流图来构建智能体应用程序。

正如Andrew Ng在他的文章“The Batch: Issue 242”中所阐述的,通过分步骤多次调用大型语言模型,并允许它们逐步构建输出,通常能够获得更高质量的结果。吴恩达博士将这种策略称为“智能体工作流”。

这类智能体应用程序涉及到多个异步API调用(例如,OpenAI的聊天完成API、数据库查询、网络搜索)并需要管理它们之间的数据依赖性。随着应用程序复杂度的提升,由于API的异步特性,按照传统编程方式管理这些依赖项变得日益困难。

GraphAI赋予了开发人员一种能力,在YAML或JSON格式的数据流图中描述这些智能体间的依赖关系(即异步API调用),这种方式被称为声明式数据流编程。GraphAI引擎将负责处理并发的异步调用、数据依赖性管理、任务优先级控制、map-reduce处理、错误处理、重试机制以及日志记录等所有复杂任务。

用10行代码构建多代理工作流

项目地址:https://github.com/shibing624/agentica

Agentica是一个用于构建多智能体工作流的工具,它允许开发者用极少的代码量(仅需10行代码)来创建复杂的智能体应用程序。Agentica项目的核心特点包括支持多种智能体功能,如规划(Planning)、记忆(Memory)、工具使用(Tool use)等,以及一个为大型语言模型(LLM)智能体构建的框架,它提供了简单的代码快速编排智能体的能力,并支持多种功能,例如Reflection(反思)、Plan and Solve(计划并执行)、RAG、多智能体、多角色、工作流等 。

Agentica项目包括三个组件。Planner组件负责让LLM生成多步计划来完成复杂任务,定义每一步所依赖的上一步的输出。Worker组件接受这些计划,并循环遍历计划中的每个子任务,调用工具完成任务,能够自动反思纠错以完成任务。最后,Solver组件将所有输出整合为最终答案 。

此外,Agentica项目还提供了多种示例,包括基于文档的问答、代码执行、科技报告撰写、新闻稿撰写等,这些示例展示了Agentica在不同场景下的应用能力 。项目还提供了安装指南和快速入门指南,帮助开发者快速开始使用Agentica构建自己的智能体应用程序 。

Agentica项目由shibing624维护,它是一个开源项目,鼓励社区贡献,并且提供了详细的文档和示例来帮助开发者学习和使用 。项目还提供了如何引用Agentica的学术引用格式,以便于在研究中使用Agentica时进行适当的引用

快节奏、基于智能团队合作的座席工作流程

项目地址:https://github.com/Drlordbasil/GroqAgenticWorkflow

GroqAgenticWorkflow由Drlordbasil发起,旨在通过智能体的合作来实现任务的高效执行和流程的自动化。这是一个快节奏、基于智能团队协作的智能工作流项目,一个创新的人工智能系统,它利用Groq技术自主生成有盈利潜力的Python脚本。该平台整合了专业的AI智能体、先进的NLP技术和前沿的语言模型,构建了一个自我维持的开发生态系统。其主要特性如下:

GroqAgenticWorkflow在革命性的AI驱动架构上运行,架构中包括几个智能体角色:

创意生成:Bob,产品管理AI,根据市场趋势提出项目创意;

架构设计:AI架构师Mike,负责软件结构设计和算法选择;

开发:AI开发人员Annie,负责代码编写、测试和优化;

DevOps和部署:DevOps AI Alex,管理基础设施和部署流程;

持续优化:团队协作,持续改进代码库和流程。

GroqAgenticWorkflow不仅是开发工具,也有机会成为推动各行业创新的催化剂,拓宽AI驱动解决方案的边界。其未来愿景包括利用AI进行市场分析和趋势预测、自动生成移动和Web应用程序、AI智能体自我进化及实现持续改进、构建基于区块链的去中心化协作网络。

文/王吉伟

原文转自 微信公众号@王吉伟