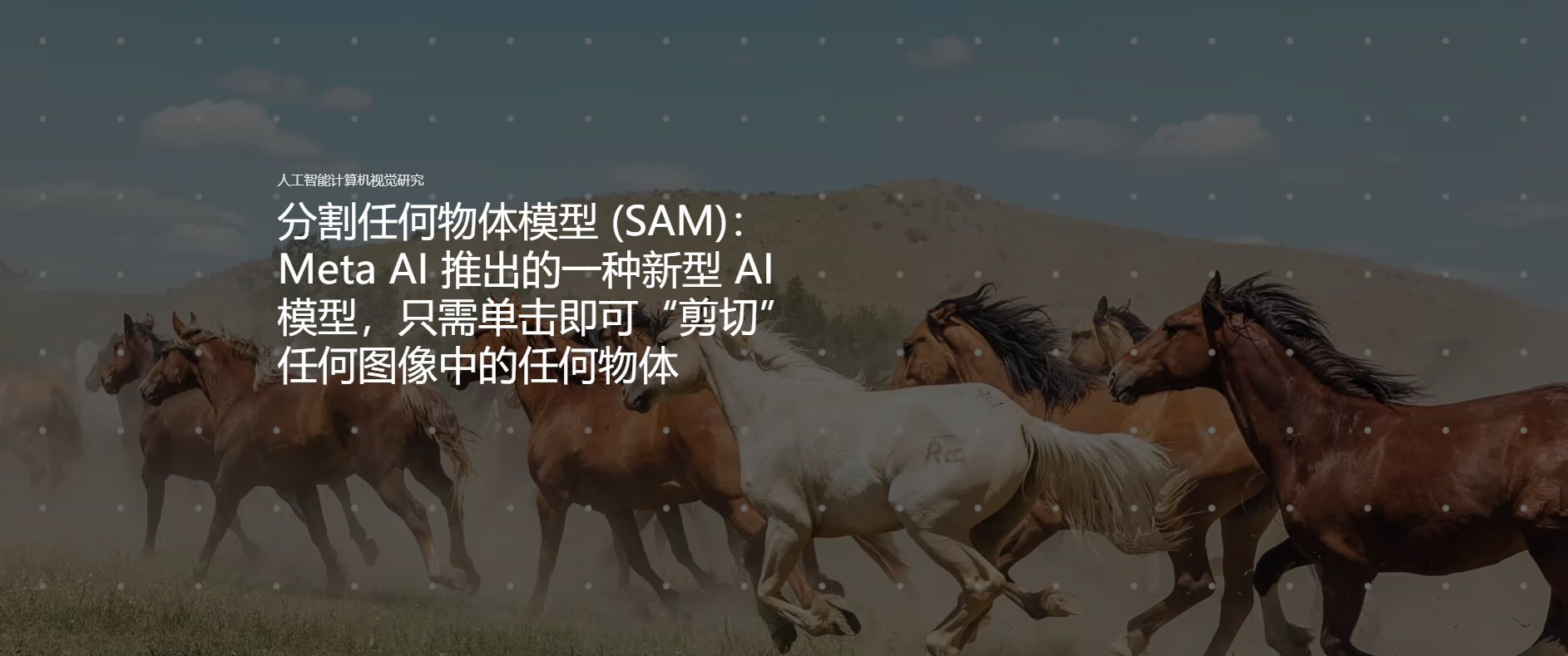

Meta Al 图像切割服务

专用API

【更新时间: 2024.08.13】

"Meta AI"是Meta公司的人工智能研究部门,致力于推动人工智能领域的创新和突破。该部门专注于开发先进的人工智能技术和算法,包括自然语言处理、计算机视觉、增强现实/虚拟现实(AR/VR)、机器人技术等多个领域。

咨询

去服务商官网采购>

|

浏览次数

56

采购人数

0

试用次数

0

SLA: N/A

SLA: N/A

响应: N/A

响应: N/A

适用于个人&企业

适用于个人&企业

试用

收藏

×

完成

取消

×

书签名称

确定

|

- API详情

- 常见 FAQ

- 关于我们

- 相关推荐

什么是Meta Al 图像切割服务?

"Meta AI"是Meta公司的人工智能研究部门,致力于推动人工智能领域的创新和突破。该部门专注于开发先进的人工智能技术和算法,包括自然语言处理、计算机视觉、增强现实/虚拟现实(AR/VR)、机器人技术等多个领域。Meta AI 旨在通过其研究来推动技术边界,并将这些技术应用于Meta的产品和服务中,同时也开放一些研究成果供学术界和工业界使用。

Meta Al 图像切割服务有哪些核心功能?

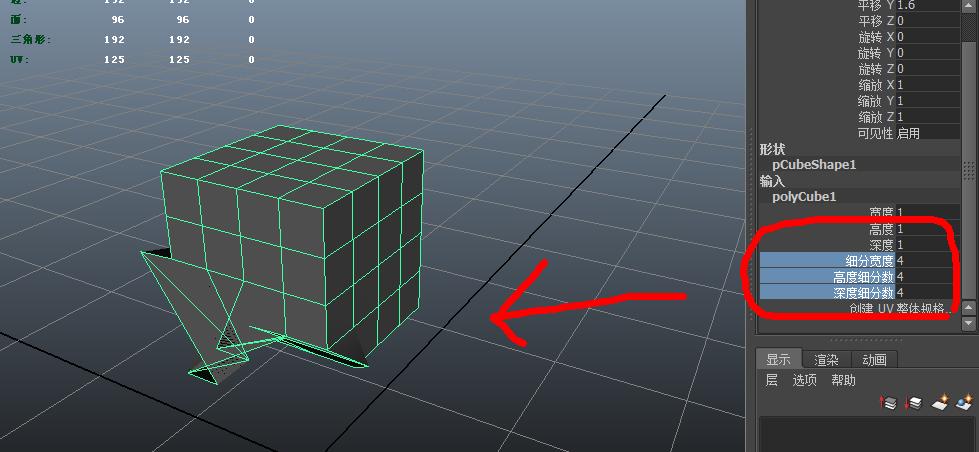

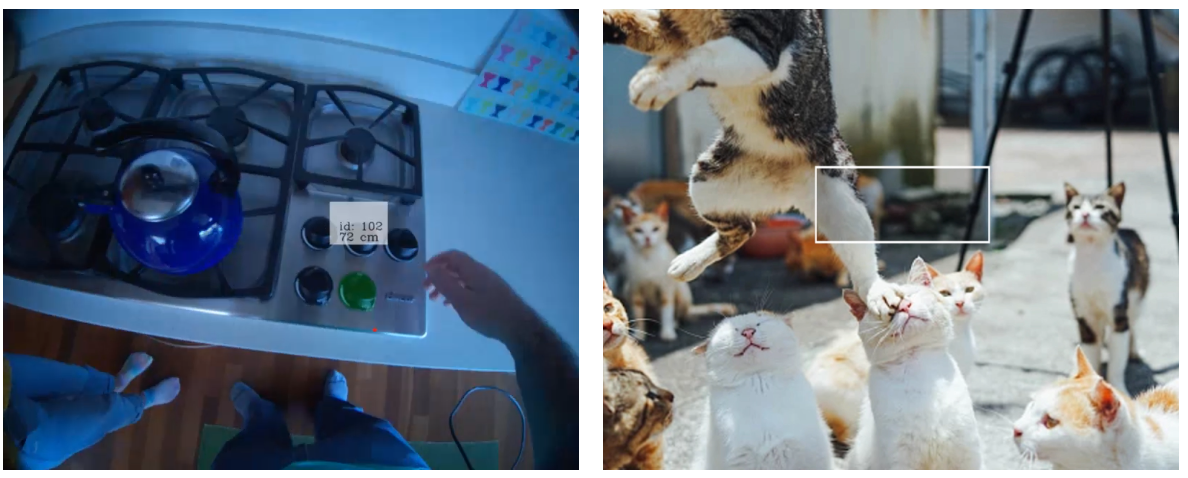

1. SAM 使用多种输入提示

指定在图像中分割的内容的提示允许执行广泛的分割任务,而无需额外的训练。用交互点和框来提示它。自动分割图像中的所有内容。为模糊提示生成多个有效的掩码。 2. SAM 的提示式设计可实现与其他系统的灵活集成

2. SAM 的提示式设计可实现与其他系统的灵活集成

SAM 可以从其他系统获取输入提示,例如将来可以从 AR/VR 耳机获取用户的注视来选择对象。此视频使用了我们开源的 Aria 试点数据集。

来自对象检测器的边界框提示可以实现文本到对象的分割。 3. 可扩展输出

3. 可扩展输出

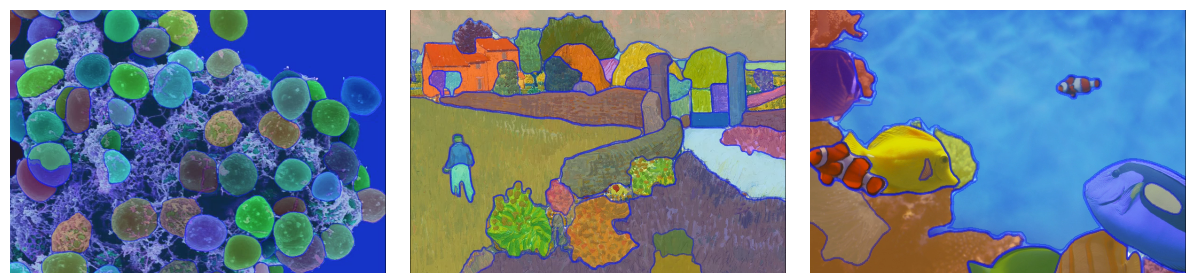

输出蒙版可用作其他 AI 系统的输入。例如,对象蒙版可在视频中跟踪、启用图像编辑应用程序、提升为 3D或用于拼贴等创意任务。 4. 零样本泛化

4. 零样本泛化

SAM 已经学会了关于物体的一般概念——这种理解使得零样本泛化到不熟悉的物体和图像而无需额外的训练。

Meta Al 图像切割服务的核心优势是什么?

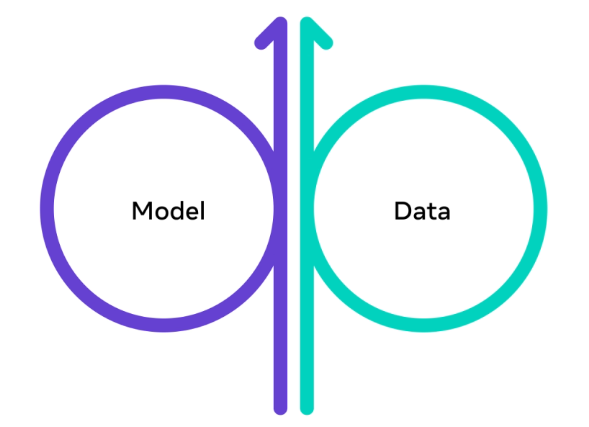

1. SAM 的数据引擎

SAM 的先进功能源自其对数百万张图像和掩码的训练,这些图像和掩码是通过使用模型在环“数据引擎”收集的。研究人员使用 SAM 及其数据以交互方式注释图像并更新模型。这个循环重复多次,以改进模型和数据集。 2. 1100 万张图像,10 亿多张掩膜

2. 1100 万张图像,10 亿多张掩膜

在 SAM 的帮助下注释了足够多的蒙版后,我们能够利用 SAM 复杂的模糊感知设计完全自动注释新图像。为此,我们向 SAM 展示图像上的点网格,并要求 SAM 在每个点处分割所有内容。我们的最终数据集包括从约 1100 万张获得许可和隐私保护的图像中收集的超过 11 亿个分割蒙版。 3. 高效灵活的模型设计

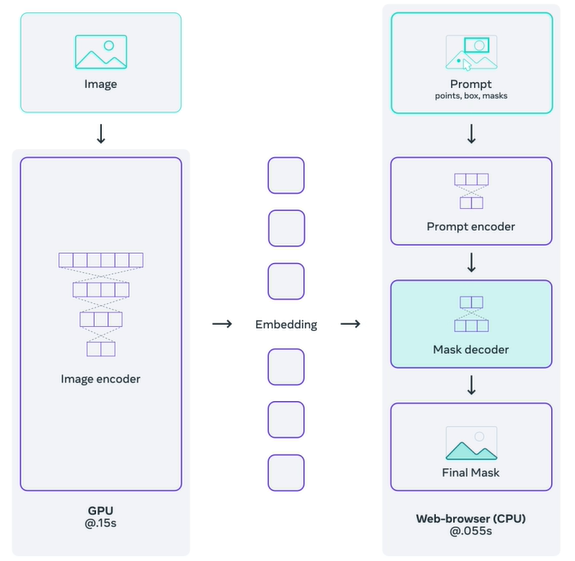

3. 高效灵活的模型设计

SAM 的设计足够高效,能够为其数据引擎提供动力。我们将模型分解为 1) 一次性图像编码器和 2) 轻量级掩码解码器,每次提示只需几毫秒即可在网络浏览器中运行。

在哪些场景会用到Meta Al 图像切割服务?

- 图像和视频编辑:

- 在图像和视频编辑软件中,用户可以使用SAM来快速分割出图像中的特定对象,用于替换背景、裁剪、缩放或其他编辑操作。

- 在视频处理中,SAM可以用于跟踪视频中的对象,并应用于特效添加、视频合成等场景。

- 增强现实/虚拟现实(AR/VR):

- 在AR/VR应用中,SAM可以与用户的交互(如注视点、手势等)结合,实现更自然的对象选择和分割,提升用户体验。

- 在虚拟现实环境中,SAM可以用于场景重建、物体放置和交互等。

- 图像识别和分析:

- 在医疗领域,SAM可以用于医学影像分析,如自动分割出病灶区域,辅助医生进行诊断。

- 在安防领域,SAM可以用于监控视频中的目标检测和跟踪,提高监控效率。

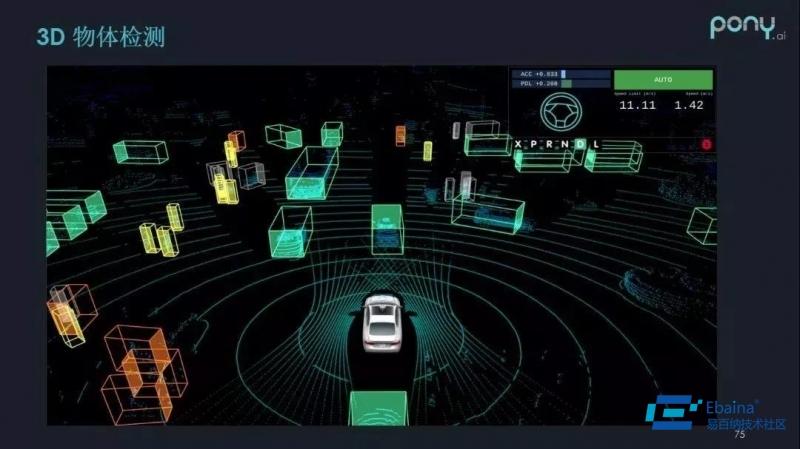

- 自动驾驶和机器人技术:

- 在自动驾驶领域,SAM可以用于道路和交通标志的分割,帮助车辆更好地理解周围环境。

- 在机器人领域,SAM可以用于机器人视觉系统中,实现对物体的精准识别和抓取。

- 创意设计和广告:

- 在广告设计中,SAM可以用于快速分割图像中的元素,以创建更具吸引力的广告素材。

- 在创意设计中,SAM可以用于图像合成、拼贴等任务,为设计师提供便捷的工具。

通过深思熟虑的合作实现负责任的人工智能

我们和其他人一样,正在探索和发现人工智能的前沿。因此,在探索人工智能的众多可能性时,我们也需要指导。通过倾听主题专家、政策制定者和有生活经验的人的意见,我们旨在积极推动和推进人工智能系统的负责任设计和运营。在此过程中,我们坚持组织的核心原则:隐私和安全、公平和包容、稳健性和安全性、透明度和控制、问责制和治理。

在行业活动中分享我们的进展

全年,我们以赞助商或主办方的身份,通过各种虚拟、现场和混合行业和学术活动与 AI 社区建立联系。在这些活动中,我们的工程师和研究人员分享了我们最新的产品开发、研究突破和出版物。

导师计划:获得人工智能研究的实践经验

我们热衷于向人们介绍非凡的 AI 世界。我们的 AI 导师制 (AIM) 和 EMEA 计划让博士候选人与其大学、学术顾问和 Meta 的 AI 导师(作为 Meta 的全职 AI 员工)合作开展开放科学研究。我们目前已与美国、法国、以色列和英国的知名大学达成协议。

通过深思熟虑的合作实现负责任的人工智能

我们和其他人一样,正在探索和发现人工智能的前沿。因此,在探索人工智能的众多可能性时,我们也需要指导。通过倾听主题专家、政策制定者和有生活经验的人的意见,我们旨在积极推动和推进人工智能系统的负责任设计和运营。在此过程中,我们坚持组织的核心原则:隐私和安全、公平和包容、稳健性和安全性、透明度和控制、问责制和治理。

在行业活动中分享我们的进展

全年,我们以赞助商或主办方的身份,通过各种虚拟、现场和混合行业和学术活动与 AI 社区建立联系。在这些活动中,我们的工程师和研究人员分享了我们最新的产品开发、研究突破和出版物。

导师计划:获得人工智能研究的实践经验

我们热衷于向人们介绍非凡的 AI 世界。我们的 AI 导师制 (AIM) 和 EMEA 计划让博士候选人与其大学、学术顾问和 Meta 的 AI 导师(作为 Meta 的全职 AI 员工)合作开展开放科学研究。我们目前已与美国、法国、以色列和英国的知名大学达成协议。